Yapay zeka kadar hızlı hareket eden bir sektöre ayak uydurmak zorlu bir iştir. Bir yapay zeka bunu sizin için yapana kadar, kendi başımıza ele almadığımız dikkate değer araştırma ve deneylerin yanı sıra, makine öğrenimi dünyasındaki son hikayelerin kullanışlı bir özetini burada bulabilirsiniz.

Bu hafta Meta, Llama serisinin üretken yapay zeka modellerinin en sonuncusunu piyasaya sürdü: Llama 3 8B ve Llama 3 70B. Meta, metin analiz etme ve yazma yeteneğine sahip modellerin “açık kaynaklı” olduğunu ve geliştiricilerin kendi benzersiz hedeflerini göz önünde bulundurarak tasarladıkları sistemlerin “temel parçası” olmayı amaçladığını söyledi.

Meta, “Bunların kendi sınıflarının en iyi açık kaynak modelleri olduğuna inanıyoruz” diye yazdı. Blog yazısı. “Erken ve sık sık yayınlama yönündeki açık kaynak ahlakını benimsiyoruz.”

Tek bir sorun var: Llama 3 modelleri Gerçekten “açık kaynak”, en azından en katı tanım.

Açık kaynak, geliştiricilerin modelleri istedikleri gibi sınırsız olarak kullanabileceği anlamına gelir. Ancak Llama 2’de olduğu gibi Llama 3’te de Meta belirli lisanslama kısıtlamaları getirmiştir. Örneğin, Lama modelleri diğer modelleri eğitmek için kullanılamaz. Ve Aylık 700 milyondan fazla kullanıcısı olan uygulama geliştiricilerinin Meta’dan özel bir lisans talep etmesi gerekiyor.

Açık kaynağın tanımına ilişkin tartışmalar yeni değil. Ancak yapay zeka alanındaki şirketlerin bu terimle hızlı ve gevşek oynaması, uzun süredir devam eden felsefi tartışmalara yakıt sağlıyor.

Geçtiğimiz ağustos ayında bir çalışmak Carnegie Mellon’daki araştırmacılar, AI Now Enstitüsü ve Signal Vakfı tarafından ortak yazılan çalışma, yalnızca Lama’nın değil, “açık kaynak” olarak markalanan birçok yapay zeka modelinin büyük yakalamalar içerdiğini ortaya çıkardı. Modelleri eğitmek için gereken veriler gizli tutulur. Bunları çalıştırmak için gereken bilgi işlem gücü birçok geliştiricinin erişiminin ötesindedir. Ve bunlara ince ayar yapmak için harcanan emek, aşırı derecede pahalıdır.

Peki bu modeller gerçekten açık kaynak değilse tam olarak nedir? Bu iyi bir soru; Açık kaynağı yapay zeka açısından tanımlamak kolay bir iş değil.

İlgili çözülmemiş sorulardan biri, açık kaynak lisanslamasının dayandığı temel fikri mülkiyet mekanizması olan telif hakkının, bir yapay zeka projesinin çeşitli bileşenlerine ve parçalarına, özellikle de bir modelin iç iskelesine (örn. gömmeler). Ayrıca, açık kaynak algısı ile yapay zekanın aslında bunun üstesinden gelmek için nasıl çalıştığı arasında bir uyumsuzluk var: Açık kaynak kısmen, geliştiricilerin kısıtlama olmadan kodu inceleyebilmesini ve değiştirebilmesini sağlamak için tasarlandı. Ancak yapay zeka ile üzerinde çalışmak ve değişiklik yapmak için hangi bileşenlere ihtiyacınız olduğu yoruma açıktır.

Tüm belirsizliğin içinden geçerek Carnegie Mellon çalışması yapmak Meta gibi teknoloji devlerinin “açık kaynak” ifadesini benimsemelerinin doğasında olan zararı açıkça ortaya koyun.

Çoğu zaman, Llama gibi “açık kaynaklı” yapay zeka projeleri haber döngülerini (ücretsiz pazarlama) başlatıyor ve proje sahiplerine teknik ve stratejik faydalar sağlıyor. Açık kaynak topluluğu aynı faydaları nadiren görür ve gördüklerinde de bakımcılarla karşılaştırıldığında marjinal kalırlar.

Araştırmanın ortak yazarları, yapay zekayı demokratikleştirmek yerine, “açık kaynaklı” yapay zeka projelerinin (özellikle büyük teknoloji şirketlerinin projeleri) merkezi gücü sağlamlaştırma ve genişletme eğiliminde olduğunu söylüyor. Gelecek sefer büyük bir “açık kaynak” model yayınlandığında bunu akılda tutmakta fayda var.

İşte son birkaç güne ait diğer AI hikayeleri:

- Meta, sohbet robotunu güncelliyor: Llama 3’ün çıkışıyla aynı zamana denk gelen Meta, Facebook, Messenger, Instagram ve WhatsApp’taki AI sohbet robotunu (Meta AI) Llama 3 destekli bir arka uçla yükseltti. Ayrıca daha hızlı görsel oluşturma ve web arama sonuçlarına erişim gibi yeni özellikleri de kullanıma sundu.

- Yapay zeka tarafından oluşturulan porno: Ivan, Meta’nın yarı bağımsız politika konseyi olan Gözetim Kurulu’nun dikkatini şirketin sosyal platformlarının yapay zeka tarafından oluşturulan açık görselleri nasıl işlediğine nasıl çevirdiğini yazıyor.

- Filigranları yapıştır: Sosyal medya hizmeti Snap, platformunda yapay zeka tarafından oluşturulan görsellere filigran eklemeyi planlıyor. Snap logosunun ışıltılı bir emojiye sahip yarı saydam versiyonu olan yeni filigran, uygulamadan dışa aktarılan veya film rulosuna kaydedilen, AI tarafından oluşturulan herhangi bir görüntüye eklenecek.

- Yeni Atlas: Hyundai’nin sahibi olduğu robot teknolojisi şirketi Boston Dynamics, hidrolikle çalışan öncülünün aksine tamamen elektrikli ve görünüşte çok daha dost canlısı olan yeni nesil insansı Atlas robotunu tanıttı.

- İnsansılar üzerinde insansılar: Mobileye’ın kurucusu Amnon Shashua, Boston Dynamics’i geride bırakmamak için, iki ayaklı robotik sistemler oluşturmaya odaklanan yeni bir girişim olan Menteebot’u başlattı. Bir demo videosunda Menteebot’un prototipinin bir masaya doğru yürüyüp meyve topladığı görülüyor.

- Reddit’in tercümesi: Reddit CPO’su Pali Bhat, Amanda ile yaptığı bir röportajda, sosyal ağı daha küresel bir kitleye ulaştırmak için yapay zeka destekli bir dil çeviri özelliğinin yanı sıra Reddit moderatörlerinin geçmiş kararları ve eylemleri üzerine eğitilmiş yardımcı bir denetleme aracının da üzerinde çalışıldığını açıkladı.

- Yapay zeka tarafından oluşturulan LinkedIn içeriği: LinkedIn, gelirlerini artırmanın yeni bir yolunu sessizce test etmeye başladı: LinkedIn Premium Şirket Sayfası aboneliği; bu abonelik, ayda 99 dolar gibi yüksek ücretler karşılığında, içerik yazmak için yapay zeka ve takipçi sayısını artırmak için bir dizi araç içeriyor.

- Bir Öncü: Google’ın ana şirketi Alphabet’in moonshot fabrikası X, bu hafta dünyanın en büyük sorunlarından bazılarına teknoloji uygulama yönündeki son teklifi olan Project Bellwether’ı açıkladı. Burada bu, orman yangınları ve sel gibi doğal afetleri mümkün olduğunca çabuk tespit etmek için yapay zeka araçlarını kullanmak anlamına geliyor.

- Çocukları yapay zekayla korumak: Birleşik Krallık’ın Çevrimiçi Güvenlik Yasası’nı uygulamakla görevli düzenleyici kurum Ofcom, özellikle çocukları zararlı içerikten korumak amacıyla çevrimiçi yasa dışı içeriği proaktif olarak tespit etmek ve kaldırmak için yapay zeka ve diğer otomatik araçların nasıl kullanılabileceği konusunda bir araştırma başlatmayı planlıyor.

- OpenAI Japonya’ya iniyor: OpenAI, yeni bir Tokyo ofisinin açılması ve özellikle Japonca için optimize edilmiş bir GPT-4 modelinin planlanmasıyla Japonya’ya doğru genişliyor.

Daha fazla makine öğrenimi

Resim Kredisi: DrAfter123 / Getty Images

Bir chatbot fikrinizi değiştirebilir mi? İsviçreli araştırmacılar, yalnızca bunu yapabileceklerini değil, aynı zamanda sizin hakkınızda bazı kişisel bilgilerle önceden donatılmış olmaları durumunda, aslında olabilirler Daha Bir tartışmada aynı bilgiye sahip bir insandan daha ikna edicidir.

EPFL’den proje lideri Robert West, “Bu, steroid kullanan Cambridge Analytica” dedi. Araştırmacılar, modelin – bu durumda GPT-4 – daha ilgi çekici ve kendinden emin bir vaka sunmak için çevrimiçi geniş argüman ve gerçek deposundan yararlandığından şüpheleniyorlar. Ancak sonuç bir bakıma kendi adına konuşuyor. West, ikna konularında Yüksek Lisans’ın gücünü hafife almayın, diye uyardı: “Yaklaşan ABD seçimleri bağlamında insanlar endişeli çünkü burası bu tür teknolojilerin her zaman ilk savaşta test edildiği yer. Kesin olarak bildiğimiz bir şey var ki, insanlar seçimi etkilemek için geniş dil modellerinin gücünü kullanacaklar.”

Bu modeller dil konusunda neden bu kadar iyi? Bu, ELIZA’ya kadar uzanan uzun bir araştırma geçmişine sahip olan bir alandır. Bu işin büyük bir kısmı boyunca orada bulunan (ve az da olsa kendisi gerçekleştiren) insanlardan birini merak ediyorsanız, şuraya göz atın: Stanford’dan Christopher Manning’in bu profili. Kısa süre önce John von Neuman Madalyası ile ödüllendirildi; tebrikler!

Kışkırtıcı başlıklı bir röportajda, başka bir uzun vadeli yapay zeka araştırmacısı (TechCrunch sahnesini de süsleyen), Stuart Russell ve doktora sonrası araştırmacı Michael Cohen şu konuda spekülasyon yapıyor: “Yapay zekanın hepimizi öldürmesini nasıl önleyebiliriz?” Muhtemelen daha sonra değil, daha erken anlamak iyi bir şey! Ancak bu yüzeysel bir tartışma değil; bunlar yapay zeka modellerinin motivasyonlarını (eğer doğru kelime buysa) gerçekten nasıl anlayabileceğimizden ve düzenlemelerin bunların etrafında nasıl inşa edilmesi gerektiğinden bahseden akıllı insanlar.

Röportaj aslında bununla ilgili Bilimde bir makale Bu ayın başlarında yayınlanan ve “uzun vadeli planlama aracıları” olarak adlandırdıkları, hedeflerine ulaşmak için stratejik olarak hareket edebilen gelişmiş yapay zekaların test edilmesinin imkansız olabileceğini öne sürüyorlar. Temel olarak, eğer bir model başarılı olmak için geçmesi gereken testleri “anlamayı” öğrenirse, bu testleri yaratıcı bir şekilde olumsuzlamanın veya atlatmanın yollarını pekala öğrenebilir. Bunu küçük ölçekte gördük, neden büyük ölçekte olmasın?

Russell bu tür ajanları yapmak için gereken donanımın kısıtlanmasını öneriyor… ama elbette Los Alamos ve Sandia Ulusal Laboratuarları teslimatlarını yeni aldılar. LANL, Venado için kurdele kesme törenini gerçekleştirdi2.560 Grace Hopper Nvidia çipinden oluşan, yapay zeka araştırmalarına yönelik yeni bir süper bilgisayar.

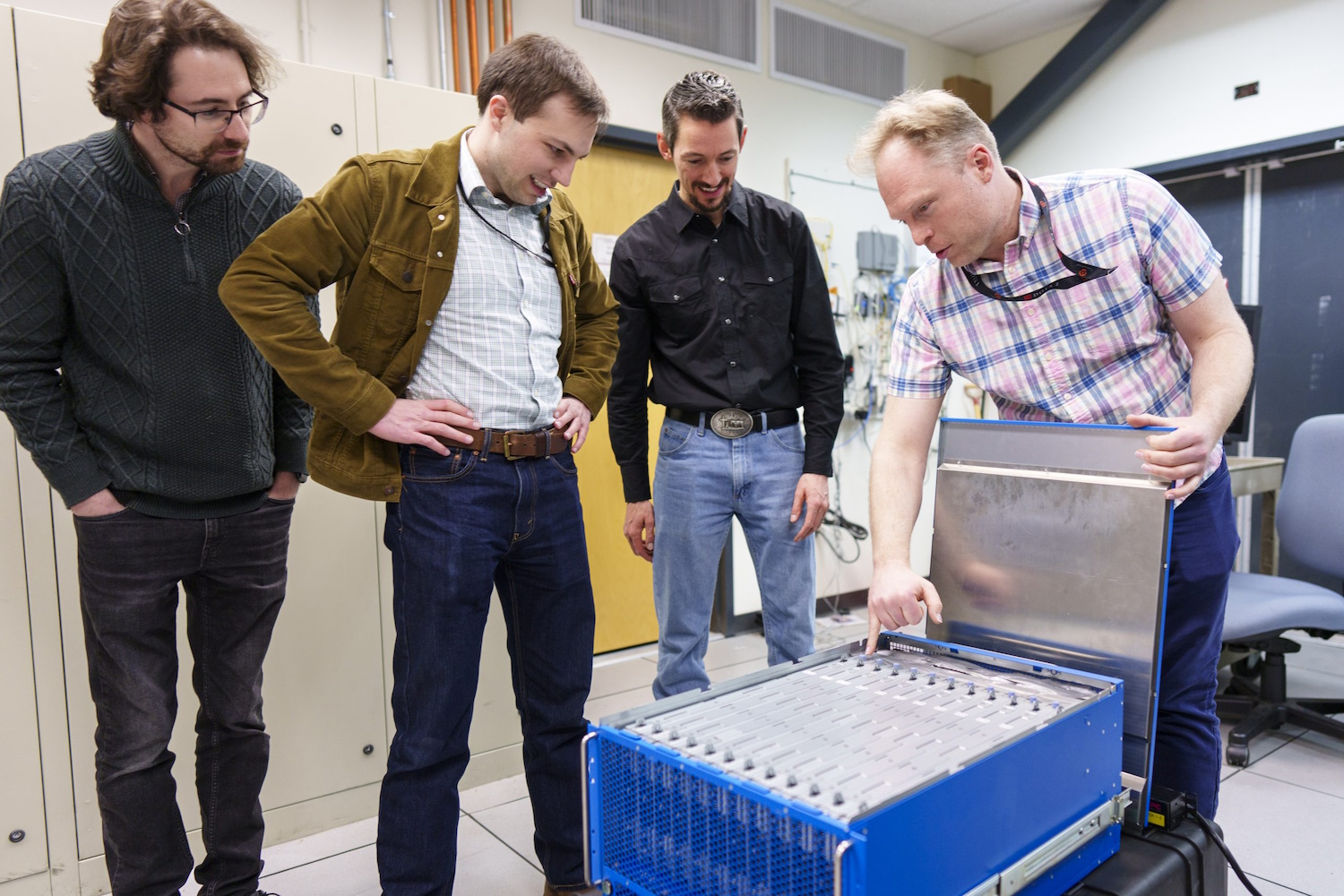

Araştırmacılar yeni nöromorfik bilgisayarı inceliyorlar.

Ve Sandia kısa süre önce Intel tarafından inşa edilen ve dünyadaki en büyük sistem olduğuna inanılan, 1,15 milyar yapay nörondan oluşan “Hala Point adında olağanüstü bir beyin tabanlı bilgi işlem sistemi” aldı. Nöromorfik hesaplama, adlandırıldığı şekliyle, Venado gibi sistemlerin yerini almayı değil, modern modellerde gördüğümüz istatistik odaklı yaklaşımdan daha çok beyne benzeyen yeni hesaplama yöntemlerini takip etmeyi amaçlıyor.

“Bu milyarlarca nöronlu sistemle, hem mevcut algoritmalardan daha verimli ve daha akıllı olabilecek yeni yapay zeka algoritmalarını hem de optimizasyon ve modelleme gibi mevcut bilgisayar algoritmalarına yeni beyin benzeri yaklaşımları ölçeğe göre yenilik yapma fırsatına sahip olacağız” dedi. Sandia araştırmacısı Brad Aimone. Kulağa hoş geliyor… tam anlamıyla züppe!