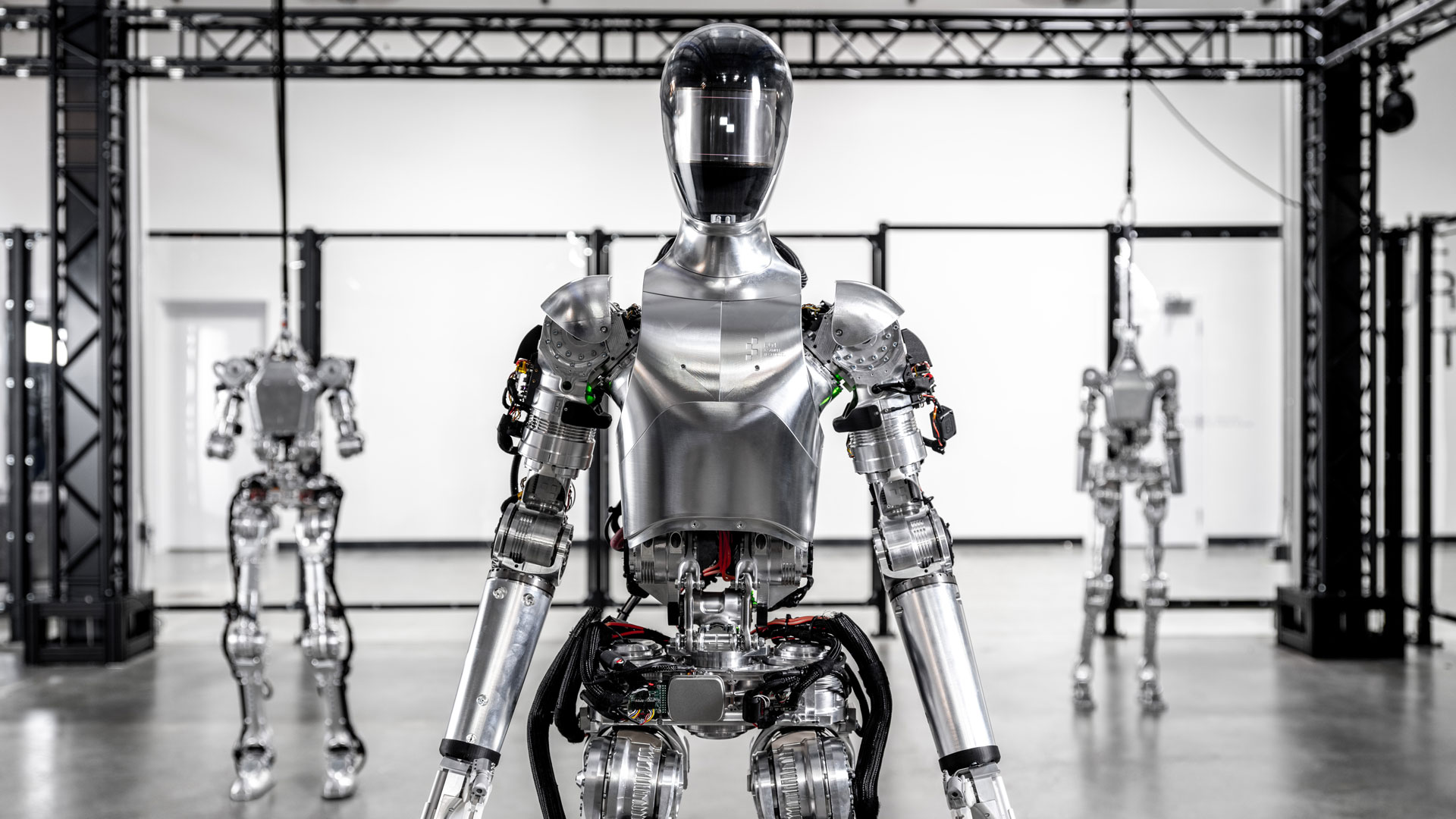

İnsansı robot geliştirme, yirmi yıldır büyük oranda salyangoz hızında ilerledi ancak Figure AI ve OpenAI arasındaki işbirliği sayesinde hızlı bir ivmelenme yaşanıyor ve sonuç şimdiye kadar gördüğüm en çarpıcı gerçek insansı robot videosu oldu.

Çarşamba günü, startup robotik firması Figure AI, botu bir şekilde ilgi çekici olmayan bir otomattan tam teşekküllü bir bilim kurgu botuna dönüştüren yeni bir Görsel Dil Modeli (VLM) çalıştıran Şekil 01 robotunun bir video güncellemesini (aşağıya bakınız) yayınladı. C-3PO düzeyindeki yeteneklere yaklaşan.

Videoda Şekil 01, içinde bir tabak, bir elma ve bir fincan bulunan bir masa takımının arkasında duruyor. Sol tarafta bir süzgeç var. Bir insan robotun önünde duruyor ve robota soruyor: “Şekil 01, şu anda ne görüyorsun?”

Birkaç saniye sonra, Şekil 01 dikkat çekici derecede insan sesi veren bir sesle yanıt verir (yüz yoktur, yalnızca sesle senkronize hareket eden animasyonlu bir ışık), masadaki her şeyi ve önünde duran adamın ayrıntılarını detaylandırır.

“Bu harika” diye düşündüm.

Sonra adam sorar: “Hey, yiyecek bir şeyler alabilir miyim?”

Şekil 01, “Elbette” yanıtını veriyor ve ardından ustaca akıcı bir hareketle elmayı alıp adama veriyor.

“Vay be” diye düşündüm.

Daha sonra adam, Şekil 01’in önündeki çöp kutusundan buruşmuş kalıntıların bir kısmını boşaltıyor ve şu soruyu soruyor: “Bu çöpü toplarken az önce yaptığınız şeyi neden yaptığınızı açıklayabilir misiniz?”

Şekil 01, kağıdı çöp kutusuna geri koyarken gerekçesini açıklamak için hiç vakit kaybetmiyor. “Bu yüzden sana elmayı verdim çünkü bu, sana masadan verebileceğim tek yenilebilir öğeydi.”

“Bu gerçek olamaz” diye düşündüm.

Ancak en azından Şekil AI’ye göre durum böyledir.

Konuşmadan konuşmaya

Şirket, bir açıklamada, Şekil 01’in görüntüleri ve metinleri anlamak için OpenAI’nin önceden eğitilmiş çok modlu modeli VLM’yi kullanarak “konuşmadan konuşmaya” akıl yürütmeyle meşgul olduğunu ve yanıtlarını oluşturmak için tüm bir sesli görüşmeye güvendiğini açıkladı. Bu, örneğin yazılı yönlendirmelere odaklanan OpenAI’nin GPT-4’ünden farklıdır.

Aynı zamanda şirketin “öğrenilmiş düşük seviyeli çift elle manipülasyon” olarak adlandırdığı şeyi de kullanıyor. Sistem, hareketi kontrol etmek için hassas görüntü kalibrasyonlarını (piksel seviyesine kadar) sinir ağıyla eşleştirir. Figure AI bir açıklamada şöyle yazdı: “Bu ağlar, 10 hz’de yerleşik görüntüler alıyor ve 200 hz’de 24 DOF eylemleri (bilek pozları ve parmak eklem açıları) üretiyor.”

Şirket, videodaki her davranışın sistem öğrenimine dayandığını ve uzaktan çalıştırılmadığını, yani perde arkasında kuklacılık yapan kimsenin bulunmadığını iddia ediyor Şekil 01.

Şekil 01’i şahsen görmeden ve kendi sorularımı sormadan bu iddiaları doğrulamak zor. Bunun, Şekil 01’in bu rutini ilk kez gerçekleştirmemesi ihtimali var. 100’üncü kez olmuş olabilir, bu da hızını ve akıcılığını açıklayabilir.

Ya da belki bu %100 gerçektir ve bu durumda vay be. Sadece vay be.