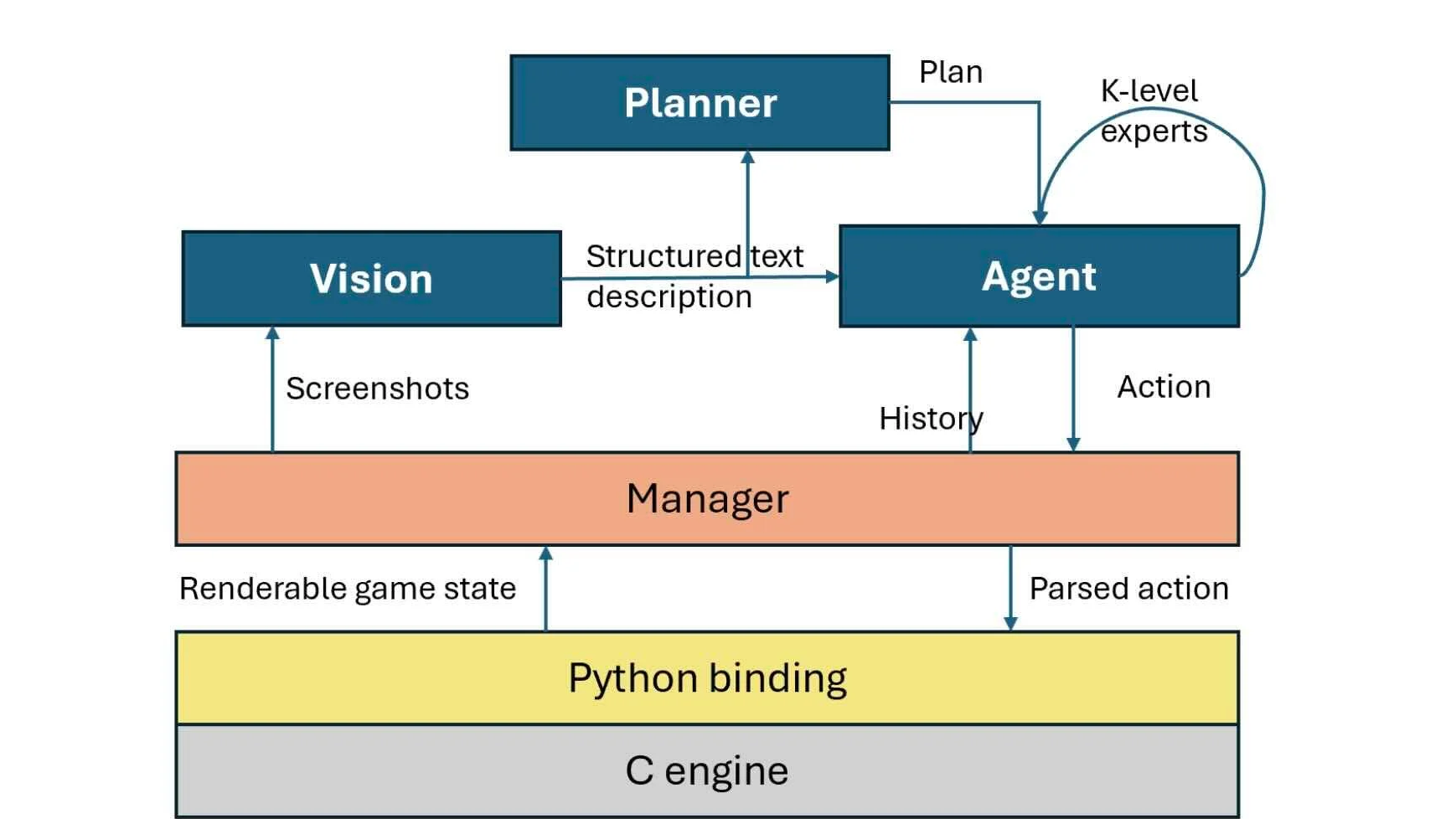

Microsoft bilim insanı ve York Üniversitesi araştırmacısı Adrian de Wynter yakın zamanda GPT-4’ü test etmeye karar verdi ve Doom’u önceden eğitim almadan çalıştırdı. Kayıt. Sonuçlar, GPT-4’ün Doom’u önceden eğitim gerektirmeden bir dereceye kadar etkili bir şekilde oynayabileceği sonucuna varıyor; ancak kurulum, yapay zeka vizyonu için bir GPT-4V arayüzü ve yapay zeka girişlerini mümkün kılmak için Matplotlib ve Python’un eklenmesini gerektiriyor.

Buna göre orijinal kağıtDoom oynayan GPT-4 AI kapıları açabilir, düşmanlarla savaşabilir ve silahları ateşleyebilir. Dünyada gezinmek de dahil olmak üzere temel oyun işlevselliği hemen hemen hepsi mevcut. Bununla birlikte, yapay zekanın nesne kalıcılığı konusunda da hiçbir fikri yok; bir düşman ekranın dışına çıktığı anda yapay zeka artık bunun farkında olmuyor. Ekran dışındaki bir düşmanın hasara neden olması durumunda ne yapılacağına dair talimatlar dahil edilse de model, dar kapsamı dışındaki hiçbir şeye tepki veremiyor.

De Wynter, araştırmasının etik bulgularından bahsederken şunları söylüyor: “Modelin bir şeyi çekmesini sağlamak ve modelin, aslında talimatları ikinci kez tahmin etmeden bir şeyi doğru bir şekilde çekmesini sağlamak için kod oluşturmanın benim için bu kadar kolay olması oldukça endişe verici.”

Şöyle devam ediyor, “Yani bu, planlama ve muhakeme konusunda çok ilginç bir keşif olsa ve otomatik video oyun testlerinde uygulamalara sahip olsa da, bu modelin ne yaptığının farkında olmadığı oldukça açık. Herkesi şunu düşünmeye davet ediyorum: Bu modellerin dağıtımının toplum için ne anlama geldiği ve potansiyel kötüye kullanımları hakkında.”

Elbette haksız değil: Silah teknolojisinin en ileri seviyesi her geçen yıl daha da korkutucu hale geliyor ve yapay zeka zaten başka yerlerde korkutucu bir büyüme ve ekonomik etki gördü. 90’lı yıllarda IBM’in süper bilgisayar destekli Deep Blue, Satranç Büyük Ustası Garry Kasparov’u mağlup etti. Artık tek bir kişinin çabasıyla Doom’da hızlı ve kirli bir GPT-4V çözümümüz var ve çalışıyor. Böyle bir çalışmanın arkasında bir askerin bulunmasıyla neler yapılabileceğini bir düşünün.

Neyse ki henüz en iyilerle aynı seviyede amaç ve mantık yürüten öldürücü robotlar üretmiyoruz. Ultra öldürme Ve Kıyamet ortalama T-800’ün durdurulamaz gücü bir yana. Şimdilik, çoğu insanın endişe duyduğu ana “Yapay Zeka saldırısı”, üretken yapay zeka ve bunun hem bağımsız yaratıcılar hem de sektör profesyonelleri üzerindeki devam eden etkisi ile ilgilidir.

Ancak GPT-4’ün insan şeklindeki nesneleri çekmekten çekinmemesi hala endişe verici. Bu, okuyuculara Isaac Asimov’un robotların insanlara zarar vermeyeceğini dikte eden “Robotik Yasaları”nın her zaman kurgusal olduğunu (her zaman işe yaramasa da) hatırlatmanın en iyi zamanıdır. Umarım yapay zeka projelerini takip edenler, Skynet çevrimiçi olmadan önce insanlık için korumaları kendi modellerine uygun şekilde kodlamanın yollarını bulabilirler.