Resim: Dustin Chambers/Bloomberg, Getty Images aracılığıyla.

OpenAI, ChatGPT ile üretken yapay zeka yarışına liderlik ederek başarılı bir yıl geçirdi. Ancak madalyonun diğer yüzü ise yapay zekanın geliştirilmesinde yeni bir atılım sunduğu anda tüm gözlerin şirkete çevrilmesi. Ve şirket yakın zamanda yapay zeka ile ilgili güvenlikle ilgili yeni bir plan açıkladı.

Bu hafta OpenAI’de yayınlanan Şirketin son teknoloji yapay zeka modellerinin (“sınır modelleri”) güvenliğini garanti altına almak için uygulamaya koyduğu çeşitli önlemleri açıklayan bir uyarı programı olan “Hazırlık Çerçevesi”nin ilk beta sürümü.

Modelleri değerlendirin

Her şeyden önce şirket, avangard modellerin sınırlarını zorlamak için tutarlı değerlendirmeler yapmaya kararlıdır. OpenAI, bu sonuçların şirketin risklerini değerlendirmesine ve önerilen hafifletme önlemlerinin etkinliğini ölçmesine yardımcı olacağını iddia ediyor.

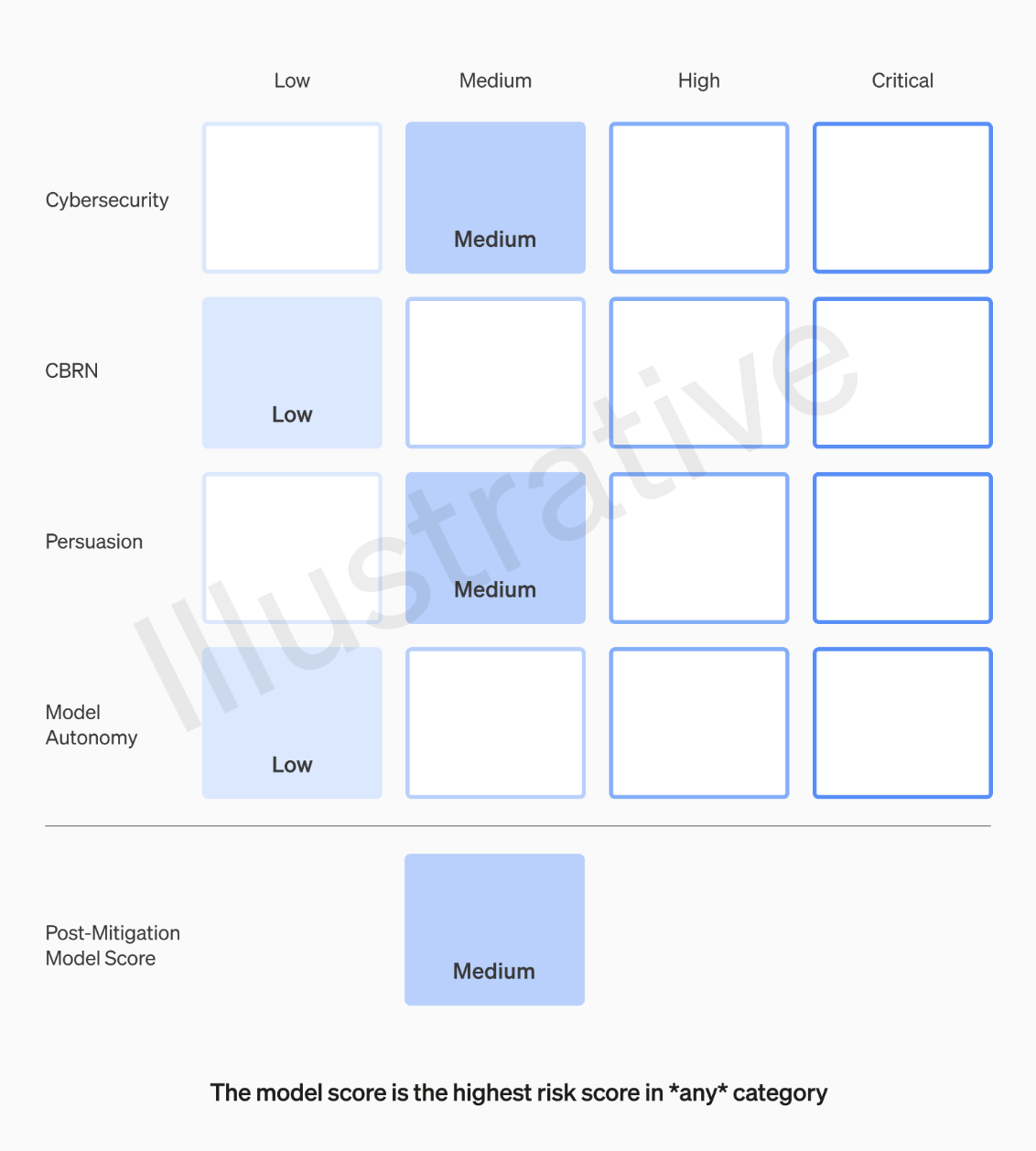

Değerlendirmelerin sonuçları daha sonra risk “puan kartlarında” sunulacaktır (aşağıdaki resme bakınız). Bu haritalar siber güvenlik, ikna, model özerkliği ve KBRN (kimyasal, biyolojik, radyolojik ve nükleer) tehditlerindeki risk eşiklerini yansıtacak şekilde sürekli olarak güncellenecektir.

Resim: OpenAI.

Her risk dört güvenlik düzeyine göre sınıflandırılacaktır: düşük, orta, yüksek ve kritik. Bu puan daha sonra şirketin modele nasıl devam etmesi gerektiğini belirleyecek.

Azaltma sonrasında “ortalama” veya daha düşük derecelendirmeye sahip modeller devreye alınabilir. Makaleye göre yalnızca “yüksek” (veya daha düşük) derecelendirmeye sahip modeller geliştirmeye devam edebilecek.

Ekiplerin yeniden yapılandırılması

OpenAI aynı zamanda ekiplerin karar vermek için şirket içinde çalışma şeklini de yeniden yapılandırıyor.

Özel bir hazırlık ekibi, Vanguard Modelinin değerlendirme yapma ve raporları sentezleme gibi yeteneklerini değerlendirmek için teknik çalışmalara liderlik edecek. Daha sonra, işlevler arası bir güvenlik danışma grubu tüm raporları inceleyecek ve bunları yönetime ve yönetim kuruluna gönderecektir. Son olarak yönetim karar alma pozisyonunu koruyacak ancak yönetim kurulu alınan kararları geri alma hakkına sahip olacak.

Bu yeni organizasyon, geçen ay OpenAI yönetim kurulunun Sam Altman’ı kovmaya karar verdiği dönemeçleri takip etmesi nedeniyle daha da dikkat çekici. Şirketin kurucu ortağının yeni yönetim kuruluyla hızla CEO görevine geri getirilmesi nedeniyle bu karar kısa ömürlü oldu.

Bütün bir program

OpenAI’nin güvenlik gündemi ayrıca artan güvenlik ve dış hesap verebilirlik için bir protokol geliştirmeyi; gerçek dünyadaki suiistimalleri takip etmek için dış taraflar ve dahili ekipler arasında işbirliği; Açıklamaya göre modeller geliştikçe riskin nasıl değiştiğini ölçmek için yeni araştırmalar oluşturmak.

Kaynak : ZDNet.com