Les chercheurs en cybersécurité ont découvert des failles de sécurité dans Noyau d’IA SAP plate-forme basée sur le cloud pour la création et le déploiement de flux de travail d’intelligence artificielle (IA) prédictifs qui pourraient être exploités pour obtenir des jetons d’accès et des données clients.

Les cinq vulnérabilités ont été collectivement surnommées SAP est propriétaire par la société de sécurité cloud Wiz.

« Les vulnérabilités que nous avons découvertes auraient pu permettre aux attaquants d’accéder aux données des clients et de contaminer les artefacts internes, se propageant ainsi aux services associés et aux environnements d’autres clients », a déclaré Hillai Ben-Sasson, chercheur en sécurité. dit dans un rapport partagé avec The Hacker News.

Suite à une divulgation responsable le 25 janvier 2024, les faiblesses ont été corrigées par SAP en date du 15 mai 2024.

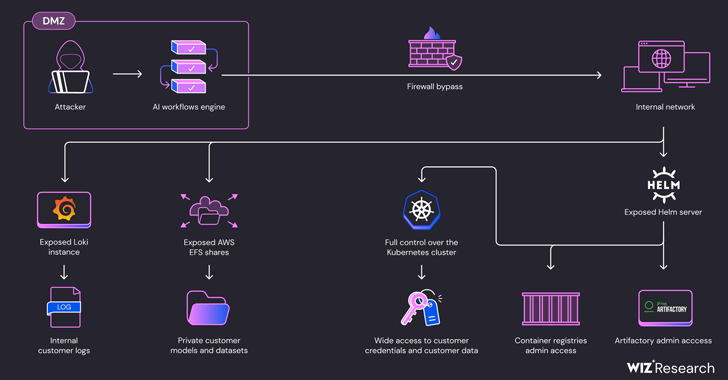

En un mot, les failles permettent d’obtenir un accès non autorisé aux artefacts privés et aux informations d’identification des clients dans des environnements cloud comme Amazon Web Services (AWS), Microsoft Azure et SAP HANA Cloud.

Ils pourraient également être utilisés pour modifier les images Docker sur le registre de conteneurs interne de SAP, les images Docker de SAP sur le registre de conteneurs Google et les artefacts hébergés sur le serveur interne Artifactory de SAP, entraînant ainsi une attaque de la chaîne d’approvisionnement sur les services SAP AI Core.

De plus, l’accès pourrait être utilisé comme arme pour obtenir des privilèges d’administrateur de cluster sur le cluster Kubernetes de SAP AI Core en tirant parti du fait que le serveur du gestionnaire de packages Helm était exposé à la fois aux opérations de lecture et d’écriture.

« En utilisant ce niveau d’accès, un attaquant pourrait accéder directement aux Pods d’autres clients et voler des données sensibles, telles que des modèles, des ensembles de données et du code », a expliqué Ben-Sasson. « Cet accès permet également aux attaquants d’interférer avec les Pods des clients, de corrompre les données d’IA et de manipuler les inférences des modèles. »

Wiz a déclaré que les problèmes surviennent en raison du fait que la plateforme permet d’exécuter des modèles d’IA malveillants et des procédures de formation sans mécanismes d’isolement et de sandboxing adéquats.

« Les récentes failles de sécurité des fournisseurs de services d’IA comme Hugging Face, Replicate et SAP AI Core mettent en évidence des vulnérabilités importantes dans leurs implémentations d’isolation et de segmentation des locataires », a déclaré Ben-Sasson à The Hacker News. « Ces plateformes permettent aux utilisateurs d’exécuter des modèles d’IA et des procédures de formation non fiables dans des environnements partagés, augmentant ainsi le risque que des utilisateurs malveillants puissent accéder aux données d’autres utilisateurs. »

« Contrairement aux fournisseurs de cloud traditionnels qui ont une vaste expérience des pratiques d’isolation des locataires et utilisent des techniques d’isolation robustes comme les machines virtuelles, ces nouveaux services manquent souvent de ces connaissances et s’appuient sur la conteneurisation, qui offre une sécurité plus faible. Cela souligne la nécessité de sensibiliser à l’importance de l’isolation des locataires et d’inciter le secteur des services d’IA à renforcer ses environnements. »

Par conséquent, un acteur malveillant pourrait créer une application d’IA classique sur SAP AI Core, contourner les restrictions réseau et sonder le réseau interne du Kubernetes Pod pour obtenir des jetons AWS et accéder au code client et aux ensembles de données de formation en exploitant les erreurs de configuration dans les partages AWS Elastic File System (EFS).

« Les gens doivent être conscients que les modèles d’IA sont essentiellement du code. Lorsque vous exécutez des modèles d’IA sur votre propre infrastructure, vous pourriez être exposé à des attaques potentielles de la chaîne d’approvisionnement », a déclaré Ben-Sasson.

« Exécutez uniquement des modèles fiables provenant de sources fiables et séparez correctement les modèles externes des infrastructures sensibles. Lorsque vous faites appel à des fournisseurs de services d’IA, il est important de vérifier leur architecture d’isolation des locataires et de vous assurer qu’ils appliquent les meilleures pratiques. »

Ces résultats surviennent alors que Netskope a révélé que l’utilisation croissante de l’IA générative par les entreprises a incité les organisations à utiliser des contrôles de blocage, des outils de prévention des pertes de données (DLP), un coaching en temps réel et d’autres mécanismes pour atténuer les risques.

« Les données réglementées (données que les organisations ont l’obligation légale de protéger) représentent plus d’un tiers des données sensibles partagées avec les applications d’IA générative (genAI) – ce qui présente un risque potentiel pour les entreprises de violations de données coûteuses », a déclaré la société. dit.

Ils suivent également l’émergence d’un nouveau groupe de cybercriminels appelé NullBulge qui a ciblé les entités axées sur l’IA et les jeux depuis avril 2024 dans le but de voler des données sensibles et de vendre des clés API OpenAI compromises dans des forums clandestins tout en prétendant être une équipe de hacktivistes « protégeant les artistes du monde entier » contre l’IA.

« NullBulge cible la chaîne d’approvisionnement des logiciels en militarisant le code dans les référentiels accessibles au public sur GitHub et Hugging Face, ce qui conduit les victimes à importer des bibliothèques malveillantes ou via des packs de mods utilisés par les logiciels de jeu et de modélisation », explique Jim Walter, chercheur en sécurité chez SentinelOne. dit.

« Le groupe utilise des outils comme AsyncRAT et XWorm avant de livrer des charges utiles LockBit créées à l’aide du générateur LockBit Black qui a fuité. Des groupes comme NullBulge représentent la menace permanente des ransomwares à faible barrière d’entrée, combinée à l’effet persistant des infections par vol d’informations. »