Le ministère américain de la Justice (DoJ) a déclaré avoir saisi deux domaines Internet et fouillé près de 1 000 comptes de réseaux sociaux que des acteurs de la menace russe auraient utilisés pour diffuser secrètement de la désinformation pro-Kremlin dans le pays et à l’étranger à grande échelle.

« La ferme de robots des médias sociaux a utilisé des éléments d’IA pour créer des profils de médias sociaux fictifs – prétendant souvent appartenir à des individus aux États-Unis – que les opérateurs ont ensuite utilisés pour promouvoir des messages en faveur des objectifs du gouvernement russe », a déclaré le ministère de la Justice. dit.

Le réseau de robots, comprenant 968 comptes sur X, ferait partie d’un plan élaboré élaboré par un employé du média d’État russe RT (anciennement Russia Today), parrainé par le Kremlin et aidé par un officier du Service fédéral de sécurité russe (FSB), qui a créé et dirigé une organisation de renseignement privée anonyme.

Les efforts de développement de la ferme de robots ont commencé en avril 2022, lorsque les individus se sont procuré une infrastructure en ligne tout en anonymisant leurs identités et leurs emplacements. L’objectif de l’organisation, selon le ministère de la Justice, était de promouvoir les intérêts russes en diffusant de la désinformation par le biais de personnages en ligne fictifs représentant diverses nationalités.

Les faux comptes de réseaux sociaux ont été enregistrés à l’aide de serveurs de messagerie privés qui s’appuyaient sur deux domaines – mlrtr[.]com et otanmail[.]com – qui ont été achetés auprès du registraire de domaines Namecheap. X a depuis suspendu les comptes de robots pour violation de ses conditions de service.

L’opération d’information – qui ciblait les États-Unis, la Pologne, l’Allemagne, les Pays-Bas, l’Espagne, l’Ukraine et Israël – a été menée à bien à l’aide d’un logiciel basé sur l’IA baptisé Meliorator, qui a facilité la création et l’exploitation « en masse » de cette ferme de robots de médias sociaux.

« En utilisant cet outil, les affiliés de RT ont diffusé de la désinformation vers et sur un certain nombre de pays, dont les États-Unis, la Pologne, l’Allemagne, les Pays-Bas, l’Espagne, l’Ukraine et Israël », ont déclaré les forces de l’ordre du Canada, des Pays-Bas et des États-Unis.

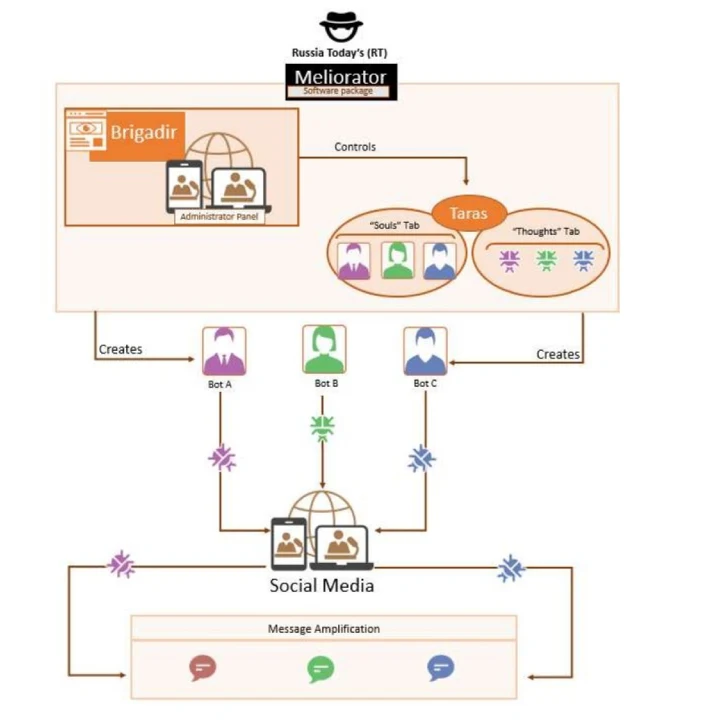

Meliorator comprend un panneau d’administration appelé Brigadir et un outil backend appelé Taras, qui est utilisé pour contrôler les comptes d’apparence authentique, dont les photos de profil et les informations biographiques ont été générées à l’aide d’un programme open source appelé Faker.

Chacun de ces comptes avait une identité ou « âme » distincte basée sur l’un des trois archétypes de bots : ceux qui propagent des idéologies politiques favorables au gouvernement russe, comme les messages déjà partagés par d’autres bots, et perpétuent la désinformation partagée par les comptes bots et non-bots.

Bien que le progiciel n’ait été identifié que sur X, une analyse plus approfondie a révélé l’intention des acteurs de la menace d’étendre ses fonctionnalités pour couvrir d’autres plateformes de médias sociaux.

De plus, le système a contourné les mesures de sécurité de X pour vérifier l’authenticité des utilisateurs en copiant automatiquement les codes d’accès à usage unique envoyés aux adresses e-mail enregistrées et en attribuant des adresses IP proxy aux personnages générés par l’IA en fonction de leur emplacement supposé.

« Les comptes de robots tentent de manière évidente d’éviter les interdictions pour violation des conditions d’utilisation et d’éviter d’être remarqués en tant que robots en se fondant dans l’environnement plus large des réseaux sociaux », ont déclaré les agences. « Tout comme les comptes authentiques, ces robots suivent des comptes authentiques reflétant leurs convictions politiques et leurs intérêts énumérés dans leur biographie. »

« L’agriculture est un passe-temps apprécié par des millions de Russes », a déclaré RT cité comme il l’a déclaré à Bloomberg en réponse aux allégations, sans les réfuter directement.

C’est la première fois que les États-Unis pointent publiquement du doigt un gouvernement étranger pour avoir utilisé l’intelligence artificielle dans le cadre d’une opération d’influence étrangère. Aucune accusation criminelle n’a été portée publiquement dans cette affaire, mais une enquête sur cette activité est toujours en cours.

Le sosie continue à vivre

Ces derniers mois, Google, Meta et OpenAI ont averti que les opérations de désinformation russes, y compris celles orchestrées par un réseau surnommé Doppelganger, ont utilisé à plusieurs reprises leurs plateformes pour diffuser de la propagande pro-russe.

« La campagne est toujours active ainsi que l’infrastructure réseau et serveur responsable de la distribution du contenu », Qurium et DésinfoLab de l’UE a déclaré dans un nouveau rapport publié jeudi.

« Étonnamment, Doppelganger n’opère pas depuis un centre de données caché dans une forteresse de Vladivostok ou depuis une grotte militaire isolée, mais depuis des fournisseurs russes nouvellement créés opérant dans les plus grands centres de données d’Europe. Doppelganger opère en étroite collaboration avec des activités cybercriminelles et des réseaux publicitaires affiliés. »

Au cœur de l’opération se trouve un réseau de fournisseurs d’hébergement à toute épreuve englobant Aeza, Evil Empire, GIR et TNSECURITEqui ont également hébergé des domaines de commande et de contrôle pour différentes familles de logiciels malveillants comme Stealc, Amadey, Agent Tesla, Glupteba, Raccoon Stealer, RisePro, RedLine Stealer, RevengeRAT, Lumma, Meduza et Mystic.

De plus, NewsGuard, qui fournit une multitude d’outils pour lutter contre la désinformation, récemment trouvé que les chatbots IA populaires ont tendance à répéter « des récits fabriqués à partir de sites affiliés à l’État se faisant passer pour des médias locaux dans un tiers de leurs réponses ».

Opérations d’influence de l’Iran et de la Chine

Cela intervient également alors que le Bureau du directeur du renseignement national des États-Unis (ODNI) dit que l’Iran « devient de plus en plus agressif dans ses efforts d’influence à l’étranger, cherchant à attiser la discorde et à saper la confiance dans nos institutions démocratiques ».

L’agence a également noté que les acteurs iraniens continuent d’affiner leurs activités de cybersécurité et d’influence, en utilisant les plateformes de médias sociaux et en émettant des menaces, et qu’ils amplifient les manifestations pro-Gaza aux États-Unis en se faisant passer pour des militants en ligne.

Google, pour sa part, a déclaré avoir bloqué au premier trimestre 2024 plus de 10 000 instances d’activité Dragon Bridge (alias Spamouflage Dragon), qui est le nom donné à un réseau d’influence spammé mais persistant lié à la Chine, sur YouTube et Blogger qui promouvait des récits présentant les États-Unis sous un jour négatif ainsi que du contenu lié aux élections à Taiwan et à la guerre Israël-Hamas ciblant les locuteurs chinois.

En comparaison, le géant de la technologie a perturbé pas moins de 50 000 cas de ce type en 2022 et 65 000 autres en 2023. Au total, il a empêché plus de 175 000 cas à ce jour pendant la durée de vie du réseau.

« Malgré leur production continue de contenu abondante et l’ampleur de leurs opérations, DRAGONBRIDGE n’obtient pratiquement aucun engagement organique de la part des téléspectateurs réels », a déclaré Zak Butler, chercheur du Threat Analysis Group (TAG). dit« Dans les cas où le contenu DRAGONBRIDGE a suscité un engagement, il était presque entièrement inauthentique, provenant d’autres comptes DRAGONBRIDGE et non d’utilisateurs authentiques. »