Se espera que las falsificaciones profundas se conviertan en un vector de ataque más prominente. Aquí se explica cómo identificarlos.

¿Qué son las falsificaciones profundas?

Una falsificación profunda es el acto de reemplazar de manera maliciosa imágenes y videos reales con otros fabricados para manipular la información. Para crear imágenes, videos y audio que tengan la calidad suficiente para usarse en falsificaciones profundas, se requieren IA y ML. Dicho uso de IA, ML y reemplazo de imágenes es diferente a otros tipos de manipulación de la información, que utilizan técnicas de manipulación menos extremas, como tergiversar la información, aislar partes de la información o editarla de manera engañosa. Etay Maor, director sénior de estrategia de seguridad de Cato Networks, agrega: “Para agregar complicaciones, los avances recientes y la accesibilidad al texto generado por IA, como GPT3, ya se han utilizado en combinación con falsificaciones profundas (como prueba de concepto) para crear contenido interactivo, bots de conversación de aspecto humano”

¿Qué aspecto tienen las falsificaciones profundas?

Las falsificaciones profundas vienen en todas las formas y tamaños. Algunos son más simples y otros son más avanzados. Algunos de los ejemplos más populares de falsificaciones profundas son:

Intercambio cara

El intercambio de caras es el acto de reemplazar la cara en un video o imagen de una persona a otra. El intercambio de rostros requiere un software dedicado, pero no tiene que estar basado en tecnología avanzada; hoy en día, incluso se pueden encontrar aplicaciones móviles que admitan el intercambio de rostros. El intercambio de rostros que está disponible en las aplicaciones móviles generalmente se limita a casos de uso simples, como intercambiar entre las fotos del usuario y los rostros de los actores en escenas de películas.

Existe un intercambio de caras más avanzado, pero requiere más entrenamiento y código de modelo y, como resultado, GPU, que es costosa y consume muchos recursos. Un ejemplo de una falsificación profunda de intercambio de caras más avanzada se puede ver en este video, en el que Tom Cruise se intercambia con la cara del presentador:

Este tom crucero intercambio cara requirió dos horas de capacitación en una GPU, así como días de posprocesamiento de edición de video profesional. Esto puede parecer mucho, pero también se consideró un intercambio más simple que otros, porque el presentador tenía un corte de cabello similar al de Cruise y puede hacerse pasar por su voz, lo que significa que se requirió menos capacitación y procesamiento posterior.

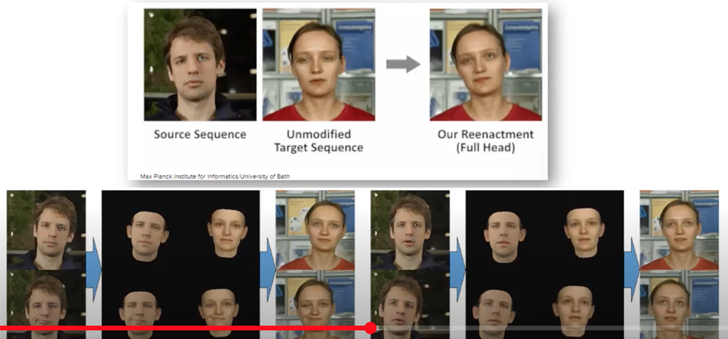

Titiritero (sincronización de labios)

La falsificación profunda de ‘Puppet Master’ es una técnica en la que se manipula la imagen de los movimientos de la boca de una persona, haciendo que parezca que la persona está diciendo algo que en realidad no ha dicho. En comparación con el intercambio de rostros, que entrena a un modelo en el nuevo rostro intercambiado, ‘Puppet Master’ entrena a un modelo en el rostro de la imagen original, y específicamente en los movimientos de la boca.

Esto es lo que parece:

[warning – explicit language]

La tecnología detrás de ‘Puppet Master’ se basa en sintetizar la máscara, es decir, la imagen original, y colocarla encima del modelo de la persona que está suplantando y sincronizando los labios.

Audio

El tercer tipo destacado de falsificación profunda está basado en audio. Las falsificaciones profundas de audio son archivos de audio que toman la voz de una persona real y hacen que suene como si estuviera diciendo algo que nunca había dicho. Las falsificaciones profundas de audio se crean tomando archivos de audio, asignando anotaciones a los sonidos, entrenando un modelo ML basado en las anotaciones para asociar sonidos con texto y luego generando un nuevo archivo de audio.

Esto es lo que suena:

Falsificaciones profundas frente a arreglos baratos

No todas las imágenes o el audio modificados son falsificaciones profundas. Mientras que las falsificaciones profundas son medios sintetizados o modificados con IA, las soluciones baratas son medios sintetizados o modificados con métodos de baja tecnología, que son fáciles de detectar. A menudo tienen distorsiones y han sido claramente manipuladas. Así es como se ve una solución barata:

El riesgo cibernético de las falsificaciones profundas

Las falsificaciones profundas se han vuelto más realistas y accesibles, y también son más rápidas de crear que nunca. Esto los convierte en una herramienta poderosa para la militarización. Como resultado, representan un riesgo para las empresas y para los países. Pueden ser utilizados para delitos cibernéticos, ingeniería social, fraude, por parte de naciones que amenazan para influir en operaciones extranjeras y más.

Por ejemplo, se usó deep fake para imitar la voz de un director ejecutivo y convencer a un ejecutivo de transferir $243,000 a una cuenta fraudulenta. Etay Maor de Cato Networks “El correo electrónico comercial comprende y Los ataques de phishing son cada vez más difíciles de detectar basado en un simple análisis del lenguaje utilizado. Existe la necesidad de un enfoque holístico, como el que ofrece una solución SASE de un solo proveedorque puede detectar el ataque en diferentes cuellos de botella múltiples y no depender de productos puntuales aislados que están condenados a fallar”. En otro caso, se presentó una falsificación profunda como prueba en un caso de custodia de menores.

Las falsificaciones profundas también se pueden utilizar para difundir desinformación, es decir, distribución falsa de información para influir en la opinión pública u ocultar la verdad. Por ejemplo, las falsificaciones profundas podrían usarse para hacerse pasar por líderes mundiales y provocar un ataque, o para hacerse pasar por un director ejecutivo y manipular el precio de las acciones de una empresa. En otros casos, las falsificaciones profundas permiten una negación plausible, en la que las personas pueden negar todas las fuentes de los medios al afirmar que son falsificaciones profundas, lo que crea un abuso de confianza social.

Finalmente, el deep fake puede usarse para difamar, es decir, dañar la buena reputación de alguien. Por ejemplo, creando porno de venganza.

Cómo detectar falsificaciones profundas

Hay dos tipos principales de métodos para detectar con precisión falsificaciones profundas:

- Métodos de detección de bajo nivel

- Métodos de detección de alto nivel

Métodos de detección de bajo nivel

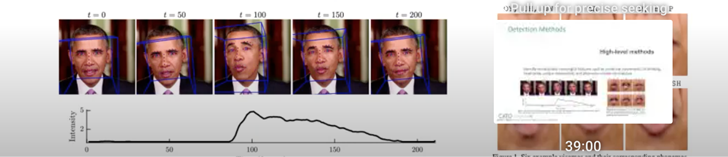

Los métodos de detección de bajo nivel se basan en modelos ML que están entrenados para identificar artefactos o pixelaciones que se introdujeron a través del proceso de generación de falsificaciones profundas. Estos artefactos pueden ser imperceptibles para el ojo humano, pero los modelos, que fueron entrenados con imágenes reales e imágenes falsas profundas, pueden detectarlos.

Métodos de detección de alto nivel

Los métodos de detección de alto nivel utilizan modelos que pueden identificar características semánticamente significativas. Estos incluyen movimientos no naturales, como parpadeo, pose de cabeza o gestos únicos, y desajustes de fonema-visema.

Hoy en día, estos métodos de detección se consideran precisos. Sin embargo, a medida que la tecnología deep fake mejora y se vuelve más sofisticada, se espera que se vuelvan menos efectivas y deberán actualizarse y mejorarse. Además de estas técnicas, cada uno de nosotros puede ayudar a detectar falsificaciones profundas al verificar la fuente de medios de los videos e imágenes que recibimos.

Para obtener más información sobre los diferentes tipos de ataques de ciberseguridad y cómo prevenirlos, La serie de clases magistrales de seguridad cibernética de Cato Networks está disponible para su visualización.