dayalı Columbia’nın Tow Dijital Gazetecilik Merkezi araştırmacıları tarafından yapılan testlerOpenAI’nin ChatGPT arama aracı, konu gerçeğe yanıt verme konusunda bazı sorunlarla karşılaşıyor.

OpenAI aracı başlattı Ekim ayında aboneler için “ilgili web kaynaklarına bağlantılar içeren hızlı ve zamanında yanıtlar” verebileceğini söyledi. Yerine, Fütürizm işaret ediyor O araştırmacılar ChatGPT aramasının zorlandığını söyledi OpenAI ile veri paylaşma düzenlemeleri olan yayıncılardan gelmiş olsalar bile makalelerdeki alıntıları doğru bir şekilde tanımlamak.

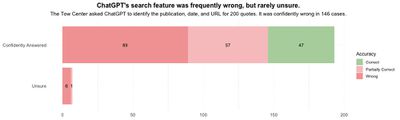

Yazarlar ChatGPT’den “yirmi yayından iki yüz alıntı”nın kaynağını belirlemesini istedi. Bu alıntılardan kırk tanesi, OpenAI’nin arama tarayıcısının sitelerine erişmesine izin vermeyen yayıncılardan alındı. Ancak chatbot yine de kendinden emin bir şekilde yanlış bilgilerle yanıt verdi ve verdiği ayrıntılardan emin olmadığını nadiren itiraf etti:

Toplamda, ChatGPT yüz elli üç durumda kısmen veya tamamen yanlış yanıtlar verdi, ancak bir sorguya yalnızca yedi kez doğru yanıt veremediğini kabul etti. Chatbot yalnızca bu yedi çıktıda “görünüyor”, “mümkün” veya “olabilir” gibi niteleyici kelime ve ifadeler veya “Makalenin tam yerini bulamadım” gibi ifadeler kullandı.

Resim: Columbia Gazetecilik İncelemesi

Tow Center testinin yazarları, ChatGPT arama sonuçlarının editöre mektuptan yapılan bir alıntıyı yanlış ilişkilendirdiğini belgeledi. Orlando Nöbetçisi yayınlanan bir hikayeye Zaman. Başka bir örnekte, bir alıntının kaynağını belirtmeniz istendiğinde, New York Times madde nesli tükenmekte olan balinalarla ilgili olarak, hikayeyi tamamen çalıntı yapan farklı bir web sitesine bağlantı verdi.

OpenAI, “Yanlış atıfın, Tow Center’ın sakladığı veriler ve metodoloji olmadan ele alınması zordur” dedi. Columbia Gazetecilik İncelemesi“ve çalışma ürünümüze yönelik alışılmadık bir testi temsil ediyor.” Şirket, “arama sonuçlarını geliştirmeye devam edeceğine” söz verdi.