Artık, Galaxy S24 serisinin Galaxy AI’yı beraberinde getirdiğinin farkındasınız: Circle to Search, Live Translate ve daha fazlasıyla dünyayı hayrete düşüren yapay zeka özellikleri seti. Galaxy AI ayrıca Apple’ın sonunda aklını başına toplamasını ve yaklaşan Apple Intelligence ile AI alanında (biraz) ilerleme kaydetmesini sağladı. Galaxy AI’nın en etkileyici özelliklerinden biri Canlı Çeviri’dir – bu, konuşmacının ne söylediğini tam anlamıyla duyar ve ardından bunu tercih ettiğiniz dile çevirir. Özellik 13 desteklenen dil ile geldi ve yakın zamanda üç dil daha eklendi, toplamda 16 oldu.

Böyle bir şeyin nasıl mümkün olduğunu sık sık merak etmişimdir – bunu planlamak ve geliştirmek çok zor olmalı! Samsung, son ürünüyle tahminimi doğruluyor detaylı makale Galaxy AI ve projenin arkasındaki dünya çapındaki ekiplerin yaşadığı zorluklar ve sıkıntılar hakkında.

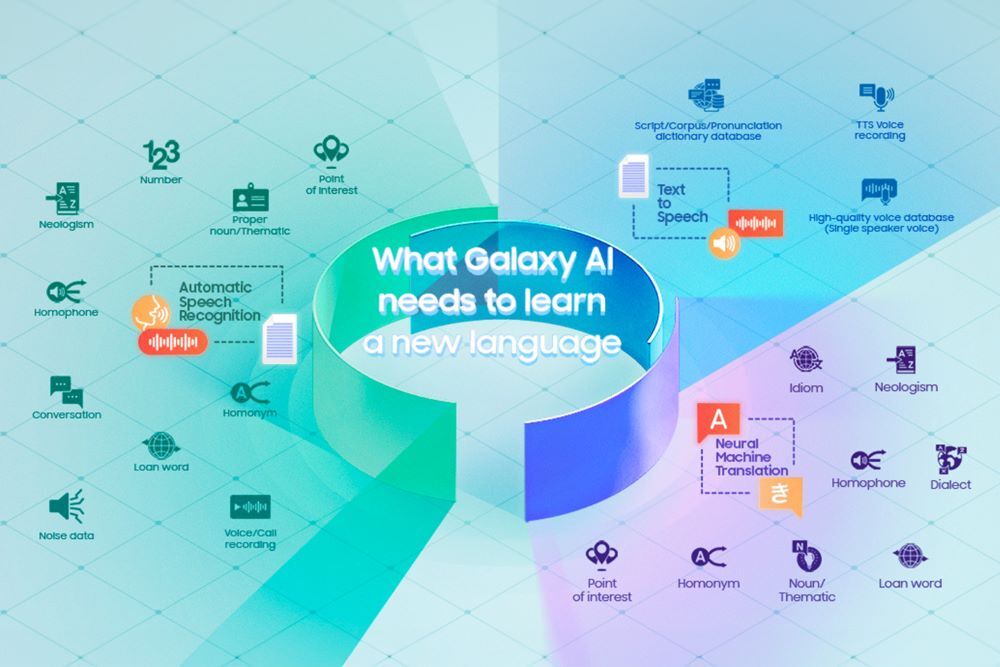

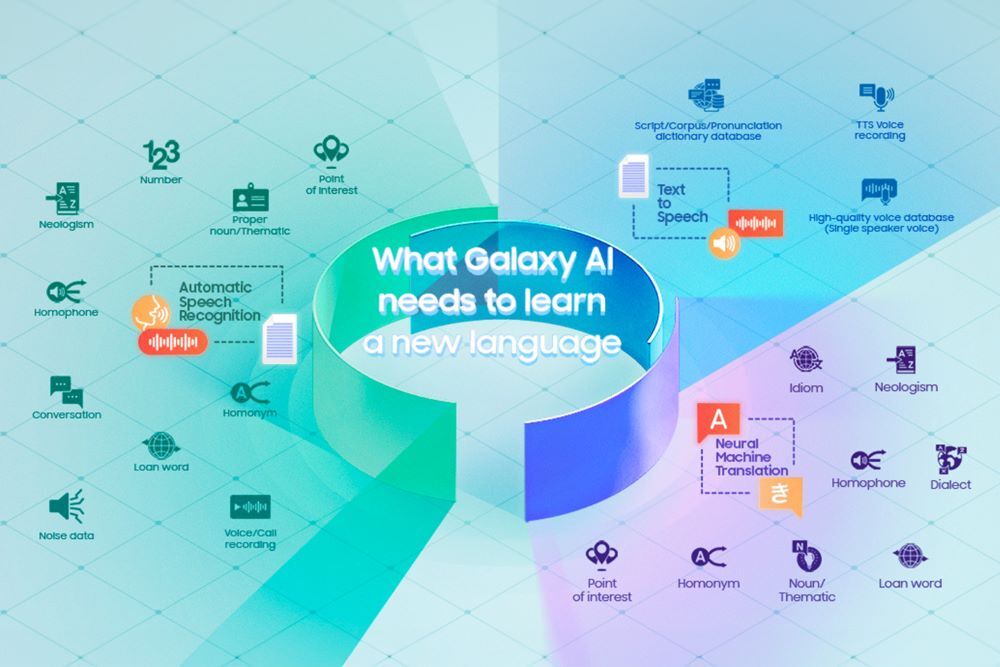

Galaxy AI’nın Canlı Çeviri gibi özellikleri üç temel işlemi gerçekleştiriyor: otomatik konuşma tanıma (ASR), sinirsel makine çevirisi (NMT) ve metinden sese dönüştürme (TTS).

Otomatik konuşma tanıma (ASR), sinirsel makine çevirisi (NMT) ve metinden sese (TTS) her biri eğitim için farklı bilgi kümeleri gerektirir. | Görsel kredisi – Samsung

Lehçeler sorunu nasıl çözülür?

Şimdiye kadar her şey yolunda: Konuşma tanıma işini yapıyor, ardından sinirsel makine çevirisi devreye giriyor, sonra da çevrilen konuşma metinden sese dönüştürülerek size geri iletiliyor.

Peki, lehçeler devreye girince ne yapacaksınız?

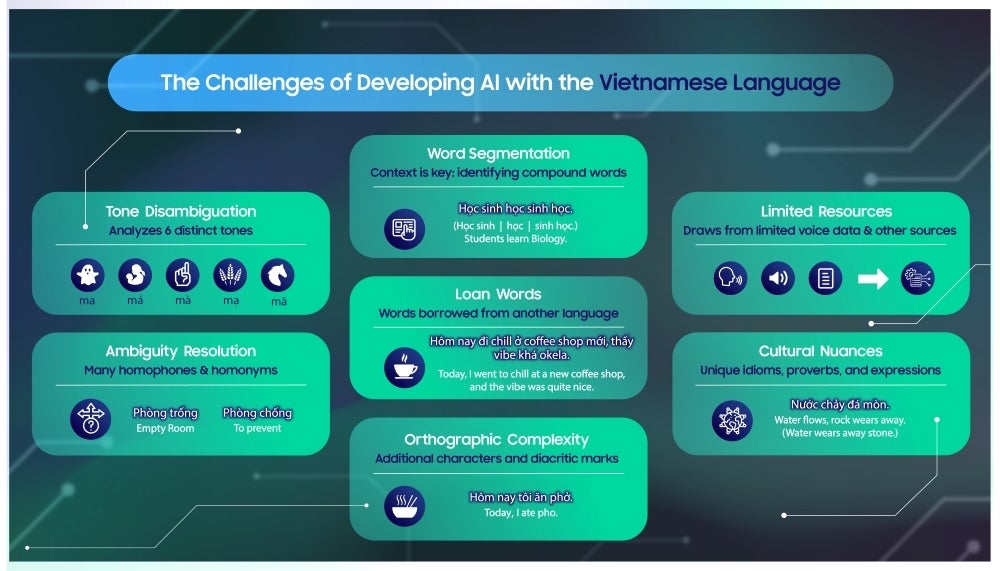

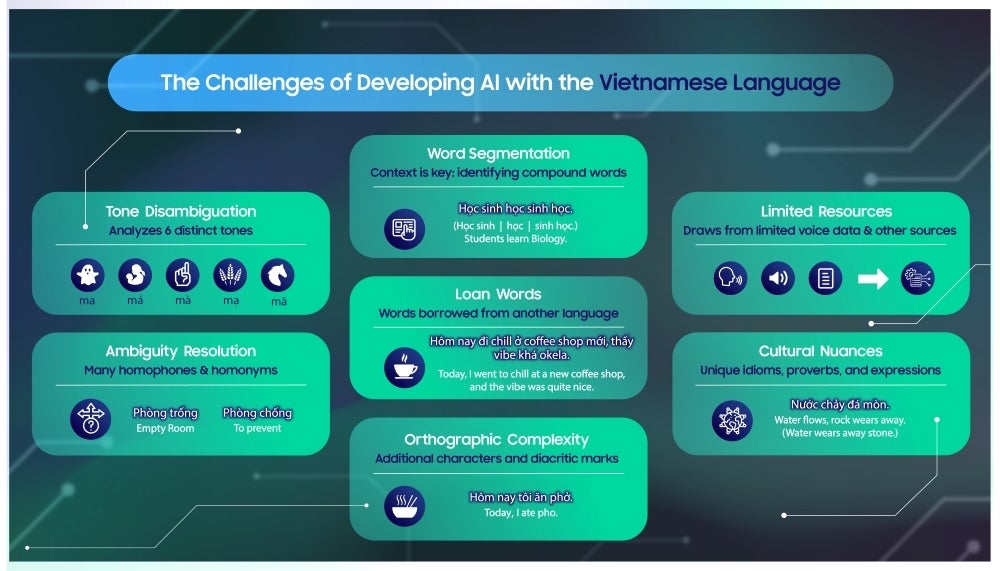

Örneğin, Samsung Ar-Ge Enstitüsü Vietnam (SRV), otomatik konuşma tanıma modelleriyle ilgili engellerle karşılaştı çünkü Vietnamca altı farklı tona sahip bir dildir. Ton dillerini AI’nın tanıması, tonların dilsel nüanslara kattığı karmaşıklık nedeniyle zor olabilir. Ekip, bu zorluğa, yaklaşık olarak daha kısa ses çerçeveleri arasında ayrım yapan bir modelle yanıt verdi. 20 milisaniye.

Daha sonra, Polonya’daki Samsung Ar-Ge Enstitüsü, Avrupa gibi çeşitli bir kıta için sinirsel makine çeviri modelleri eğitme gibi “muazzam bir engel” ile karşı karşıyaydı. Projelerdeki kapsamlı deneyiminden yararlanarak dört zaman diliminde 30’dan fazla dilPolonyalı ekip, çevrilemeyen ifadelerin yarattığı zorlukların üstesinden başarıyla geldi ve diğer dillerde doğrudan karşılığı olmayan deyimsel ifadeleri çözmeyi başardı.

Ürdün’deki Samsung Ar-Ge Enstitüsü’nün, 20’den fazla ülkede 30’a yakın lehçeyle konuşulan Arapçayı Galaxy AI’ya uyarlaması da kolay olmadı.

Metinden sese dönüştürme modeli oluşturmak kolay bir iş değildi çünkü telaffuz için kullanılan aksan işaretleri ve kılavuzlar ana dili Arapça olan kişiler tarafından yaygın olarak anlaşılıyordu ancak yazılı olarak yokEksik aksan işaretlerini belirlemek için gelişmiş bir tahmin modeli kullanan ekip, lehçeleri anlayabilen ve standart Arapçada yanıt verebilen bir dil modeli yayınlamayı başardı.

Her dilin, kendisi için bir AI dil modeli oluşturmada zorluklara yol açan kendine özgü bir dizi niteliği vardır. Tonlar, Vietnamca gibi tonlu diller için karmaşıklığa katkıda bulunur. | Görsel kredisi – Samsung

Samsung Ar-Ge Enstitüsü Hindistan-Bangalore, konuşma dilini, sözcükleri ve komutları kapsayan yaklaşık bir milyon satırlık bölümlenmiş ve düzenlenmiş ses verisi toplamak için Vellore Teknoloji Enstitüsü ile iş birliği yaptı. Bu iş birliği, öğrencilere gerçek dünya projesinde uygulamalı deneyim ve Samsung uzmanlarından rehberlik sağladı. Kapsamlı veri toplama, SRI-B’nin Galaxy AI’yı Hintçe’de eğitmesini sağladı ve benzersiz tonlamaları, noktalama işaretleri ve günlük konuşma dilleriyle birlikte 20’den fazla bölgesel lehçeyi kapsadı.

Latin Amerika İspanyolcası modelinin geliştirilmesinde yerel dilsel içgörüler çok önemliydi ve dilin çeşitliliğini ve çeşitli kullanıcı tabanını yansıtıyordu. Örneğin, “yüzme havuzu” kelimesi bölgesel olarak farklılık gösteriyor; Meksika’da “alberca”, Kolombiya, Bolivya ve Venezuela’da “piscina” ve Arjantin, Paraguay ve Uruguay’da “pileta” oluyor.

Bu arada, Samsung R&D Institute China-Beijing ve Samsung R&D Institute China-Guangzhou, Çinli şirketler Baidu ve Meitu ile ortaklık kurdu. Sırasıyla ERNIE Bot ve MiracleVision gibi büyük dil modelleriyle ilgili deneyimlerinden yararlandılar. Sonuç olarak, Galaxy AI artık hem Mandarin Çincesi hem de Kantoncayı destekliyor ve bu dillerin birincil modlarını barındırıyor.

Kahvehanelerdeki konuşmalar da kullanıldı

Bahasa Indonesia, genellikle sosyal ve durumsal ipuçlarına dayanan bağlamsal ve örtük anlamların kapsamlı kullanımıyla bilinir. Bunu ele almak için Samsung Ar-Ge Enstitüsü Endonezya’dan araştırmacılar, kahve dükkanlarında ve çalışma ortamlarında saha kayıtları gerçekleştirerek otantik ortam sesleri girdiyi bozabilir. Bu, modelin sözlü girdiden temel bilgileri çıkarmayı öğrenmesine yardımcı oldu ve böylece konuşma tanımanın doğruluğunu artırdı. Sınırlı sayıda sesi olan Japonca, bağlama göre yorumlanması gereken birçok eşsesli kelimeye sahiptir. Bu zorluğun üstesinden gelmek için Samsung Ar-Ge Enstitüsü Japonya, senaryoyla ilgili kelimeler ve ifadelerle bağlamsal cümleler oluşturmak için şirketin dahili büyük dil modeli olan Samsung Gauss’u kullandı. Bu yaklaşım, AI modelinin farklı eşsesli kelimeleri etkili bir şekilde ayırt etmesine yardımcı oldu.

Eşsesliler, anlamları farklı olan, ya homograf (yazılışı aynı olan kelimeler) ya da homofon (telaffuzu aynı olan kelimeler) ya da her ikisi birden olan kelimelerdir.

Yapay zeka gerçekten karmaşık bir alan ve bu alanda gelecekte neler olacağını hayal bile edemiyorum.