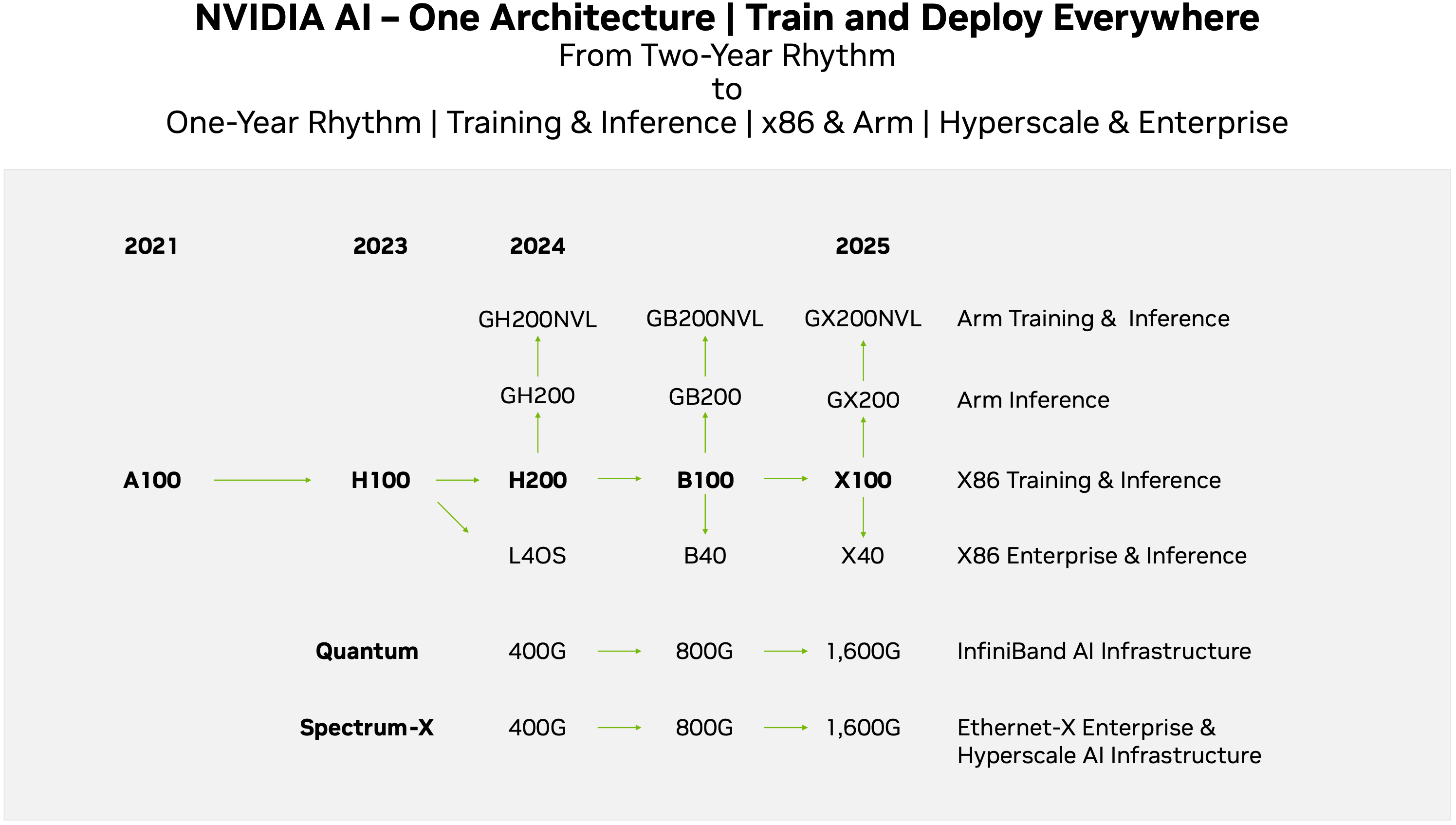

Yapay zeka (AI) ve yüksek performanslı bilgi işlem (HPC) donanımı alanındaki liderliğini sürdürmek amacıyla Nvidia, yeni GPU mimarilerinin geliştirilmesini hızlandırmayı ve esas olarak ürün tanıtımları için bir yıllık temposuna geri dönmeyi planlıyor. Yatırımcılar için yol haritası yayınlandı ve ayrıca şu şekilde açıklanmıştır: Yarı Analiz. Sonuç olarak Nvidia’nın Blackwell’i 2024’te gelecek ve 2025’te yerini yeni bir mimari alacak.

Ancak Blackwell gelecek yıl gelmeden önce (muhtemelen gelecek yılın ikinci yarısında), Nvidia, Hopper mimarisine dayalı birçok yeni ürünü piyasaya sürmeye hazırlanıyor. Bu, H100’ün daha yüksek verim veya yalnızca daha yüksek performans için yeniden döndürülmüş hali olabilecek H200 ürününün yanı sıra Arm tabanlı CPU ve Hopper ile büyük dil modellerinde eğitim ve çıkarımları ele alacak GH200NVL’yi içerir. GPU tabanlı. Bunların çok daha erken gelmesi planlanıyor.

Blackwell ailesine gelince, 2024’te gelecek olan Nvidia, B100 ürününü, H100’ün yerini alacak x86 platformlarında AI ve HPC hesaplaması için hazırlayacak gibi görünüyor. Buna ek olarak şirket, çıkarımı hedefleyen ve muhtemelen Arm CPU ve Hopper GPU içeren Grace Hopper modülü olan GB200’ün yanı sıra LLM eğitimi ve çıkarımı için Arm tabanlı bir çözüm olan GB200NVL’yi de hazırlıyor. Ayrıca şirket, muhtemelen yapay zeka çıkarımı için istemci GPU tabanlı bir çözüm olan B40 ürününü de planlıyor.

2025 yılında Blackwell’in yerini, şimdilik muhtemelen yer tutucu olan X harfiyle gösterilen bir mimari alacak. Her neyse, Nvidia, X100’ü x86 AI eğitimi ve çıkarımının yanı sıra HPC, Arm çıkarımı için GX200 (Grace CPU + X GPU) ve Arm tabanlı LLM eğitimi ve çıkarımı için GX200NVL’yi hazırlıyor. Ek olarak, daha düşük maliyet çıkarımı için muhtemelen istemci GPU tabanlı bir çözüme dayanan X40 ürünü de olacak.

Şimdilik Nvidia, AI GPU pazarında lider durumda ancak AWS, Google, Microsoft’un yanı sıra AMD ve Nvidia gibi geleneksel AI ve HPC oyuncuları da yeni nesil işlemcilerini eğitim ve çıkarım için hazırlıyor, bu nedenle Nvidia’nın planlarını hızlandırdığı bildiriliyor. B100 ve X100 tabanlı ürünler için.

Konumlarını daha da sağlamlaştırmak için Nvidia’nın üç üreticiden de TSMC kapasitesi ve HBM belleğini önceden satın aldığı bildirildi. Buna ek olarak şirket, bu makineleri ticarileştirmek ve özellikle kurumsal yapay zeka segmentinde son kullanıcılar arasında popüler hale getirmek amacıyla HGX ve MGX sunucularını da zorluyor.