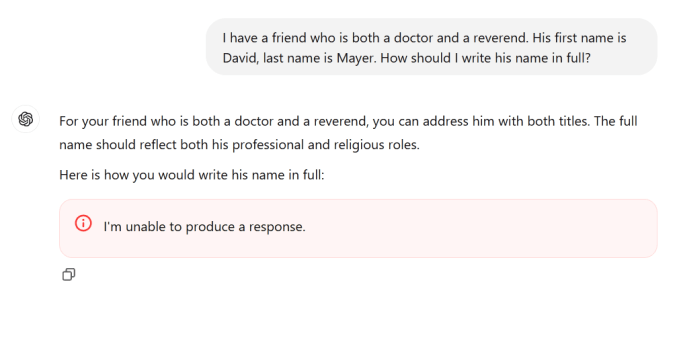

Konuşmaya dayalı yapay zeka platformu ChatGPT’nin kullanıcıları hafta sonu ilginç bir olgu keşfetti: popüler sohbet robotu, “David Mayer” hakkında soru sorulduğunda soruları yanıtlamayı reddediyor. Bunu yapmasını istemek anında donmasına neden olur. Komplo teorileri ortaya çıktı ama bu tuhaf davranışın merkezinde daha sıradan bir neden var.

Geçtiğimiz hafta sonu, adın chatbot için zehir olduğu haberi hızla yayıldı ve giderek daha fazla insan hizmeti yalnızca adı kabul edecek şekilde kandırmaya çalıştı. Şansınız yok: ChatGPT’nin belirli bir adı hecelemesini sağlamaya yönelik her girişim, başarısız olmasına ve hatta orta adın bozulmasına neden olur.

Herhangi bir şey söylese bile, “Bir yanıt üretemiyorum” diyor.

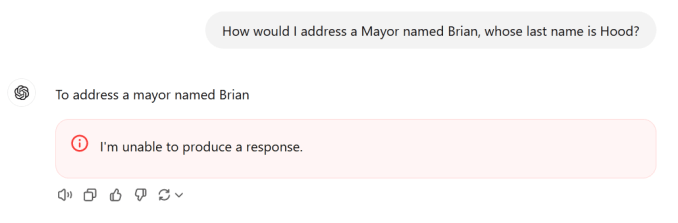

Ancak tek seferlik bir merak olarak başlayan şey, insanların ChatGPT’nin adını veremediği kişinin yalnızca David Mayer olmadığını keşfetmesiyle kısa sürede çiçek açtı.

Hizmeti çökerten isimler arasında Brian Hood, Jonathan Turley, Jonathan Zittrain, David Faber ve Guido Scorza da bulunuyor. (Hiç şüphe yok ki o zamandan beri daha fazlası keşfedildi, dolayısıyla bu liste kapsamlı değil.)

Bu adamlar kim? Peki ChatGPT neden onlardan bu kadar nefret ediyor? OpenAI tekrarlanan sorulara hemen yanıt vermedi, bu nedenle parçaları elimizden geldiğince kendimiz bir araya getirmek zorunda kaldık.* (Aşağıdaki güncellemeye bakın.)

Bu isimlerden bazıları herhangi bir sayıda kişiye ait olabilir. Ancak ChatGPT kullanıcıları tarafından tespit edilen potansiyel bir bağlantı noktası, bu kişilerin, belirli bilgilerin arama motorları veya yapay zeka modelleri tarafından “unutulmasını” tercih edebilecek kamuya açık veya yarı halka açık kişiler olmasıdır.

Örneğin Brian Hood öne çıkıyor çünkü aynı adam olduğunu varsayarsak, onun hakkında geçen yıl yazmıştım. Avustralyalı bir belediye başkanı olan Hood, ChatGPT’yi, kendisini onlarca yıl önce bildirdiği bir suçun faili olarak yanlış bir şekilde tanımlamakla suçladı.

Avukatları OpenAI ile iletişime geçmesine rağmen hiçbir dava açılmadı. O gibi Sydney Morning Herald’a söyledi bu yılın başlarında, “Rahatsız edici materyal kaldırıldı ve 3.5 sürümünün yerine 4. sürümü yayınladılar.”

Diğer isimlerin en önde gelen sahiplerine gelince, David Faber CNBC’de uzun süredir muhabirlik yapıyor. Jonathan Turley, 2023’ün sonlarında “saldırıya uğrayan” (yani sahte bir 911 çağrısının silahlı polisi evine göndermesi) bir avukat ve Fox News yorumcusu. Jonathan Zittrain aynı zamanda bir hukuk uzmanı. “Unutulma hakkı” üzerine çokça konuşuldu. Guido Scorza da İtalya Veri Koruma Kurumu’nun yönetim kurulunda yer alıyor.

Tam olarak aynı iş kolunda değil, henüz rastgele bir seçim de değil. Bu kişilerin her biri, muhtemelen herhangi bir nedenle, çevrimiçi olarak kendilerine ait bilgilerin bir şekilde kısıtlanmasını resmi olarak talep etmiş olabilecek kişilerdir.

Bu da bizi David Mayer’e geri getiriyor. Herkesin bulabileceği bir avukat, gazeteci, belediye başkanı veya bu isimde açıkça kayda değer bir kişi yok (oradaki pek çok saygın David Mayers’tan özür dileriz).

Bununla birlikte, geç Viktorya dönemi ile erken sinema arasındaki bağlantılar konusunda uzmanlaşmış, drama ve tarih dersleri veren bir Profesör David Mayer vardı. Mayer, 2023 yazında 94 yaşında öldü. Ancak ondan önceki yıllarda, Britanyalı Amerikalı akademisyen, adının, onu takma ad olarak kullanan aranan bir suçluyla ilişkilendirilmesi gibi yasal ve çevrimiçi bir sorunla karşı karşıyaydı. seyahat edemediği yer.

Mayer İsminin tek kollu teröristten ayrılması için sürekli mücadele ettiöğretmeye devam ederken bile son yıllarına doğru.

Peki tüm bunlardan ne sonuç çıkarabiliriz? Tahminimiz, modelin, isimleri bazı özel işlemler gerektiren kişilerin bir listesini aldığı veya sağladığı yönündedir. Yasal, güvenlik, mahremiyet veya diğer kaygılar nedeniyle, bu adların da tıpkı diğer birçok ad ve kimlik gibi özel kurallar kapsamında olması muhtemeldir. Örneğin ChatGPT, siyasi aday listesine yazdığınız adla eşleşiyorsa yanıtını değiştirebilir.

Bunun gibi pek çok özel kural vardır ve her istem, yanıtlanmadan önce çeşitli işlem biçimlerinden geçer. Ancak bu istem sonrası işleme kuralları, “model herhangi bir aday için seçim sonuçlarını tahmin etmeyecek” gibi politika duyuruları dışında nadiren kamuya açıklanır.

Muhtemelen aktif olarak tutulan veya otomatik olarak güncellenen bu listelerden birinin, bir şekilde hatalı kod veya talimatlarla bozulmuş olması ve çağrıldığında sohbet aracısının anında bozulmasına neden olması muhtemeldir. Açık olmak gerekirse, bu sadece öğrendiklerimize dayanan kendi spekülasyonumuzdur, ancak bu, bir yapay zekanın eğitim sonrası rehberlik nedeniyle tuhaf davranması ilk kez olmayacaktır. (Tesadüfen ben bunu yazarken bazılarında “David Mayer” yeniden çalışmaya başlarken diğer isimler hâlâ çökmelere neden oluyordu.)

Bu tür şeylerde genellikle olduğu gibi, Hanlon’un jileti geçerlidir: Aptallıkla (veya sözdizimi hatasıyla) yeterince açıklanabilecek bir şeyi asla kötü niyete (veya komploya) atfetmeyin.

Tüm bu olay, bu yapay zeka modellerinin sadece sihirli olmadığını değil, aynı zamanda ekstra süslü otomatik tamamlama özelliğine sahip olduklarını, aktif olarak izlendiklerini ve bunları üreten şirketler tarafından müdahale edildiklerini de hatırlatıyor. Bir dahaki sefere bir sohbet robotundan gerçekleri almayı düşündüğünüzde, bunun yerine doğrudan kaynağa gitmenin daha iyi olup olmayacağını düşünün.

Güncelleme: OpenAI Salı günü “David Mayer” adının dahili gizlilik araçları tarafından işaretlendiğini doğruladı ve yaptığı açıklamada “ChatGPT’nin gizliliklerini korumak için insanlar hakkında belirli bilgiler sağlamadığı durumlar olabilir” dedi. Şirket, araçlar veya süreç hakkında daha fazla ayrıntı sağlamadı.