Yapay zeka alanındaki araştırmalarıyla tanınan OpenAI kuruluşu, Duke Üniversitesi araştırmacılarına “Yapay Zekanın Ahlakının Araştırılması” adlı proje için hibe verdi. Hibe, “ahlaki yapay zeka”nın yaratılmasını araştırmayı amaçlayan, üç yıllık, 1 milyon dolarlık daha büyük bir fonun parçası.

Projenin baş araştırmacısı Duke Üniversitesi pratik etik profesörü Walter Sinnott-Armstrong, 2025 yılına kadar tamamlanması beklenen çalışma hakkında yorum yapmayı reddetti. Ancak Sinnott-Armstrong ve meslektaşı Jana Borg’un daha önce yapay zekanın insanların daha iyi kararlar almasına yardımcı olacak bir “ahlaki GPS” olma potansiyeli üzerine araştırmalar yaptığı biliniyor. Ayrıca böbrek bağışına karar vermek için “ahlaki açıdan tutarlı” bir algoritma oluşturdular ve insanların ahlaki kararlar almak için yapay zekayı tercih edeceği senaryolar üzerinde çalıştılar.

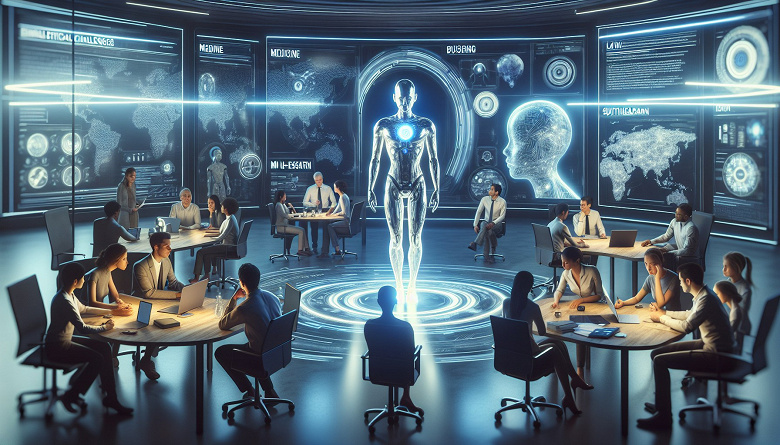

OpenAI tarafından finanse edilen çalışmanın amacı, “tıp, hukuk ve iş dünyasındaki ahlaki açıdan önemli özellikler arasında” çatışmaları içeren senaryolarda “insanın ahlaki yargılarını tahmin edecek” algoritmalar yetiştirmektir. Ancak “ahlaki yapay zeka” yaratma görevi son derece zordur çünkü mevcut yapay zeka sistemleri, verilerdeki kalıpları öğrenen ve etik kavramları değerlendiremeyen veya ahlaki kararların ardındaki mantık ve duyguları anlayamayan istatistiksel modellere dayanmaktadır.

Buna ek olarak, yapay zeka eğitimine ilişkin veriler öncelikle bu görüşleri destekleyen makalelerin ağırlıklı olduğu web’den geldiğinden, yapay zeka sıklıkla Batılı, eğitimli ve sanayileşmiş ülkelerin değerlerini yansıtır. Bu, birçok insanın değerlerinin yapay zeka tarafından verilen cevaplarda ifade edilmemesiyle sonuçlanır ve yapay zekanın kendisi de bir takım önyargıları içselleştirir. Örneğin, kar amacı gütmeyen Allen Yapay Zeka Enstitüsü tarafından oluşturulan bir araç olan Delphi, heteroseksüel olmanın eşcinsel olmaktan “ahlaki açıdan daha kabul edilebilir” olduğunu ilan etti.

Ahlakın öznelliği aynı zamanda “ahlaki yapay zeka” yaratma görevini de karmaşık hale getirir. Filozoflar binlerce yıldır çeşitli etik teorilerin yararlarını tartışıyorlar ve henüz evrensel olarak uygulanabilir bir çerçeve ortaya çıkmadı. Örneğin Claude Kantçılığı desteklerken ChatGPT faydacılığa eğilimlidir. İnsanlar hakkında ahlaki yargılarda bulunacak bir algoritmanın tüm bu faktörleri hesaba katması gerekir ki bu, böyle bir algoritmanın mümkün olduğu varsayıldığında çok yüksek bir çıtadır.