Bilmeniz gerekenler

- LinkedIn, Üretken AI İyileştirmesi için Veri adlı yeni bir özelliği sessizce yayınladı. Bu özellik, Microsoft ve bağlı kuruluşlarının AI modellerini eğitmek için istihdam odaklı sosyal ağdaki verilerinizi kullanır.

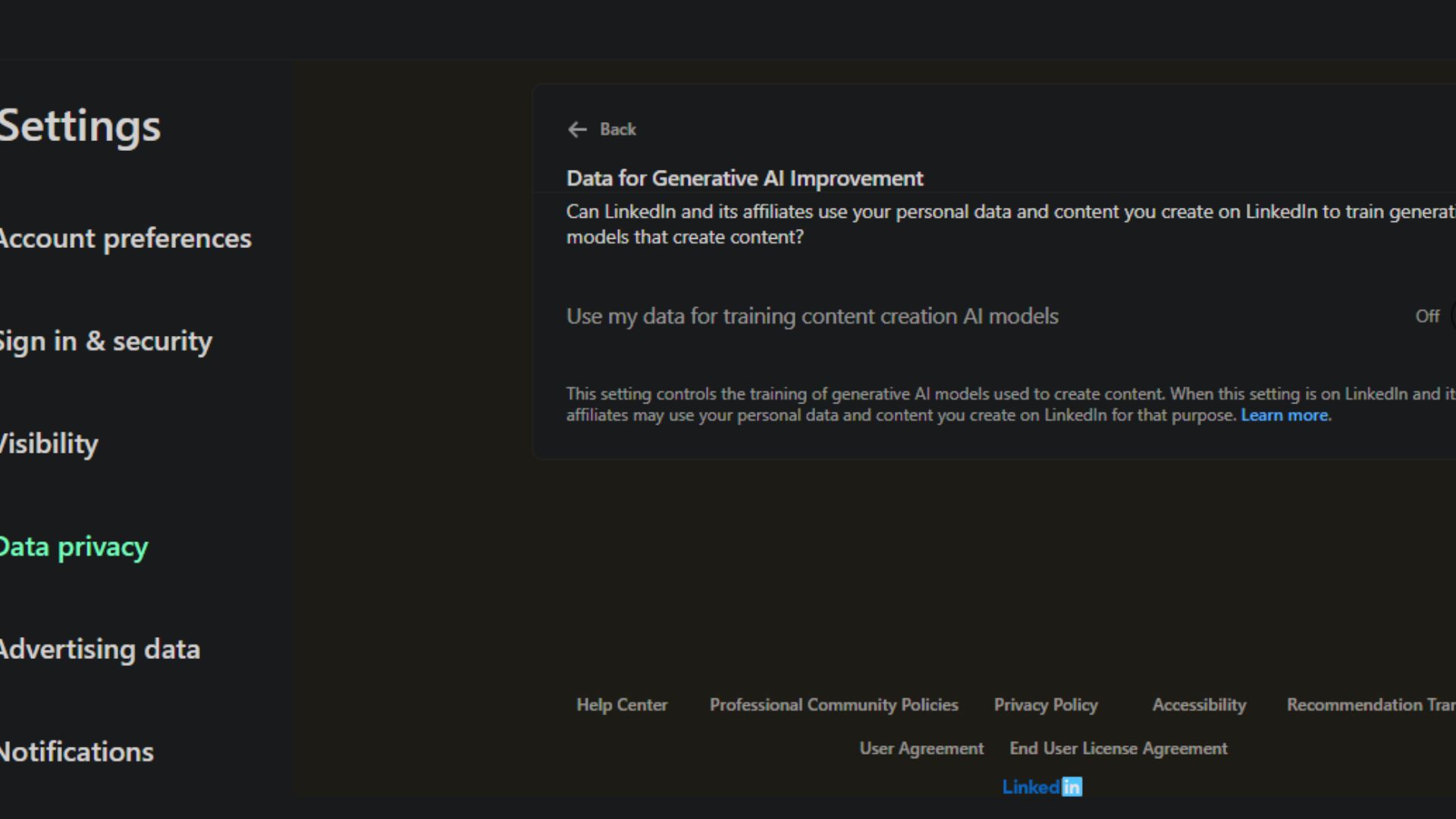

- Bu özellik varsayılan olarak etkindir, ancak web ve mobildeki Veri Gizliliği ayarlarından bunu kapatabilirsiniz.

- AB, AEA ve İsviçre kullanıcıları, muhtemelen AB Yapay Zeka Yasası’nın katı kuralları nedeniyle tartışmalı özellikten muaf tutuldu.

Microsoft ve OpenAI, telif hakkı ihlaliyle ilgili sorunlar nedeniyle çok sayıda mahkeme savaşına girmiştir. AI destekli modeller, eğitim için web’den gelen bilgilere güvenir ve bu, yaklaşıma ilişkin çekincelerini açıkça dile getiren yazarlar ve yayınlar tarafından pek hoş karşılanmaz.

OpenAI’ye karşı açılan birçok telif hakkı ihlali davasından birine yorum yaparken, CEO Sam Altman, telif hakkıyla korunan içerik olmadan ChatGPT gibi araçlar geliştirmenin imkansız olduğunu kabul etti. Altman ayrıca telif hakkı yasasının AI modellerini eğitmek için telif hakkıyla korunan içerik kullanmayı yasaklamadığını ileri sürdü.

Anthropic, bir grup yazarın, Claude AI’yı izinsiz veya tazminatsız eğitmek için çalışmalarını kullandıklarını öne sürerek dava açmasının ardından telif hakkı ihlali nedeniyle dava edilen son AI firması oldu. Microsoft’un istihdam odaklı sosyal ağı LinkedIn’in, AI modellerini eğitmek için kullanıcıların verilerini kullandığı bildirildi.

Linkedin yeni bir özelliği gizlice kullanıma sundu (Üretici AI iyileştirmesi için veriler), AI modellerinin eğitim için verilerinize erişmesine izin verir. Daha kötüsü, varsayılan olarak etkindir. Bu yeni ifşanın ardından, Microsoft ve “bağlı kuruluşları” verilere erişebilir LinkedIn’in günlük 134,5 milyon aktif kullanıcısı var Yapay zeka eğitimi için.

Konuşurken PCMagLinkedIn sözcüsü, “bağlı kuruluşların” Microsoft’a ait herhangi bir şirketi ifade ettiğini belirtti. Sözcü ayrıca LinkedIn’in toplanan verileri OpenAI ile paylaşmadığını da açıkladı.

İlginçtir ki, AB, AEA ve İsviçre kullanıcıları eylemde görünmüyor. Bunun arkasındaki teori, bölgeye getirilen katı kurallara atfedilebilir. AB Yapay Zeka YasasıYüksek riskli yapay zeka sistemlerinin eğitilmesini, doğrulanmasını ve test edilmesini yasaklayan yasa.

LinkedIn hüküm ve koşullarını şu şekilde vurguluyor:

“LinkedIn’in üretken yapay zeka modelleri eğittiği yerlerde, eğitim veri setlerinden kişisel verileri sansürlemek veya kaldırmak için gizliliği artıran teknolojiler kullanmak da dahil olmak üzere, modelleri eğitmek için kullanılan veri setlerindeki kişisel verileri en aza indirmeye çalışıyoruz.”

Yeni özelliğin LinkedIn’de paylaşılan gönderilerle mi yoksa DM’ler de dahil olmak üzere genel gönderilerle mi sınırlı olduğu belirsiz. LinkedIn, “LinkedIn’deki çoğu özellikte olduğu gibi, platformumuzla etkileşim kurduğunuzda, kişisel veriler de dahil olmak üzere platformu kullanımınızla ilgili verileri topluyor ve kullanıyoruz (veya işliyoruz)” diye ekledi. “Bu, üretken AI’yı (içerik oluşturmak için kullanılan AI modelleri) veya diğer AI özelliklerini kullanımınız, gönderileriniz ve makaleleriniz, LinkedIn’i ne sıklıkta kullandığınız, dil tercihiniz ve ekiplerimize sağlamış olabileceğiniz geri bildirimler olabilir.”

LinkedIn’in Veri Üretken Yapay Zeka İyileştirme özelliği nasıl devre dışı bırakılır

LinkedIn’in Yapay Zeka Geliştirme için Veri özelliğini devre dışı bırakmak ve verilerinizin yapay zeka eğitimi için kullanılmasını engellemek için şuraya gidin: Ayarlar > Veri Gizliliği > Üretken AI İyileştirmesi için Veriler ve düğmeyi kapatın.

Elon Musk’ın Grok’u, Temmuz ayında kullanıcı onayı olmadan AI modelini gizlice eğittiği için benzer eleştirilerle karşı karşıya kalmıştı. LinkedIn’in yeni tartışmalı özelliği gibi, Grok’un AI eğitim özelliği de varsayılan olarak etkindi. Daha kötüsü, özelliği kapatma yeteneği web ile sınırlıydı ve bu da mobil kullanıcıların onu devre dışı bırakmasını zorlaştırıyordu.

X’in Grok’u “bu yılın Aralık ayına kadar her ölçüte göre en güçlü AI” yapma arayışı, sosyal ağı düzenleyici incelemeye açtı. Genel Veri Koruma Yönetmeliği (GDPR), platform kullanıcıların verilerini rızaları olmadan sohbet robotunu eğitmek için kullanmak için yasal bir temel oluşturamazsa, X’e küresel yıllık cirosunun %4’üne kadar para cezası verebilir.