AMD’nin Instinct MI300X yapay zeka hızlandırıcıları, MLPerf v4.1’de ilk görünüm ve yeni nesil EPYC “Turin” CPU’larla test edilmiştir.

AMD Instinct MI300X ve EPYC Turin “Zen 5” MLPerf V4.1’de İlk kez Tanıtıldı, Gerçek Dünyadaki Llama 2 Performansına İlk Bakış

Bugün AMD, en yeni veri merkezi ve yapay zeka merkezli donanımının ilk performans ölçütlerini MLPerf Inference v4.1’de paylaşıyor. Bu iş yükleri, AMD, Intel ve NVIDIA gibi çeşitli teknoloji devlerinin en yeni ve gelecek donanımlarının potansiyelini sergilemek üzere tasarlandı.

Kırmızı takım, çipin piyasaya sürülmesinden bu yana Instinct MI300X hızlandırıcının ilk sunumlarını MLPerf’te paylaşıyor ve aynı zamanda bize Zen 5 çekirdek mimarisini temel alan 5. Nesil sunucu serisi olan yakında çıkacak EPYC Turin CPU’larının da tadına bakıyor.

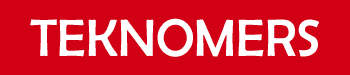

Performans değerlendirmesi için AMD, Supermicro AS-8125GS-TNMR2 sistemi üzerinde çalışan Instinct MI300X AI hızlandırıcılarının sonuçlarını sundu. MLPerf v4.1’de ikisi Çevrimdışı senaryosu ve ikisi Sunucu senaryosu altında olmak üzere dört sonuç gönderildi. Aradaki fark, bu testlerden ikisinin 4. Nesil EPYC “Genoa” CPU’lar kullanılarak gerçekleştirilmiş olması ve diğer iki sonucun da yakında çıkacak 5. Nesil EPYC “Turin” CPU’lar kullanılarak gerçekleştirilmiş olmasıdır.

- CPU-GPU Performans Kombinasyonu:

- Gönderim Kimliği 4.1-0002: Mevcut kategorisinde 2x AMD EPYC 9374F (Genoa) CPU ile 8x AMD Instinct MI300X hızlandırıcı

- Bu yapılandırma, AMD Instinct MI300X GPU hızlandırıcıları ile 4 işlemci arasındaki güçlü sinerjiyi gözler önüne serdi.o AI iş yükleri için Gen EPYC CPU’lar (eskiden kod adı “Genoa”) olup, 4 ile NVIDIA DGX H100’ün %2-3’ü oranında performans sunar.o Hem sunucu hem de çevrimdışı senaryolarda FP8 hassasiyetinde Gen Intel Xeon CPU’lar

- Yeni Nesil CPU ile Performansın Önizlenmesi:

- Gönderim Kimliği 4.1-0070: Önizleme kategorisinde 2x AMD EPYC “Turin” CPU ile 8x AMD Instinct MI300X.

- AMD Instinct MI300X GPU hızlandırıcılara sahip yeni 5. Nesil AMD EPYC “Turin” CPU’nun performans kazanımlarını gösterdi; sunucu senaryosunda Intel Xeon’lu NVIDIA DGX H100’e göre hafif bir üstünlüğe sahip oldu ve FP8 hassasiyetinde çevrimdışı senaryoda karşılaştırılabilir performansı korudu

- Tek GPU Verimliliği

- Gönderim Kimliği 4.1-0001: 2x 4’lü 1x AMD Instinct MI300X hızlandırıcıo Kullanılabilir kategorisinde Gen AMD EPYC 9374F CPU’lar (Genoa).

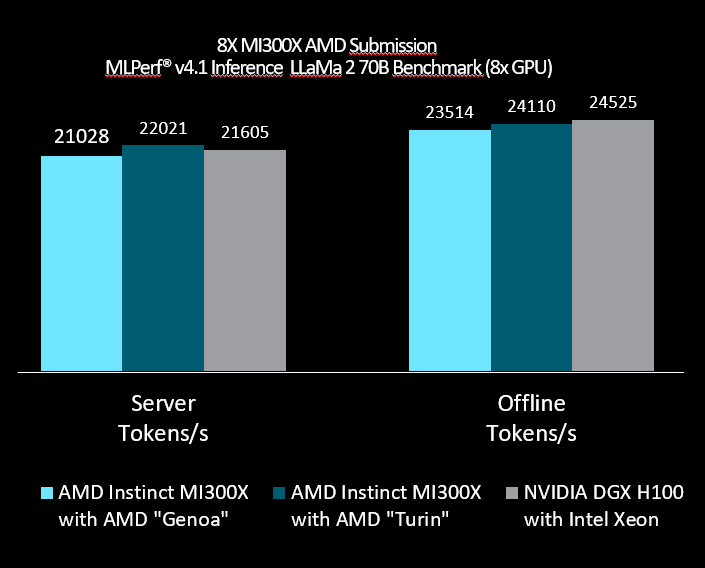

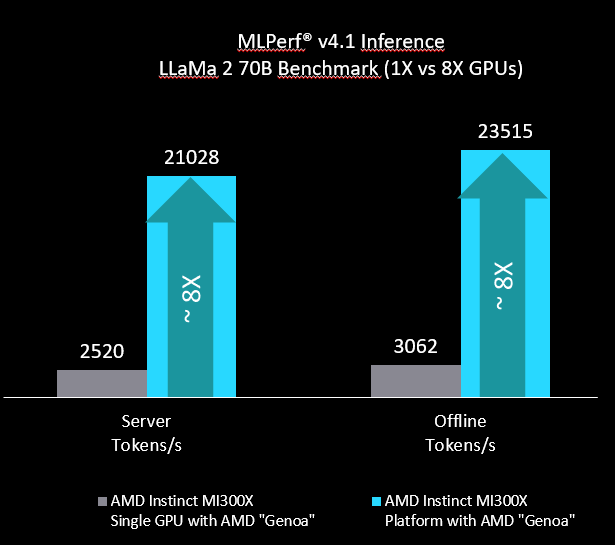

- Bu giriş, AMD Instinct MI300X’in geniş 192 GB belleğini vurgulayarak, tek bir GPU’nun tüm LLaMA2-70B modelini verimli bir şekilde çalıştırmasını sağlayarak modelin FP8 hassasiyetinde birden fazla GPU’ya bölünmesiyle ilişkili ağ yükünü ortadan kaldırıyor. (bkz. aşağıdaki Şekil 2).

- AMD Instinct MI300X Hızlandırıcılarla Etkileyici Dell Sunucu Tasarımı Sonuçları

Gönderim Kimliği 4.1-0022: Mevcut kategorisinde 2x Intel(R) Xeon(R) Platinum 8460Y+ ile 8x AMD Instinct MI300X hızlandırıcı

Dell, AMD gönderimlerine ek olarak, PowerEdge XE9680 sunucusunu kullanarak 8x AMD Instinct MI300X kurulumunda LLaMA2-70B sonuçlarını göndererek AMD Instinct hızlandırıcılarının platform düzeyindeki performansını doğruladı.

LLama2-70B’deki performans sonuçlarına bakıldığında AMD, sunucuda 21.028 token/s ve EPYC Genoa CPU’larda çalışan çevrimdışı senaryoda 23.514 token/s elde ederken, aynı Instinct konfigürasyonuna sahip 5. Nesil EPYC “Turin” CPU’lar 22.021 token sunuyor Sunucuda /s ve çevrimdışı senaryoda 24.110 jeton/s. Bu, Cenova CPU platformuna göre %4,7 ve %2,5’lik bir iyileşmeye işaret ediyor.

NVIDIA H100 ile karşılaştırıldığında Instinct MI300X sunucu performansında biraz daha yavaştır, ancak çevrimdışı senaryoda fark daha da artar. Torino yapılandırması sunucu senaryosunda %2 oranında daha hızlı sonuçlanıyor ancak çevrimdışı senaryoda gecikme yaşanıyor. Bu sonuçlar NVIDIA’nın kendi duyurusunda yayınladığı sonuçlarla eşleşiyor gibi görünüyor. AMD ayrıca 1 GPU ve 8 GPU karşılaştırmasını kullanarak Llama2-70B’de mükemmele yakın ölçeklendirmeyi gösterdi.

Son olarak AMD, Instinct MI300X AI hızlandırıcılarının sunduğu, NVIDIA H100 platformunda sunulanın çok ötesindeki bellek avantajını vurguluyor. MI300X, çeşitli veri formatlarında en büyük dil modellerinin gereksinimlerini karşılamak için yeterli bellek sunar.

AMD, ROCm yığınını AI’ya yönelik daha fazla optimizasyonla sağlamlaştırmayı hedeflediği için burada bitmedi, böylece MLPerf gönderimlerinin bir sonraki yinelemesinde performans güncellemelerini görebiliriz. AMD, MI300X numaralarını göndermek için oldukça zaman harcamış olsa da, gelecek çeyrekte piyasaya sürülecek olan MI325X’in, MI300X’e göre %50 kapasite artışı sağlayan önemli bir ürün olması nedeniyle sonuçların çok daha erken sunulacağını umabiliriz. AMD’nin EPYC Torino “Zen 5” CPU’sunun da bu yılın sonlarında piyasaya sürülmesi bekleniyor, bu yüzden bizi izlemeye devam edin.