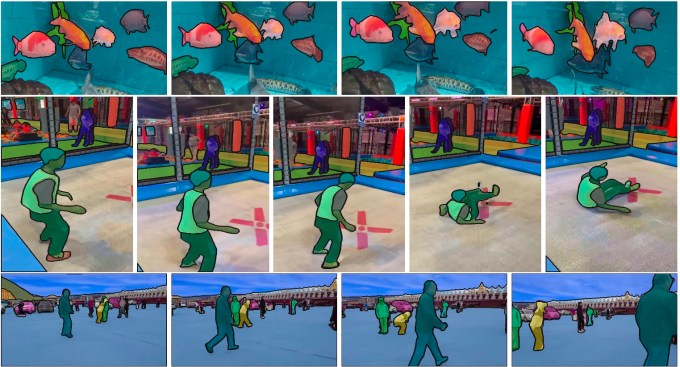

Meta, geçen yıl bir görüntüdeki hemen hemen her şeyi hızlı ve güvenilir bir şekilde tanımlayıp ana hatlarını çıkarabilen bir makine öğrenme modeli olan Segment Anything ile elle tutulur bir başarı yakaladı. CEO Mark Zuckerberg’in pazartesi günü SIGGRAPH’ta sahnede ilk kez tanıttığı devam filmi, modeli video alanına taşıyarak alanın ne kadar hızlı hareket ettiğini gösteriyor.

Segmentasyon, bir görme modelinin bir resme bakıp parçaları seçmesi için kullanılan teknik bir terimdir: “bu bir köpek, bu köpeğin arkasındaki bir ağaç” umarım, “bu bir köpeğin içinden çıkan bir ağaç” değil. Bu onlarca yıldır oluyor, ancak son zamanlarda çok daha iyi ve hızlı hale geldi ve Segment Anything önemli bir adım oldu.

Herhangi Bir Şeyi Segmentleyin 2 (SA2) doğal bir takiptir çünkü yalnızca durağan görüntülere değil, videolara da doğal olarak uygulanabilir; elbette ilk modeli videonun her karesinde ayrı ayrı çalıştırabilirsiniz, ancak bu en verimli iş akışı değildir.

Zuckerberg, Nvidia CEO’su Jensen Huang ile yaptığı bir sohbette, “Bilim insanları bu şeyleri mercan resiflerini ve doğal yaşam alanlarını incelemek için kullanıyor. Ancak bunu videoda yapabilmek ve sıfır çekim yapabilmek ve ne istediğinizi söyleyebilmek oldukça harika,” dedi.

Video işlemek elbette çok daha fazla hesaplama gerektirir ve SA2’nin veri merkezini eritmeden çalışabilmesi, sektörde verimlilikte kaydedilen ilerlemelerin bir kanıtıdır. Elbette, çalışması için ciddi donanıma ihtiyaç duyan hala büyük bir modeldir, ancak hızlı, esnek segmentasyon bir yıl önce bile pratik olarak imkansızdı.

Bu model de ilk model gibi açık ve ücretsiz kullanıma açık olacak; ancak bu yapay zeka şirketlerinin zaman zaman sunduğu barındırılabilir bir sürüm hakkında henüz bir bilgi yok. Ama ücretsiz bir demosu da var.

Doğal olarak böyle bir model eğitilmek için bir ton veriye ihtiyaç duyar ve Meta ayrıca sadece bu amaç için oluşturduğu 50.000 videodan oluşan büyük, açıklamalı bir veritabanını da yayınlıyor. SA2’yi tanımlayan makalede, eğitim için 100.000’den fazla “dahili olarak erişilebilir” videodan oluşan başka bir veritabanı da kullanıldı ve bu kamuya açıklanmıyor — Meta’dan bunun ne olduğu ve neden yayınlanmadığı hakkında daha fazla bilgi istedim. (Tahminimiz, bunun kamuya açık Instagram ve Facebook profillerinden kaynaklandığı yönünde.)

Meta, birkaç yıldır “açık” AI alanında lider konumda, ancak aslında (Zuckerberg’in sohbette belirttiği gibi) PyTorch gibi araçlarla uzun zamandır bunu yapıyor. Ancak daha yakın zamanda, LLaMa, Segment Anything ve serbestçe çıkardığı birkaç başka model, bu alanlarda AI performansı için nispeten erişilebilir bir bar haline geldi, ancak “açıklıkları” tartışma konusu.

Zuckerberg, Meta’daki bu açıklığın tamamen iyi niyetlerinden kaynaklanmadığını, ancak bunun niyetlerinin kötü olduğu anlamına gelmediğini belirtti:

“Bu, sadece inşa edebileceğiniz bir yazılım parçası gibi değil – bunun etrafında bir ekosisteme ihtiyacınız var. Açık kaynaklı olmasaydık neredeyse hiç işe yaramazdı, değil mi? Bunu, ben bunun ekosistem için yararlı olacağını düşünmeme rağmen, fedakar insanlar olduğumuz için yapmıyoruz – bunu, inşa ettiğimiz şeyi en iyi hale getireceğini düşündüğümüz için yapıyoruz.”

Neyse, mutlaka iyi kullanılacaktır. GitHub’a buradan göz atın.