GPT-4 bulut sunucularından oluşan ekipler, kusurun niteliğine ilişkin herhangi bir açıklama yapılmaksızın, sıfırıncı gün güvenlik açıklarını özerk bir şekilde belirlemek ve bunlardan yararlanmak için birlikte çalışabilir. Uzman LLM’lerden oluşan bir kadroya komuta eden bir planlama temsilcisinin yer aldığı bu yeni gelişme, insan uzmanlardan veya özel yazılımlardan daha hızlı ve daha akıllı çalışıyor.

Illinois Urbana-Champaign Üniversitesi’ndeki (UIUC) araştırmacılar, yapay zekanın güvenlik açıklarını hackleme yeteneğini aylardır inceliyorlar ve ilk olarak ChatGPT’nin güvenlik açığının doğasına ilişkin açıklamalar sağlandığında güvenlik kusurlarını ihlal etme konusundaki benzersiz yeteneği hakkında yayınladılar. O zamandan bu yana atılan yeni çığır, üniversitenin HPTSA (Hiyerarşik Planlama ve Göreve Özel Aracılar) sistemi üzerinde yapılan yeniliklerdir; bu sistem, GPT-4 modelinin ekipler halinde çalışmasına ve iki kat daha etkili olmasına olanak tanımıştır.

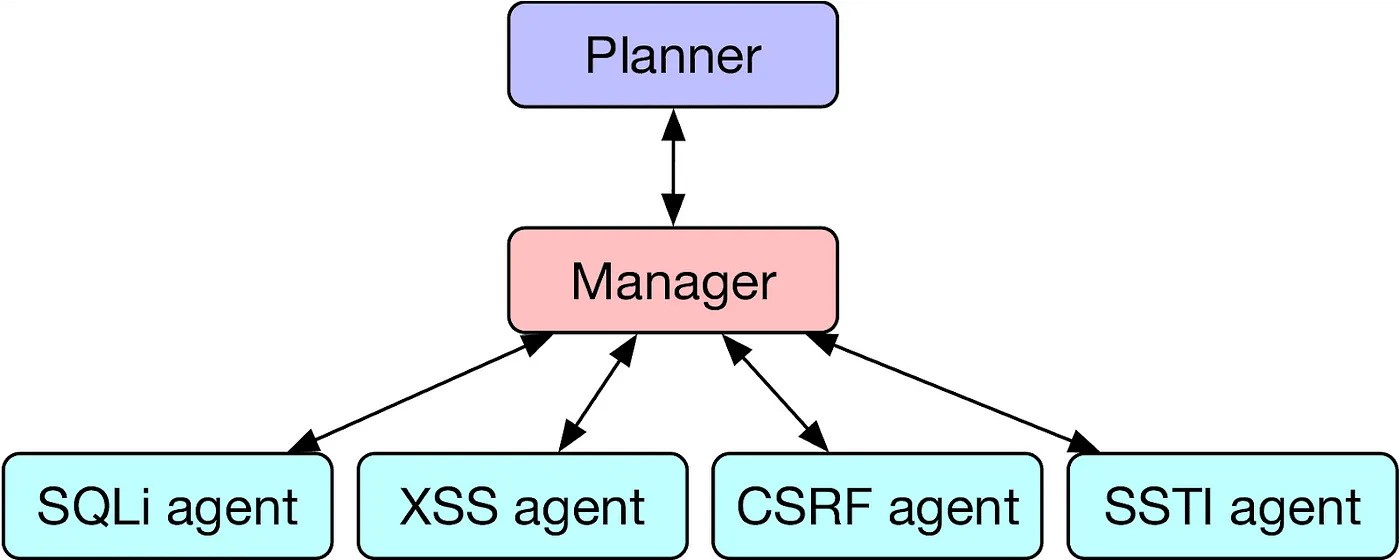

Ana hatlarıyla belirtildiği gibi Haziran çalışması ve araştırmacı Daniel Kang’ın kendisi Blog yazısıHPTSA, sorunları daha yüksek başarı oranlarıyla çözmek için bir dizi Yüksek Lisans eğitimi kullanır. Kang, bu sisteme olan ihtiyacı şöyle açıklıyor: “Tek yapay zeka aracıları inanılmaz derecede güçlü olmasına rağmen, mevcut Yüksek Lisans yetenekleriyle sınırlıdırlar. Örneğin, bir yapay zeka aracısı bir yola girerse (örneğin, bir XSS’den yararlanmaya kalkışırsa), bu durum zordur. Aracının geri adım atması ve başka bir güvenlik açığından yararlanmaya çalışması.” Kang şöyle devam ediyor: “Ayrıca, Yüksek Lisanslar tek bir göreve odaklandıklarında en iyi performansı gösteriyor.”

Planlayıcı aracı, hangi istismarların deneneceğini belirlemek için web sitesini veya uygulamayı araştırır ve bunları göreve özel aracı LLM’lere yetki veren bir yöneticiye atar. Bu sistem, karmaşık olsa da, ekibin önceki araştırmalarına ve hatta açık kaynaklı güvenlik açığı tarama yazılımına göre büyük bir gelişmedir. 15 güvenlik açığının test edildiği bir denemede, HPTSA yöntemi 15 güvenlik açığından 8’ini başarıyla kullandı, 15 güvenlik açığından yalnızca 3’ünü alabilen tek bir GPT-4 aracısını yendi ve tek bir güvenlik açığından yararlanamayan ZAP ve MetaSploit yazılımını yok etti. .

HPTSA, yalnızca isteminde güvenlik açığının açıklaması verilen ve 15 başarıdan 11’ini elde eden bir GPT-4 ajanı tarafından mağlup edildi. Bu ajan, UIUC’un Nisan ayındaki orijinal çalışmasının zirvesini oluşturuyordu ve bu çalışmanın insan bilgisayar korsanlarından hız ve etkililik açısından üstün olduğu ortaya çıktı.

OpenAI özellikle makalenin yazarlarından bu veya ilk deneyler için kullandıkları yönlendirmeleri kamuya açıklamamalarını talep etti; yazarlar da bunu kabul etti ve istemleri yalnızca “talep üzerine” sunacaklarını söylediler. GPT-4, araştırma ekibinin yüksek lisans tercihi olmaya devam ediyor; Rakip Yüksek Lisans Kurumları kullanılarak yapılan önceki testler, bunların ciddi düzeyde eksik olduğunu ve güncellenen GPT-4o’nun kalite açısından GPT-4’ten önemli ölçüde daha iyi olmadığını ortaya çıkardı.

UIUC ekibinin araştırması, büyük dil modellerinin yüzeyde görünenin ötesinde yeteneklere sahip olduğu yönündeki rahatsız edici gerçeği ortaya koymaya devam ediyor. OpenAI, yazılımının güvenliğini yüzey seviyesindeki sohbet robotundan bulabildiklerine göre değerlendirir, ancak dikkatli bir yönlendirmeyle ChatGPT, siber güvenliği kırmak ve hatta size meth pişirmeyi öğretmek için kullanılabilir.