Yapay zeka şu anda baktığınız her yerde.

İster yeni bir teknolojik atılım olsun, ister yeni bir şirketin harekete geçmesi ya da müşterilerine küfreden bir AI müşteri hizmetleri botu olsun, her gün yapay zeka hakkında yeni bir haber varmış gibi geliyor. Yapay zeka yeni moda ve büyük olasılıkla burada kalacak.

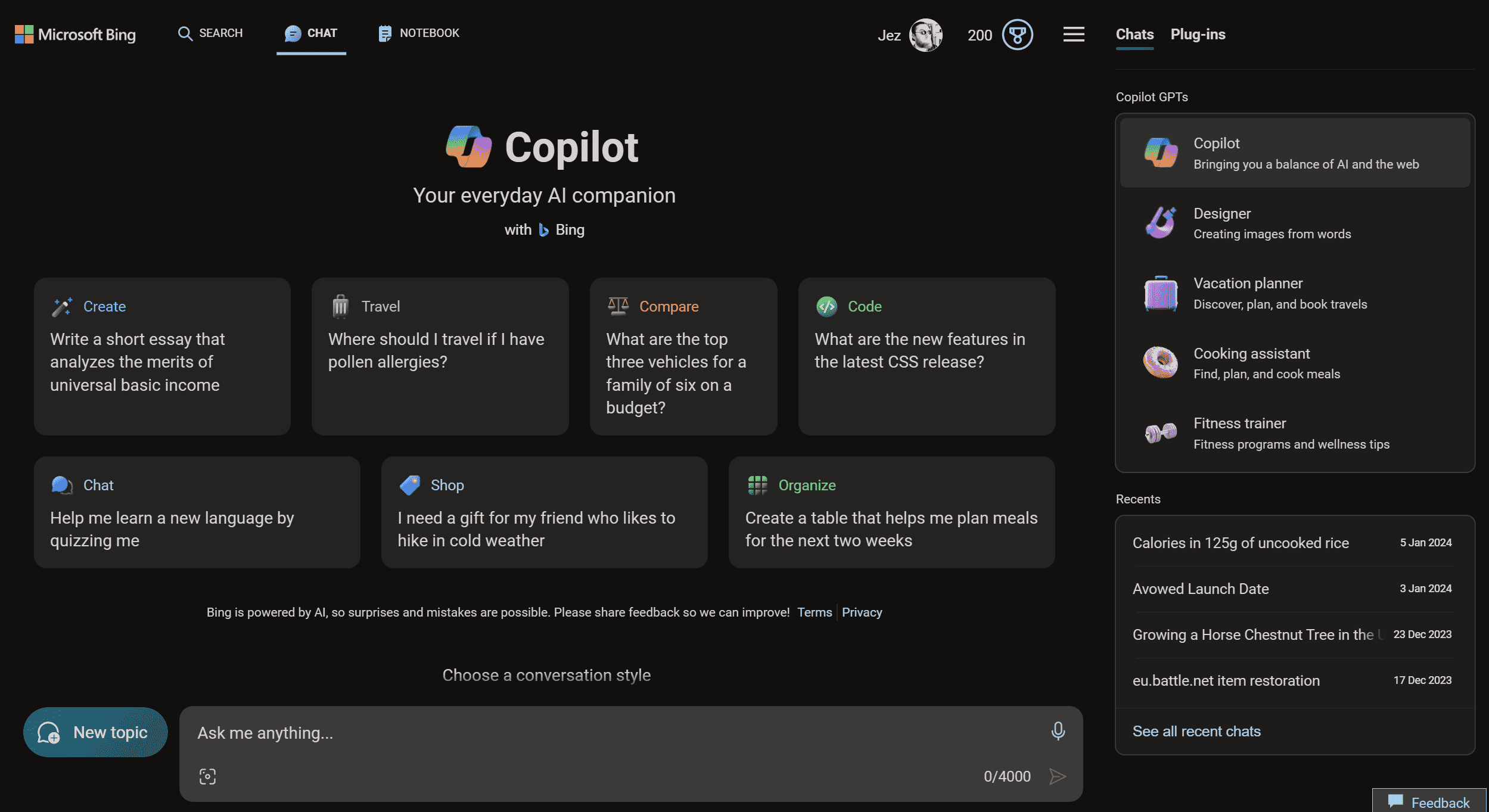

Windows’ta Microsoft Copilot veya başka bir şey olsun, teknolojinin tümü temelde benzer şekilde çalışır. Büyük dil modelleri (LLM’ler) veriler üzerinde eğitilir çalıntı kazınmış internetten ödünç alınmıştır. Windows Central’da gerçekten sizin tarafınızdan yazılmış harika makaleler olsun (öhöm) veya New York Times (şu anda konuyla ilgili olarak Microsoft’a dava açan) tarafından yayınlanan yeni hikayeler, ah), veya Disney’in ve hatta bağımsız yaratıcıların telif hakkıyla korunan sanat eserleri; insan yaratıcılar olmadan yapay zeka bir hiçtir. Ve OpenAI, Microsoft, Google ve diğer yapay zeka geliştiricilerinin bu gerçeği gerçekten anlayıp anlamadığını merak etmelisiniz.

Gerçekten de Microsoft ve rakipleri, içerik oluşturma, küratörlük ve LLM eğitimi arasında simbiyotik bir ilişki için işlevsel bir temel oluşturmak yerine, önce Microsoft Copilot Pro gibi şeylerle kâr elde etmeyi tercih ederek, istemeden de olsa kendi modellerini kapıdan itibaren felakete sürüklemiş olabilirler. en azından kısmen.

Yapay Zeka Yüksek Lisansı’nın şu anda karşı karşıya olduğu en büyük tehditlerden birkaçına göz atalım ve Microsoft ve arkadaşlarının bu konuda ne yapması gerektiğine bakalım.

1. Microsoft Copilot, Google Bard ve OpenAI ChatGPT interneti ve kendilerini öldürüyor

LLM modelinin çöküşü kavramını hiç duydunuz mu? Bu muhtemelen şu anda OpenAI, Microsoft ve Google gibi şirketlerin karşı karşıya olduğu en büyük tehdit ve hiçbiri bu tehdidi özellikle ciddiye alıyor gibi görünmüyor.

Model çöküşü, ChatGPT gibi büyük dil modellerinin yapay zeka tarafından oluşturulan önemsiz veriler üzerinde eğitildiklerinde yaşayabilecekleri dejeneratif süreci tanımlar. Yıllar boyunca binlerce sıkıştırma ve paylaşım tekrarından geçen bir JPEG’e benzer şekilde, ChatGPT ve Copilot gibi araçlar interneti kötü yazılmış, halüsinasyonlarla dolu önemsiz verilerle doldurmayı kolaylaştırırsa, kümülatif ve artan bir dejeneratif veriyi yinelemeli olarak yeniden üretecektir. Yüksek Lisans çıktısının kalitesi üzerindeki etkisi.

ChatGPT ve Copilot’un son aylarda nasıl “tembel” hale geldiğini ve daha düşük kaliteli sonuçlar ürettiğini anlatan memler zaten ortalıkta dolaşıyor. Ve şimdi yeni araştırmalar (üzerinden) Yardımcısı), internetteki yazılı içeriğin büyük bir kısmının zaten yapay zeka tarafından oluşturulduğunu, hatalar, yanlışlıklar ve ara sıra zararlı yalanlarla doldurulduğunu öne sürüyor. Henüz yayınlanmamış bir makalede araştırma, internetin yüzde 57’ye kadar herhangi bir yerde zaten yapay zeka tarafından üretilmiş olabileceğini ve kaynak yetersizliği olan bölgelere ve dillere karşı güçlü bir önyargıya sahip olabileceğini öne sürüyor. Örneğin, web üzerinde her türlü konu hakkında daha fazla İngilizce konuşulan içerik mevcut; bu, yapay zekanın sonuçları daha doğru bir şekilde eğitmesine ve yerelleştirmesine yardımcı oluyor. Ancak bunun her zaman böyle olacağını düşünmek için hiçbir neden yok. Halihazırda İngilizce odaklı içeriğin büyük bir kısmı da yapay zeka tarafından üretiliyor. Yapay zeka tarafından oluşturulan önemsiz içeriği bulmak için YouTube Shorts veya TikTok’ta yalnızca 2 dakika gezinmeniz yeterlidir.

Gerçekten de şu anda Google, Microsoft ve OpenAI’nin insan içerik yaratıcılarıyla savunulamaz bir ilişkisi var ve yapay zeka modellerini eğitmek için buna güveniyorlar. Microsoft ve özellikle Google, %90 arama pazarı kontrolüyle insan yaratıcılara zarar vermeye devam ederse, ironik bir şekilde, uzun vadede yalnızca kendilerine zarar vermiş olacaklar.

Bu amaçla başka bir çalışma (üzerinden Gizmodo) Google’ın yapay zeka tarafından üretilen çöplere karşı savaşı nasıl kaybettiğini ayrıntılarıyla anlatıyor. Büyük dilli bir model, bir kulaklıkla uygulamalı olarak çalışamaz ve en iyi Xbox kulaklıkları makalem gibi yüksek kaliteli kılavuzlar üretemez (utanmaz fiş), böylece hızlı para kazanmak isteyen insanlar yapay olarak benzer makaleler üretebilir ve bunlar daha sonra yüksek lisans yapanların benim eşyalarımı çalmasına güvenirler. Araştırma, Google’ın, insanlar tarafından araştırılan orijinal deneyimler ile yapay zeka tarafından oluşturulan sahte deneyimler arasında ayrım yapmakta zorlandığını, bunun da potansiyel olarak bu modelleri eğitmek için güvendiği içeriğin finansal uygulanabilirliğinde bir düşüşe yol açtığını öne sürüyor.

Yaratıcıların sayısının azalması, verilerin kalitesinde bir düşüş, arama yapılabilirliğinde bir düşüş ve yapay zeka kalitesinde bir düşüş anlamına gelir. Microsoft, Google ve diğerleri ise. Model çöküşünü ciddiye almak istiyorlarsa, muhtemelen (‘yi) nasıl koruyacaklarını keşfetmeleri gerekir.akraba) şu anda yaratıcılar ve arama algoritmaları arasında mevcut olan ortak yaşam. Google ve Microsoft bunu yapmayı reddederse mahkemeler onları yine de buna zorlayabilir.

2. Yaklaşan yasal kıyamet

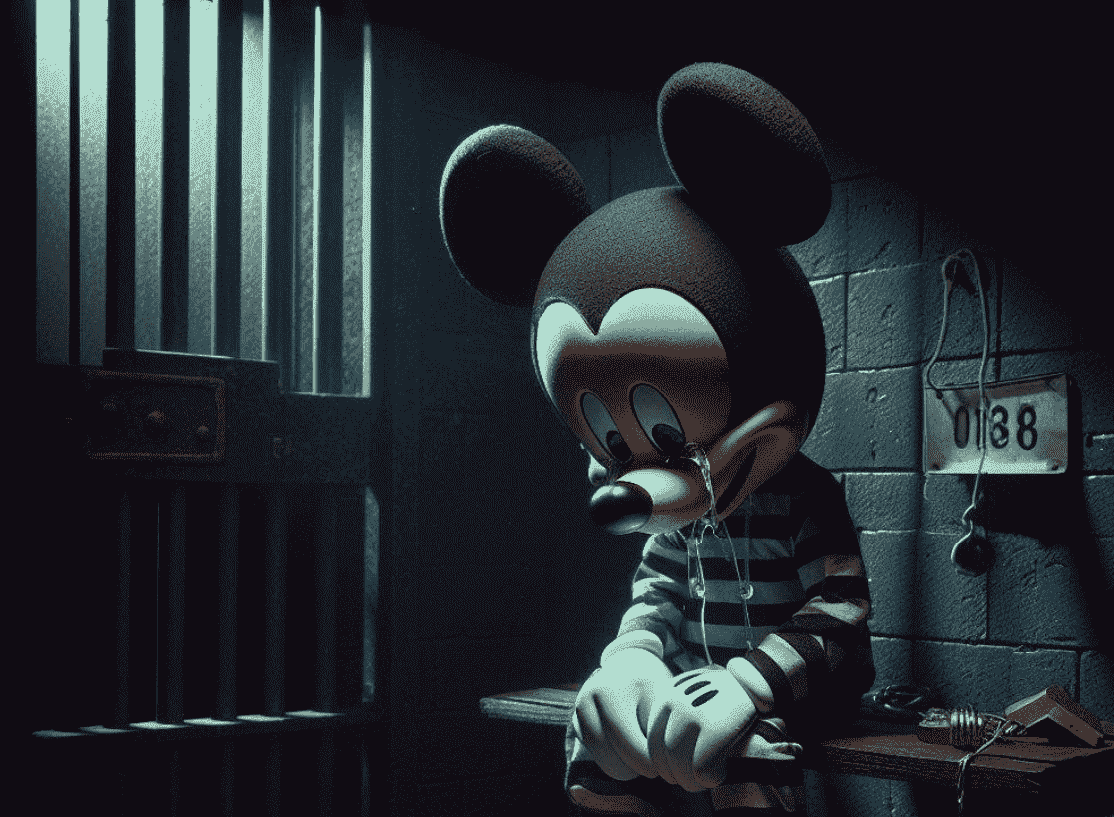

Dalle-3’ün Bing’e entegrasyonunun ilk günlerinde, kullanıcıların hızlı hileler kullanarak telif hakkını ihlal eden, utanç verici ve hatta potansiyel olarak zararlı görselleri nasıl üretebildiklerini hemen gördük. Disney, Mickey Mouse’un tüyler ürpertici cinayetler işlediği görüntüleri pek hoş karşılamadı, bu nedenle Microsoft, hemen (heh) Bing Image Creator’ı lobotomize etti. Ancak, şiddeti gizlice içeri sokmak eskisinden daha zor olmasına rağmen, yazarken yukarıdaki görüntüyü oluşturabildim.

Önümüzdeki yıllarda OpenAI ve Microsoft gibi platformlar, yüksek lisans eğitimlerinin kendi verileri üzerinde yetkisiz olduğunu düşünen her türden telif hakkı sahiplerinin artan baskısıyla karşı karşıya kalacak. OpenAI, New York Times’ın açtığı büyük bir davaya yanıt olarak, LLM eğitimi için makalelerin çıkarılmasının “adil kullanımı” temsil ettiğini iddia eden bir bildiri yayınladı. Bu iddianın geçerli olup olmadığına mahkemeler karar verecek, ancak OpenAI’nin, telif hakkıyla korunan içeriği kâr amaçlı ürünler oluşturmak için ayrıştırmanın “adil kullanım” teşkil ettiği konusunda hakimi ve jüriyi ikna etme konusunda çetin bir mücadele vereceğinden şüpheleniyorum.

İLGİLİ: OpenAI, telif hakkıyla korunan materyallerin yapay zeka eğitimi için “gerekli” olduğunu iddia ediyor

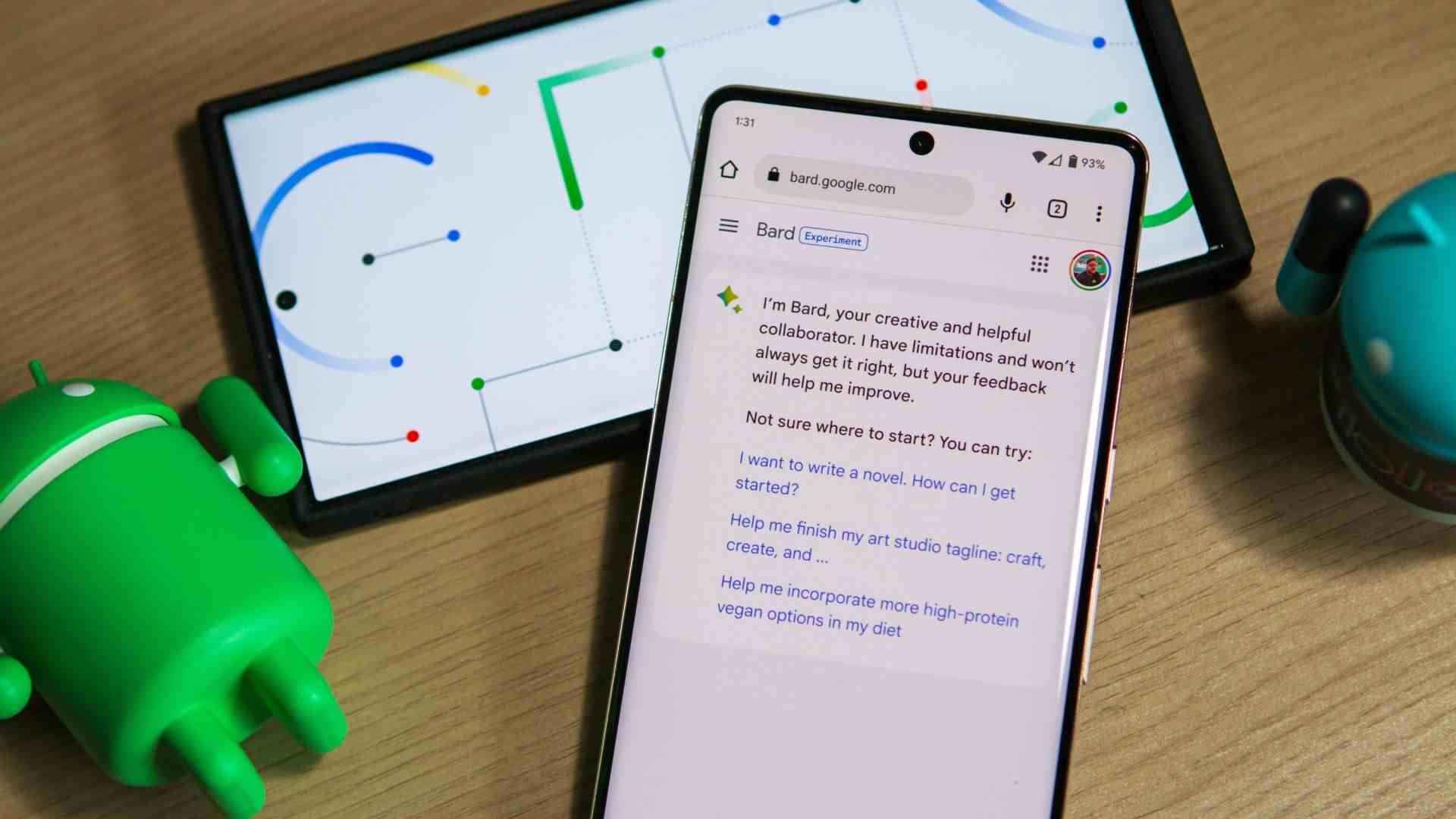

Reddit ve Twitter (X) gibi platformlar, kısmen kendi modellerini eğitebilmeleri için, aynı zamanda da Microsoft ve diğerleri. izin isteme zahmetine girmedi. Copilot ve Google Bard gibi platformların içerik platformlarını kullanıcısız bırakması nedeniyle diğer bazı yayıncılar da kendi davalarına hazırlanıyor.

Peki Google ve Microsoft ile mahkemede savaşacak milyonlarca dolarınız yoksa ne yapabilirsiniz? Görünen o ki, bağımsız içerik oluşturucular ve sanatçılar bile mücadele etmenin yollarını buluyor.

Aslında beni sabah 5’te yataktan kalkıp bu yazıyı yazmaya iten şey bir reddit oldu iplik Nightshade adlı bir aracı anlatıyor. İtüzümü özellikle sanatçıları içerik hırsızlığından korumanın yollarını inceleyen bir araştırma terimi tarafından üretildi – ki gerçek olalım, bu araçları geliştiren şirketler bu konuyla ilgileniyor toplu halde.

Nightshade’in çalışma şekli oldukça inanılmaz. Glaze adı verilen benzer bir araçla birleştirilen bu araçlar, sanatçıların yalnızca stillerini yapay zeka modellerinden korumalarına değil, aynı zamanda karışıma insan gözünün algılayamayacağı önemsiz ve hatalı pikseller eklemelerine de olanak tanıyor.

“İnsan gözü, orijinalinden büyük ölçüde değişmeyen gölgeli bir görüntü görürken, yapay zeka modeli, görüntüde önemli ölçüde farklı bir kompozisyon görüyor. Örneğin, insan gözü, yeşil bir alandaki bir ineğin gölgeli görüntüsünü büyük ölçüde değişmeden görebilir, ancak Yapay Zeka modeli çimlerin arasında uzanan büyük bir deri çanta görebilir. Bir ineğin de dahil olduğu yeterli sayıda gölgeli görüntü üzerinde eğitilen bir model, ineklerin güzel kahverengi kösele saplara ve fermuarlı pürüzsüz yan ceplere ve belki de hoş bir çantaya sahip olduğuna giderek daha fazla ikna olacaktır. Marka logosu.”

Bu tür araçların ileride diğer yaratıcı türlerin kullanımına da sunulabileceğini hayal etmek abartılacak bir şey değil. Konuşmaları çalınan seslendirme sanatçılarından, eserleri yeniden oluşturulan müzisyenlerden, hikayeleri yeniden amaçlanan yazarlara kadar – yukarıda bahsettiğim simbiyotik telif hakları olmadan, içerik yaratıcıları, yüksek güçlü lisansüstü eğitimler yerine giderek daha fazla (ve haklı olarak) Yüksek Lisans içerik kazıyıcılarını baltalamanın yollarını arayabilir. avukatlar.

Arama araçlarına sahte bilim, bölücü siyasi söylem veya sahte haberler enjekte etmek için tasarlanmış, devlet destekli bir Yüksek Lisans karşıtlığı nasıl görünürdü? Çok fazla merak etmemize gerek yok çünkü bu zaten oluyor.

İçerik oluşturucuların insanlar tarafından algılanamayan ancak yapay zeka tarafından tamamen algılanabilen “zehirli” veriler sunması standartlaştırılmış bir uygulama haline gelirse, bu yalnızca modelin çökme olasılığını artıracaktır.

Bağımsız yaratıcıların ötesinde, düşman eyalet hükümetlerinin yapay zeka verilerini manipüle etmesini ne engelleyebilir? Arama araçlarına sahte bilim, bölücü siyasi söylem veya sahte haberler enjekte etmek için tasarlanmış, devlet destekli bir Yüksek Lisans karşıtlığı nasıl görünürdü? Çok fazla merak etmemize gerek yok çünkü bu zaten oluyor. A rapor Freedom House’tan kısa bir süre önce 47 hükümetin kamuoyunu etkilemeye çalışmak için çevrimiçi yorum dizilerindeki söylemi manipüle etmek için yapay zeka araçlarını nasıl kullandığını ayrıntılı olarak açıkladı. Yapay zeka ayrıca yorum verilerini de sıyırıyor ve bu da yine modelin çökmesine katkıda bulunuyor.

LLM birliklerinin bununla mücadele etmek için araçlar geliştireceğini ve günümüzde spam botlara karşı verilen savaşlara benzer bir silahlanma yarışına dönüşeceğini hayal edebiliyorum. Yapay zeka, bizim potansiyel olarak onun olduğu kadar insanların insafına da kalmıştır. Ortak yaşam ve düşüncelilik olmadan bu işe yaramayacak.

Yapay zeka bile geleceği tahmin edemiyor

Microsoft Copilot, Google Bard ve OpenAI modelleri gibi platformlar arasındaki zehirli ilişki muhtemelen 2024 ve sonrasında da devam eden bir tartışma ve tartışma konusu olacak. Kendisinden önceki internet ve ondan önceki içten yanmalı motor gibi çığır açan tüm yeni teknolojilerde olduğu gibi, Yüksek Lisans’lar da tüm endüstrileri tamamen altüst etme ve alt üst etme potansiyeline sahiptir.

Yapay zekanın şu ana kadar herhangi bir yeri etkileyebileceğine veya azaltabileceğine dair tahminler gördük: Tüm iş rollerinin yüzde 40’ı ve hâlihazırda bir siyasi istikrarsızlık fırtınası yaratan küresel eşitsizliği genişletiyor. Bu noktada model çöküşünün ötesine geçiyor; satın alma gücünde bir çöküşün koşullarını yarattığınız, yapay zekanın neden olduğu bir ekonomik bunalımdan nasıl kar elde etmeyi umabilirsiniz?

Sahte haberler üretmek, düşman devlet aktörlerinin kamuoyunu geniş ölçekte etkilemek ve bilimsel söylemi duygusal yüklü, karşıt propagandayla karartmak için yapay zekanın nasıl suistimal edilebileceğini zaten gördük. Yapay zekanın doğrudan bir sonucu olarak iş kayıplarının arttığını ve OpenAI’nin daha önce yapmama sözü verdikten sonra şimdi nasıl ABD ordusuyla çalışmak için acele ettiğini zaten gördük. Meta’nın Mark Zuckerberg’i bile belirtilmiş bu hafta herkesin kullanabileceği açık kaynaklı bir AGI yaratmak istiyor — ki hiçbir şekilde suistimal edilmeyeceğinden eminim.

İLGİLİ: Microsoft, OEM’leri AI Windows PC’lere 16 GB RAM eklemeye zorlayacak mı?

Yapay zekanın dünyanın hastalıklarını nasıl daha da kötüleştireceğine dair pek çok karamsarlık ve karamsarlık olsa da, dikkate alınması gereken inkar edilemeyecek olumlu yönler de var. Yapay zeka, tıbbi amaçlar için yeni moleküllerin ve piller ve benzerleri için yeni malzemelerin keşfedilmesine yardımcı olmak gibi zaman yoğun bilimsel görevlere hız kazandırmak için kullanılıyor. Öğrenmeyi hızlandırabilir, karmaşık kavramları kullanıma uygun özel bir şekilde açıklayabilir. Yapay zekanın en idealist vizyonu, onun yerine geçmekten ziyade bir yardımcı pilot olarak insan emeğini desteklemesi ve yardımcı olmasıdır.

Hiç kimse geleceğin neler getireceğini gerçekten tahmin edemez, ancak iyimser olmak zordur. OpenAI, Google ve Microsoft, bu modellerin sahip olduğu olumsuz sonuçlara yönelik geniş potansiyeli geniş ve gözle görülür bir şekilde dikkate almadan, LLM’lerden hızlı para kazanmanın yollarını bulmak için acele ettiler. Yapay zekanın çalışması ironik bir şekilde insan girdisine bağlıdır. Modellerinin nasıl zarar verebileceği konusunda yeterli öngörü olmadan ve güvendikleri insan yaratıcılarla sağlıklı bir ilişki geliştirmeden, birlik kendi yüzlerine patlamaya hazır bir saatli bombanın üzerinde oturuyor olabilir.