NVIDIA, yeni nesil Hopper H200 ve Blackwell B100 AI GPU’ları için yeterli stok sağlamaya çalışırken HBM3E belleğe büyük para harcadı.

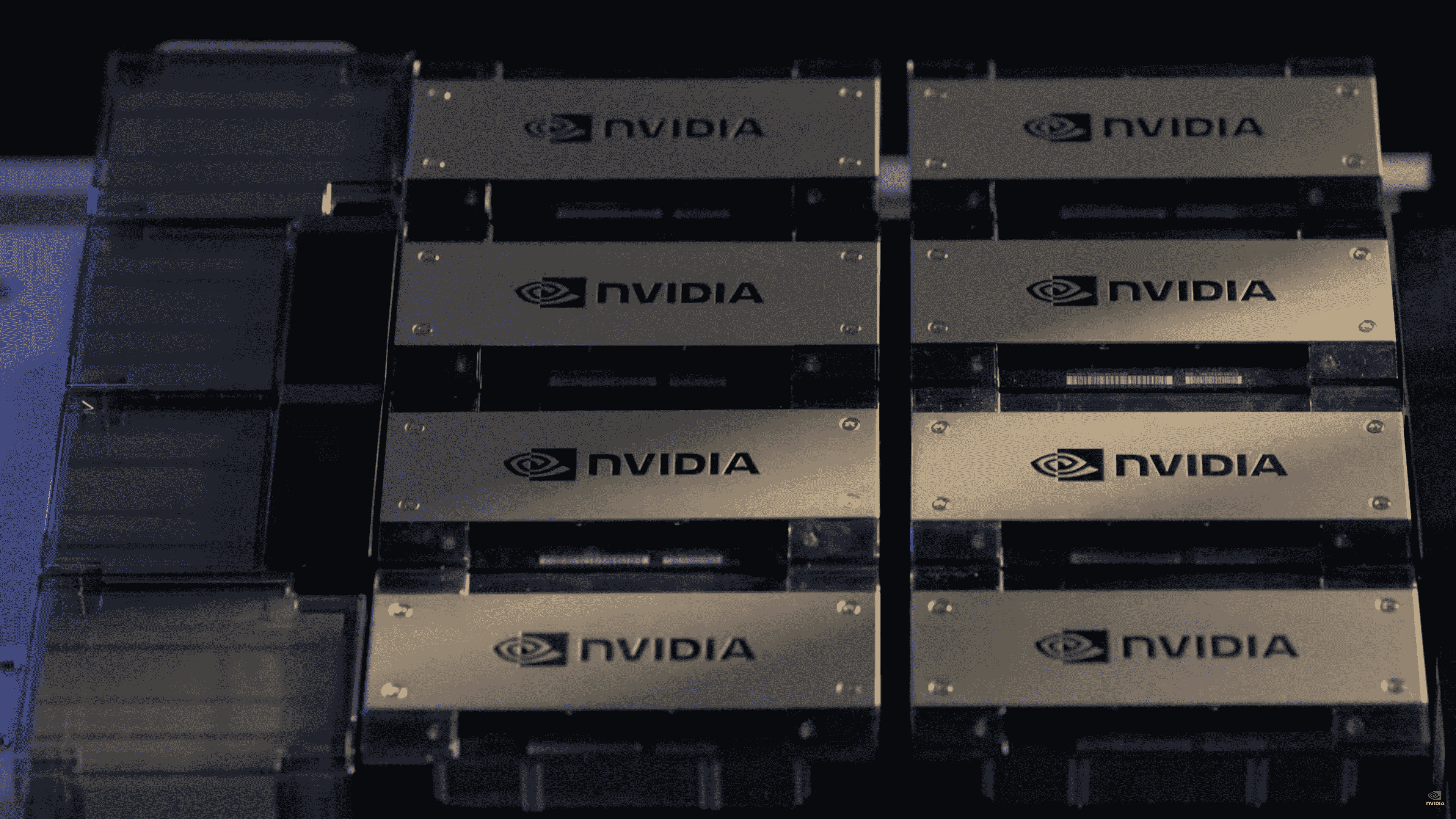

NVIDIA, 2024’ün Yapay Zeka Yarışını Yeni Nesil Hopper H200 ve Blackwell B100 GPU’larla Güçlendirecek, HBM3E Bellek Tedarikini Güvenceye Almak İçin Milyarlarca Dolar Değerinde Sipariş Verdi

Kore medyası, Biz.Chosun, NVIDIA’nın yapay zeka segmentini hedef alan yeni nesil ürünlerine hazırlanmak için SK hynix ve Micron gibi firmalardan büyük HBM3E bellek stokları için sipariş verdiğini açıkladı. Bu yaklaşım, diğer şirketlerin erişimini kısıtlayarak ya kaynakları elde edememelerine neden oluyor ya da kaynaklara erişimlerini kısıtlıyor.

Kore medyası, NVIDIA’nın HBM3E belleği için yaklaşık 700 milyar ila 1 trilyon won arasında ön ödeme yaptığını belirtiyor ki bu değişken bir rakam, ancak sektörden gelen büyük talep dikkate alındığında gerçek miktarın trilyon won sınırına yakın olmasını bekliyoruz. Bu, yalnızca ön ödemeler için yaklaşık 775 Milyon ABD Doları anlamına geliyor ve gerçek rakam muhtemelen bir Milyar ABD Dolarını aşıyor.

Ayın 26’sındaki sektöre göre, SK Hynix ve Micron’un son teknoloji bellek ürünleri tedarik etmek için Nvidia’dan 700 milyar ila 1 trilyon won arasında avans aldıkları biliniyor.

NVIDIA’nın büyük avans ödemesi, HBM üretim kapasitesini genişletmekte zorlanan bellek yarı iletken şirketlerinin yatırım eylemlerine yol açtı. Özellikle en büyük tedarikçi olan SK Hynix’in, NVIDIA’dan aldığı avans ödemesini, HBM üretim kapasitesini engelleyen TSV tesislerinin genişletilmesine yoğun bir şekilde yatırmayı planladığı biliniyor. Geçtiğimiz yılın üçüncü çeyreğinde yeni TSV hattının kurulmasına ilişkin çalışmaların sorunsuz bir şekilde yürütülmesi de bunu gösteriyor. Aynı şekilde Micron’un TSV tesislerine yaptığı yatırımın da hız kazanması bekleniyor.

Bu arada Samsung Electronics’in yakın zamanda NVIDIA ile HBM3 ve HBM3E ürün uygunluk testlerini tamamladığı ve tedarik sözleşmesi imzaladığı da biliniyor.

AI endüstrisi hızla gelişiyor, Intel ve AMD gibi şirketler segmentte NVIDIA’yı kovalamak için gelişimlerini hızlandırıyor, bu nedenle Team Green’in hakimiyetini korumak için “önleyici” önlemler alması gerekiyor

HBM3E’den bahsetmişken, şu anda NVIDIA, 2024’ün 2. çeyreğinde piyasaya çıkacağı söylenen yeni nesil Blackwell AI GPU’larında HBM3e’yi piyasaya sürmeyi planlıyor ve performans açısından, watt başına performans açısından belirleyici artışlar getirecek. chiplet tasarımının benimsenmesi. Üstelik NVIDIA’nın Hopper H200 GPU’su aynı zamanda dünyanın en hızlı HBM3E belleğiyle de donatılacak, dolayısıyla çözüm NVIDIA’nın AI & HPC pazarlarındaki başarısı açısından büyük önem taşıyor.

NVIDIA’nın veri merkezi segmentinden gelir elde etme konusunda pek çok beklentisi var, dolayısıyla diğerlerinden bir adım önde olacakları aşikar. NVIDIA, 2027 yılına kadar yapay zeka odaklı satışlardan 300 milyar dolar gibi büyük bir gelir elde etmeyi planlıyor, dolayısıyla AI GPU’larının müşterilere istikrarlı bir şekilde tedarik edilmesini sağlamak onlar için birincil hedeftir. Bir başka ilginç gerçek de, HBM3E’nin satın alınmasının, özellikle tesislerin genişletilmesi açısından HBM endüstrisine büyük bir destek getireceğidir; çünkü birikmiş siparişler, SK hynix ve Micron gibi firmalar için büyük bir sorun olduğundan, dolayısıyla önceden ölçülen bir tedarik söz konusudur. HBM’nin tesliminin çok daha kolaylaşacağı anlamına geliyor.

NVIDIA şu anda baskın bir konumda ve henüz tahtından vazgeçecek gibi görünmüyor. Team Green’in donanım departmanıyla birlikte CUDA platformunda yaptığı ilerlemeler piyasaların durumunda devrim yarattı ve geleceğin neler getireceğini görmek ilginç olacak.

Haber kaynağı: Chosun Biz