Araştırma gösteriyor ki 2026 yılına kadar, işletmelerin %80’inden fazlası bugün %5’in altında olan üretken yapay zeka modellerinden, API’lerden veya uygulamalardan yararlanacak.

Bu hızlı benimseme siber güvenlik, etik, gizlilik ve risk yönetimiyle ilgili yeni hususları gündeme getiriyor. Günümüzde üretken yapay zekayı kullanan şirketler arasında yalnızca %38’i siber güvenlik risklerini azaltıyorve yalnızca %32’si model yanlışlığını gidermeye çalışıyor.

Güvenlik uygulayıcıları ve girişimcilerle yaptığım görüşmeler üç temel faktör üzerinde yoğunlaştı:

- Kurumsal üretken yapay zekanın benimsenmesi, aşırı ayrıcalıklı erişim gibi güvenlik sorunlarına ek karmaşıklıklar getirir. Örneğin, geleneksel veri kaybını önleme araçları, yapay zeka uygulamalarına giden veri akışlarını etkili bir şekilde izleyip kontrol ederken, yapılandırılmamış veriler ve etik kurallar veya istemlerdeki önyargılı içerik gibi daha incelikli faktörler nedeniyle genellikle yetersiz kalıyor.

- Çeşitli GenAI güvenlik ürünlerine yönelik pazar talebi, yatırım getirisi potansiyeli ile uygulamaların kullanıldığı temel kullanım durumlarının doğasında olan güvenlik açıkları arasındaki dengeyle yakından bağlantılıdır. Fırsat ve risk arasındaki bu denge, yapay zeka altyapı standartlarının ve düzenleyici ortamın devam eden gelişimine bağlı olarak gelişmeye devam ediyor.

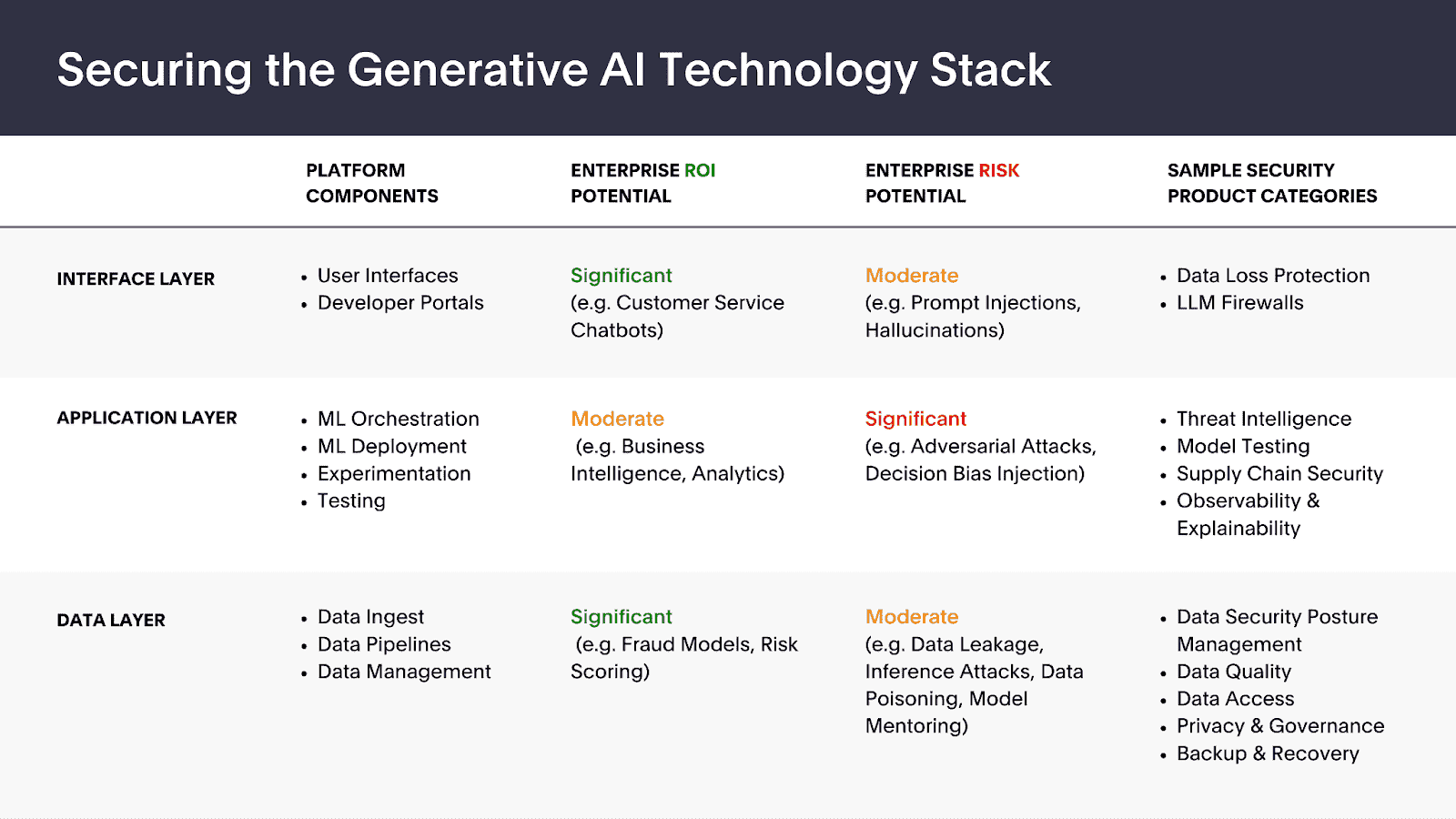

- Geleneksel yazılımlara benzer şekilde, üretken yapay zekanın tüm mimari düzeylerinde, özellikle de çekirdek arayüz, uygulama ve veri katmanlarında güvence altına alınması gerekir. Aşağıda, teknoloji yığınındaki çeşitli güvenlik ürünü kategorilerinin anlık görüntüsü yer almakta olup, güvenlik liderlerinin önemli yatırım getirisi ve risk potansiyeli algıladığı alanlar vurgulanmaktadır.

Resim Kredisi: Forgepoint Sermayesi

GenAI sohbet robotlarının yaygın şekilde benimsenmesi, kullanıcı deneyimini olumsuz etkilemeden girdileri ve karşılık gelen çıktıları doğru ve hızlı bir şekilde yakalama, inceleme ve doğrulama becerisine öncelik verecek.

Arayüz katmanı: Kullanılabilirliği güvenlikle dengelemek

İşletmeler, müşteriye yönelik sohbet robotlarından, özellikle de sektöre ve şirkete özel veriler üzerine eğitilmiş özelleştirilmiş modellerden yararlanma konusunda büyük bir potansiyel görüyor. Kullanıcı arayüzü, modelin tepkisini veya davranışını manipüle etmeyi amaçlayan enjeksiyon saldırılarının bir çeşidi olan hızlı enjeksiyonlara karşı hassastır.

Ayrıca, bilgi güvenliği yöneticileri (CISO’lar) ve güvenlik liderleri, kuruluşlarında GenAI uygulamalarını etkinleştirme konusunda giderek daha fazla baskı altındadır. İşletmenin tüketiciye yönelik hale getirilmesi devam eden bir trend olsa da, ChatGPT gibi teknolojilerin hızlı ve yaygın biçimde benimsenmesi, bunların işyerinde kullanılmasına yönelik benzeri görülmemiş, çalışanlar tarafından yönlendirilen bir çabayı ateşledi.

GenAI sohbet robotlarının yaygın şekilde benimsenmesi, kullanıcı deneyimini olumsuz etkilemeden girdileri ve karşılık gelen çıktıları doğru ve hızlı bir şekilde yakalama, inceleme ve doğrulama becerisine öncelik verecek. Mevcut veri güvenliği araçları genellikle önceden belirlenmiş kurallara dayanır ve bu da hatalı pozitif sonuçlara yol açar. Yapay Zekayı Koru gibi araçlar Reddetme Ve Harmonik Güvenlik GenAI uygulamasından geçen verilerin hassas olup olmadığını dinamik olarak belirlemek için AI modellerinden yararlanın.