Yapay zeka kadar hızlı hareket eden bir sektöre ayak uydurmak zorlu bir iştir. Yani bir yapay zeka bunu sizin için yapana kadar, kendi başımıza ele almadığımız dikkate değer araştırma ve deneylerin yanı sıra, makine öğrenimi dünyasındaki son hikayelerin kullanışlı bir özetini burada bulabilirsiniz.

Bu hafta AI’da, Google’ın sahip olduğu AI Ar-Ge laboratuvarı DeepMind bir rapor yayınladı. kağıt Yapay zeka sistemlerinin toplumsal ve etik risklerini değerlendirmek için bir çerçeve önermek.

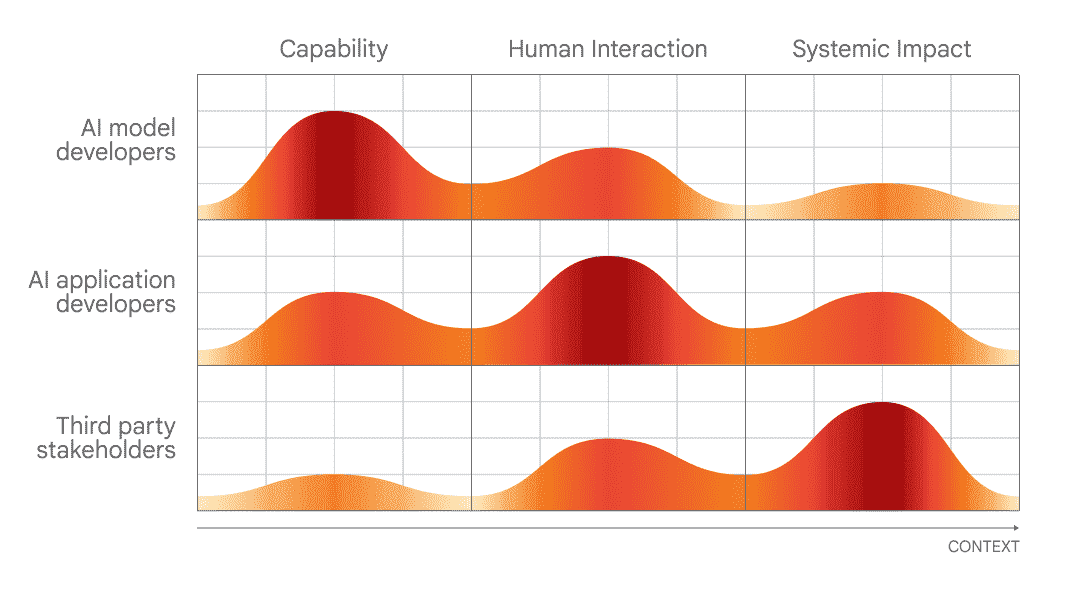

Yapay zeka geliştiricilerinin, uygulama geliştiricilerinin ve “daha geniş kamu paydaşlarının” yapay zekanın değerlendirilmesi ve denetlenmesine farklı düzeylerde katılımını gerektiren makalenin zamanlaması tesadüfi değildir.

Önümüzdeki hafta, uluslararası hükümetleri, önde gelen yapay zeka şirketlerini, sivil toplum gruplarını ve araştırma uzmanlarını bir araya getirerek yapay zekadaki en son gelişmelerden kaynaklanan risklerin en iyi şekilde nasıl yönetilebileceğine odaklanacak olan Birleşik Krallık hükümetinin sponsorluğunda düzenlenen bir etkinlik olan Yapay Zeka Güvenlik Zirvesi var. üretken yapay zeka dahil (örn. ChatGPT, Stabil Difüzyon vb.). Orada, İngiltere planlama Yapay zeka konusunda, BM’nin Hükümetlerarası İklim Değişikliği Paneli’ni gevşek bir şekilde modelleyen, yapay zekadaki en son gelişmeler ve bunlarla ilgili tehlikeler hakkında düzenli raporlar yazacak dönüşümlü bir akademisyen kadrosundan oluşan küresel bir danışma grubu oluşturmak.

DeepMind, iki günlük zirvedeki sahadaki politika görüşmeleri öncesinde bakış açısını çok görünür bir şekilde ortaya koyuyor. Ve yeri geldiğinde itibar etmek için araştırma laboratuvarı, yapay zeka sistemlerini “insan etkileşimi noktasında” incelemeye yönelik yaklaşımlar ve bu sistemlerin kullanılabileceği yollar çağrısında bulunmak gibi (açıkça da olsa) birkaç makul noktaya değiniyor ve toplumun içine yerleştirilmiştir.

Hangi kişilerin yapay zekanın hangi yönlerini değerlendirmede en iyi olabileceğini gösteren tablo.

Ancak DeepMind’ın önerilerini değerlendirirken laboratuvarın ana şirketi Google’ın son dönemdeki bir değerlendirmede nasıl puan aldığına bakmak bilgilendirici olacaktır. çalışmak Stanford araştırmacıları tarafından ne kadar açık bir şekilde çalıştıklarına göre on ana yapay zeka modelini sıralayan bir rapor yayınlandı.

Yapımcısının eğitim verilerinin kaynaklarını açıklayıp açıklamadığı, kullandığı donanımla ilgili bilgiler, eğitimde harcanan emek ve diğer ayrıntılar da dahil olmak üzere 100 kritere göre derecelendirilen Google’ın amiral gemisi metin analizli yapay zeka modellerinden biri olan PaLM 2, sadece 40 puan alıyor. %.

DeepMind, PaLM 2’yi en azından doğrudan geliştirmedi. Ancak laboratuvar, kendi modelleri konusunda tarihsel olarak tutarlı bir şekilde şeffaf değildi ve ana şirketin temel şeffaflık önlemleri konusunda yetersiz kalması, DeepMind’ın daha iyisini yapması için yukarıdan aşağıya çok fazla baskı olmadığını gösteriyor.

Öte yandan DeepMind, politika hakkındaki kamuoyu düşüncelerinin yanı sıra, modellerinin mimarileri ve iç işleyişi konusunda ağzı sıkı olduğu algısını değiştirmek için adımlar atıyor gibi görünüyor. Laboratuvar, OpenAI ve Anthropic ile birlikte birkaç ay önce değerlendirme ve güvenlik araştırmalarını desteklemek için Birleşik Krallık hükümetine yapay zeka modellerine “erken veya öncelikli erişim” sağlama taahhüdünde bulundu.

Sorun şu ki, bu yalnızca performans amaçlı mı? Sonuçta hiç kimse DeepMind’ı hayırseverlikle suçlamaz; laboratuvar, esas olarak çalışmalarını Google ekiplerine dahili olarak lisanslayarak her yıl yüz milyonlarca dolar gelir elde ediyor.

Belki de laboratuvarın bir sonraki büyük etik testi, DeepMind CEO’su Demis Hassabis’in yetenekleri açısından OpenAI’nin ChatGPT’sine rakip olacağına defalarca söz verdiği, yakında çıkacak olan AI sohbet robotu Gemini’dir. DeepMind, yapay zeka etiği alanında ciddiye alınmak istiyorsa, Gemini’nin yalnızca güçlü yönlerini değil, zayıf yönlerini ve sınırlamalarını da tam ve kapsamlı bir şekilde detaylandırması gerekecek. Önümüzdeki aylarda işlerin nasıl gelişeceğini görmek için kesinlikle yakından izleyeceğiz.

İşte son birkaç güne ait diğer AI hikayeleri:

- Microsoft araştırması GPT-4’te kusurlar buluyor: Microsoft’a bağlı yeni bir bilimsel makale, OpenAI’nin GPT-4’ü de dahil olmak üzere büyük dil modellerinin (LLM’ler) “güvenilirliğine” ve toksisitesine baktı. Ortak yazarlar, GPT-4’ün daha önceki bir sürümünün, diğer LLM’lere göre toksik, önyargılı metinler yayınlamaya daha kolay yönlendirilebileceğini buldu. Çok büyük.

- ChatGPT web aramasını ve DALL-E 3’ü alıyor: OpenAI’den bahsetmişken, şirketin resmen başlatıldı ChatGPT’ye yönelik internet tarama özelliği, bazıları özelliğin yeniden sunulmasından üç hafta sonra Birkaç ay aradan sonra beta sürümünde. İlgili bir haberde OpenAI, metinden görüntüye oluşturucunun en son versiyonunun piyasaya sürülmesinden bir ay sonra DALL-E 3’ü de betaya geçirdi..

- GPT-4V’ye meydan okuyanlar: OpenAI, GPT-4’ün metinlerin yanı sıra görüntüleri de anlayan bir çeşidi olan GPT-4V’yi yakında piyasaya sürmeye hazırlanıyor. Ancak iki açık kaynak alternatifi, onu tam anlamıyla geride bırakıyor: LLaVA-1.5 ve iyi finanse edilen startup Adept’in bir modeli olan Fuyu-8B. Her ikisi de GPT-4V kadar yetenekli değildir, ancak ikisi de buna yakındır ve daha da önemlisi, kullanımları ücretsizdir.

- Yapay Zeka Pokémon oynayabilir mi?: Geçtiğimiz birkaç yılda Seattle merkezli yazılım mühendisi Peter Whidden Pokémon serisinin klasik ilk oyununda gezinmek için bir takviyeli öğrenme algoritması eğitiyor. Şu anda yalnızca Cerulean Şehri’ne ulaşıyor ancak Whidden gelişmeye devam edeceğinden emin.

- Yapay zeka destekli dil öğretmeni: Google, insanların İngilizce konuşma becerilerini pratik etmelerine ve geliştirmelerine yardımcı olmak için tasarlanmış yeni bir Google Arama özelliğiyle Duolingo’ya yöneliyor. Önümüzdeki birkaç gün içinde belirli ülkelerdeki Android cihazlarda kullanıma sunulacak olan yeni özellik, İngilizce’ye veya İngilizce’den çeviri yapan dil öğrenenler için etkileşimli konuşma pratiği sağlayacak.

- Amazon daha fazla depo robotu piyasaya sürüyor: Bu hafta düzenlenen bir etkinlikte Amazon duyuruldu Agility’nin iki ayaklı robotu Digit’i tesislerinde test etmeye başlayacağını söyledi. Brian, satır aralarını okursak Amazon’un şu anda 750.000 robot sisteminin kuzeyini kullanan depo tesislerine Digit’i yerleştirmeye başlayacağının hiçbir garantisinin olmadığını yazıyor.

- Simülatörler üzerine simülatörler: Aynı hafta Nvidia, saf, AI odaklı bir robotun bir görevi daha iyi yerine getirmesine rehberlik etmek için takviyeli öğrenme kodu yazmaya yardımcı olmak için bir Yüksek Lisans uygulamasının tanıtımını yaptı ve Meta, Habitat 3.0’ı piyasaya sürdü. Yapay zeka ajanlarının gerçekçi iç mekan ortamlarında eğitilmesine yönelik Meta’nın veri setinin en son sürümü. Habitat 3.0, insan avatarlarının VR’deki alanı paylaşması olasılığını ekliyor.

- Çin’in teknoloji devleri OpenAI rakibine yatırım yapıyor: Üretken yapay zeka alanında OpenAI’lere ve diğerlerine rakip olacak yapay zeka modelleri geliştiren Çin merkezli bir girişim olan Zhipu AI, duyuruldu Bu hafta, bu yıla kadar toplam finansmanda 2,5 milyar yuan (340 milyon $) toplandı. Duyuru, ABD ile Çin arasındaki jeopolitik gerilimlerin arttığı ve hiçbir azalma belirtisi göstermediği bir dönemde geldi.

- ABD, Çin’in yapay zeka çipi tedarikini kesti: Jeopolitik gerilimler konusunda, Biden yönetimi bu hafta Pekin’in askeri hedeflerini frenlemeye yönelik, Nvidia’nın Çin’e yapay zeka çipi sevkiyatına daha fazla kısıtlama getirilmesi de dahil olmak üzere bir dizi önlem duyurdu. A800 ve H800, Nvidia’nın Çin’e gönderime devam etmek için özel olarak tasarladığı iki AI çipi, yeni kuralların yeni turundan etkilenecek.

- Pop şarkılarının yapay zeka tekrarları viral oluyor: Amanda ilginç bir eğilimi ele alıyor: TikTok hesapları Homer Simpson gibi karakterlerin 90’lar ve 2000’lerin rock şarkılarını söylemesini sağlamak için yapay zekayı kullanan “Ergen ruhu gibi kokuyor.” Amanda, görünüşte eğlenceli ve aptalca olduklarını ancak tüm uygulamanın karanlık bir alt tonu olduğunu yazıyor.

Daha fazla makine öğrenimi

Makine öğrenimi modelleri biyolojik bilimlerde sürekli ilerlemelere yol açmaktadır. AlphaFold ve RoseTTAFold, inatçı bir problemin (protein katlanması) doğru yapay zeka modeliyle nasıl önemsizleştirilebileceğinin örnekleriydi. Şimdi David Baker (ikinci modelin yaratıcısı) ve laboratuvar arkadaşları, tahmin sürecini ilgili amino asit zincirlerinin yapısından daha fazlasını içerecek şekilde genişletti. Sonuçta proteinler diğer molekül ve atomlardan oluşan bir çorbanın içinde bulunur ve bunların vücuttaki başıboş bileşiklerle veya elementlerle nasıl etkileşime gireceklerini tahmin etmek, onların gerçek şeklini ve aktivitesini anlamak için çok önemlidir. RoseTTAFold All-Atom biyolojik sistemleri simüle etmek için ileriye doğru büyük bir adımdır.

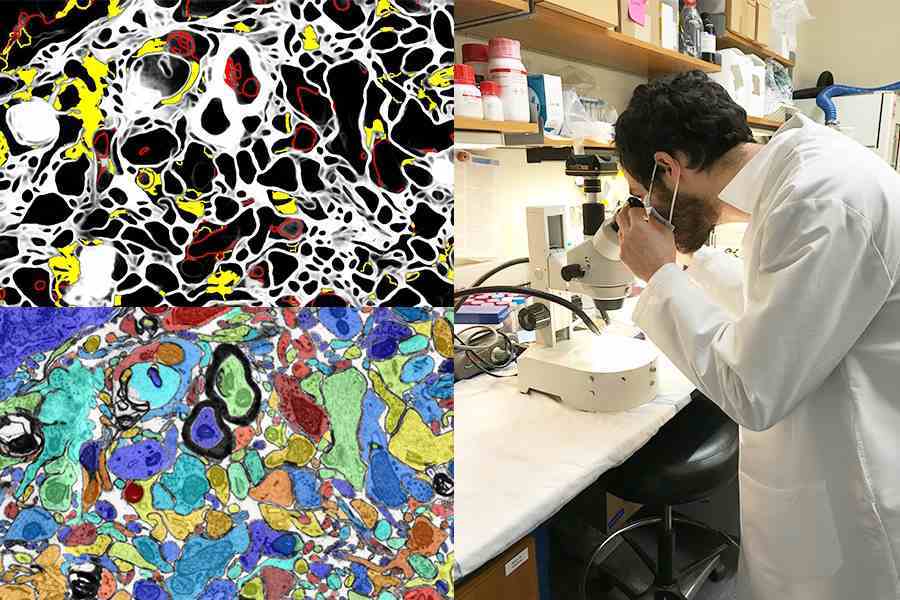

Resim Kredisi: MIT/Harvard Üniversitesi

Görsel bir yapay zekaya sahip olmak, laboratuvar çalışmalarını geliştirmek veya bir öğrenme aracı olarak hareket etmek de harika bir fırsattır. MIT ve Harvard’dan SmartEM projesi taramalı elektron mikroskobunun içine bir bilgisayarlı görme sistemi ve ML kontrol sistemi yerleştirilerek cihazın bir numuneyi akıllıca incelemesini sağlar. Düşük öneme sahip alanlardan kaçınabilir, ilginç veya net olanlara odaklanabilir ve ayrıca ortaya çıkan görüntüyü akıllı bir şekilde etiketleyebilir.

Yapay zeka ve diğer ileri teknoloji araçlarının arkeolojik amaçlarla kullanılması benim için (tabii ki) asla eskimez. İster Maya şehirlerini ve otoyollarını ortaya çıkaran Lidar olsun, ister tamamlanmamış antik Yunan metinlerindeki boşlukları dolduruyor olsun, bunu görmek her zaman güzeldir. Ve Pompei’yi yerle bir eden volkanik patlamada yok olduğu düşünülen bir parşömenin yeniden inşası, şimdiye kadarki en etkileyici olanlardan biri.

Yanmış, kıvrılmış bir papirüsün ML yorumlu CT taraması. Görünen kelimede “Mor” yazıyor.

Nebraska Üniversitesi-Lincoln Bilgisayar Bilimleri öğrencisi Luke Farritor, çıplak gözle görülemeyen kömürleşmiş, kıvrılmış papirüs taramalarındaki ince desenleri güçlendirmek için bir makine öğrenimi modeli eğitti. Onunki, parşömenleri okumak için uluslararası bir meydan okumada denenen birçok yöntemden biriydi ve değerli akademik çalışmalar gerçekleştirmek için geliştirilebilirdi. Nature hakkında daha fazla bilgi burada. Parşömen içinde ne olduğunu mu soruyorsunuz? Şu ana kadar sadece “mor” kelimesi kullanıldı ama bu bile papirologların aklını kaybetmesine neden oldu.

Yapay zekanın bir akademik zaferi daha Vikipedi’deki alıntıları incelemek ve önermek için kullanılan bu sistem. Yapay zeka elbette neyin doğru veya gerçek olduğunu bilmiyor ancak bağlamdan yüksek kaliteli bir Vikipedi makalesinin ve alıntısının neye benzediğini toplayabilir ve alternatifler bulmak için siteyi ve web’i tarayabilir. Hiç kimse, kullanıcı odaklı meşhur çevrimiçi ansiklopediyi robotların yönetmesine izin vermemizi önermiyor, ancak bu, alıntıların eksik olduğu veya editörlerin emin olmadığı makalelerin desteklenmesine yardımcı olabilir.

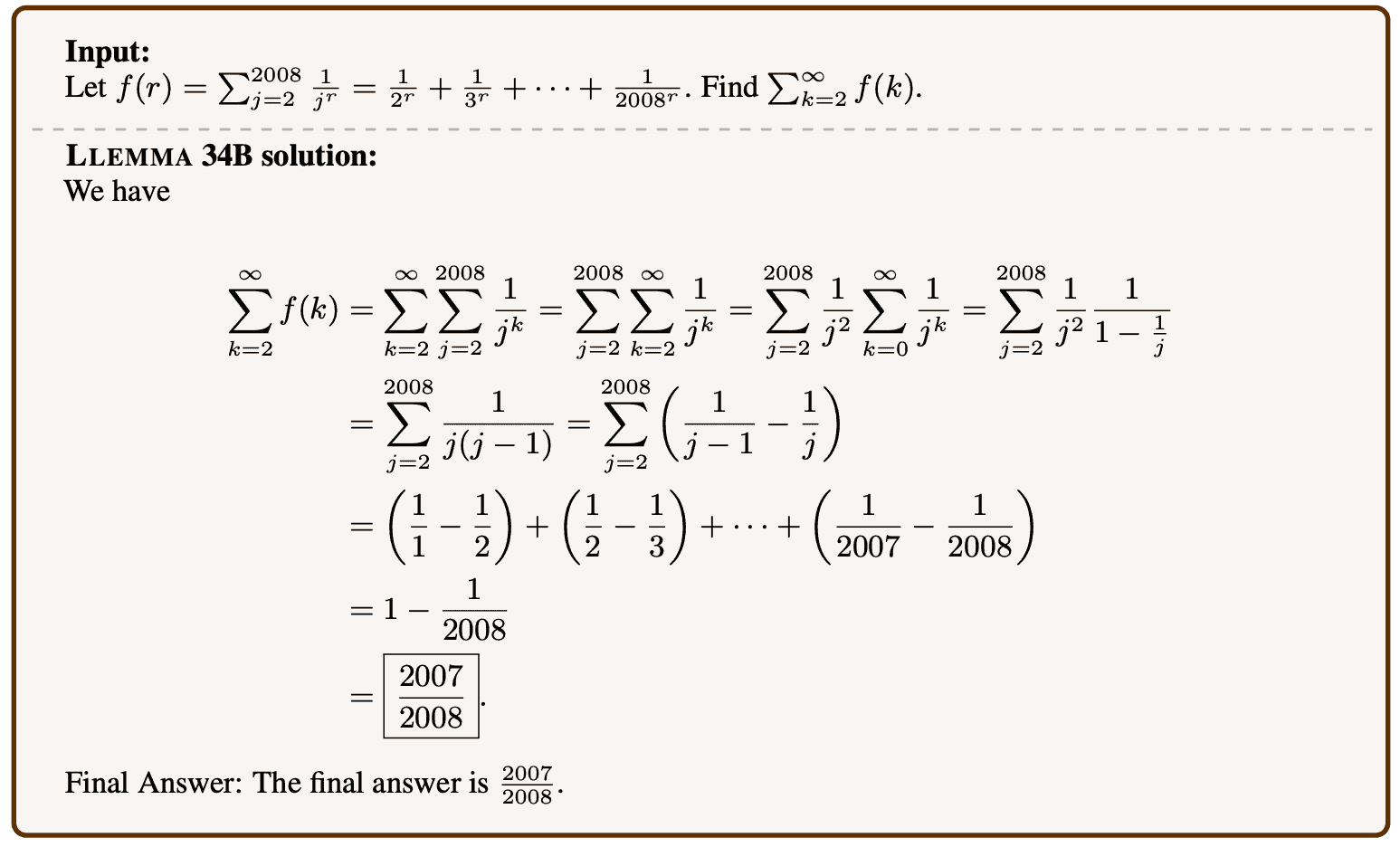

Llemma tarafından çözülen bir matematik probleminin örneği.

Dil modellerine birçok konuda ince ayar yapılabilir ve yüksek matematik şaşırtıcı bir şekilde bunlardan biridir. Llemma yeni bir açık modeldir Oldukça karmaşık problemleri çözebilecek matematiksel kanıtlar ve makaleler konusunda eğitimli. Bu ilk değil – Google Araştırma’dan Minerva benzer yetenekler üzerinde çalışıyor – ancak benzer sorun kümeleri üzerindeki başarısı ve geliştirilmiş verimliliği, “açık” modellerin (terimin değeri ne olursa olsun) bu alanda rekabetçi olduğunu gösteriyor. Belirli yapay zeka türlerinin özel modellerin hakimiyetinde olması istenmez, bu nedenle yeteneklerinin açıkta kopyalanması, yeni bir çığır açmasa bile değerlidir.

Sorunlu bir şekilde Meta, kendi akademik çalışmalarında zihinleri okumaya doğru ilerliyor; ancak bu alandaki çoğu çalışmada olduğu gibi, sunuluş şekli süreci fazlasıyla abartıyor. “Beyin kod çözme: Görsel algının gerçek zamanlı yeniden yapılandırılmasına doğru” adlı bir makalede sanki doğrudan zihin okuyorlarmış gibi görünebilir.

Solda insanlara gösterilen görüntüler ve sağda üretken yapay zeka, kişinin ne algıladığını tahmin ediyor.

Ama bundan biraz daha dolaylı. Araştırmacılar, insanlar atlar veya uçaklar gibi belirli nesnelerin görüntülerine bakarken yüksek frekanslı beyin taramasının nasıl göründüğünü inceleyerek, kişinin düşündüğünü veya baktığını düşündükleri şeyin neredeyse gerçek zamanlı olarak yeniden yapılandırılmasını gerçekleştirebiliyorlar. . Yine de, taramalara doğrudan karşılık gelmese bile bir şeyin görsel ifadesini nasıl yaratabileceği konusunda üretken yapay zekanın burada oynayacağı bir rol olması muhtemel görünüyor.

Meli Peki eğer mümkün olursa, insanların zihinlerini okumak için yapay zekayı mı kullanacağız? DeepMind’a sorun – yukarıya bakın.

Son olarak, LAION’da şu anda somut olmaktan ziyade istek uyandıran ama yine de övgüye değer bir proje. Ses Temsili Edinimi için Çok Dilli Karşılaştırmalı Öğrenme veya CLARA, dil modellerine insan konuşmasındaki nüansların daha iyi anlaşılmasını sağlamayı amaçlamaktadır. Ton veya telaffuz gibi sözlü olmayan sinyallerden alaycılığı veya yalanları nasıl anlayabileceğinizi biliyor musunuz? Makineler bu konuda oldukça kötü, bu da herhangi bir insan-yapay zeka etkileşimi için kötü bir haber. CLARA, bazı duygusal durumları ve diğer sözel olmayan “konuşmayı anlama” ipuçlarını tanımlamak için birden fazla dilde ses ve metin kütüphanesi kullanır.