AI’lar için insan yapımı eğitim materyali kıt hale geliyor. Ama neden sistemleri kendi çıktılarıyla beslemiyorsunuz? Araştırmacılar şimdi tam olarak bu yaklaşımı incelediler ve yapay zekanın hızla çıldırdığını keşfettiler.

Tüketim döngüsü yapay zekayı “MAD” yapar

Bu, şu anda birçok uzmanın ve şirketin düşündüğü bir sorundur. AI’lar şu anda çalıştıkları şekliyle eğitimleri için yüksek kaliteli materyallere ihtiyaç duyuyor. Ancak araştırmacılara göre bunun önümüzdeki birkaç yıl içinde tükeneceği öngörülüyor. Rice ve Stanford üniversitelerinden bilim adamlarının yaptıkları çalışmada açıkladığı gibi, sektörde tartışılan bir çıkış yolu, muhtemelen bir çıkmaz sokaktan başka bir şey değildir. İster dil modelleri ister görüntü oluşturucular olsun, üretici yapay zeka modellerini yapay zeka tarafından oluşturulan malzemeyle eğittiğinizde, sonuçlar daha da kötüleşir.

Araştırmacılar yüksek sesle, “Görüntüler, metin ve diğer veri türleri için üretken AI algoritmalarındaki muazzam ilerlemeler, yeni nesil modelleri eğitmek için sentetik verileri kullanma konusunda bir cazibe yarattı.” Fütürizm. Ancak çalışmasında, bu tür girişimler yalnızca “kendi kendini tüketen bir döngüye” yol açar. En önemli sonuç: Gerçek veriler olmadan, gelecekteki üretken modeller kalite açısından giderek kötüleşmeye “mahkumdur”.

Araştırmacıların açıkladığı gibi, bu kendine zarar verici davranışın bir nedeni, mevcut yapay zeka sistemlerinin modelin eğitim verilerinin ucundaki uzak, daha az temsil edilen bilgilere giderek daha az ağırlık verme eğilimidir. Verilerin bu yakınsaması o kadar şiddetli bir şekilde artar ki, sistem tam anlamıyla çöker. Araştırmacılar bu sürece Model Otofaji Bozukluğunun kısaltması olan “MAD” adını veriyorlar.

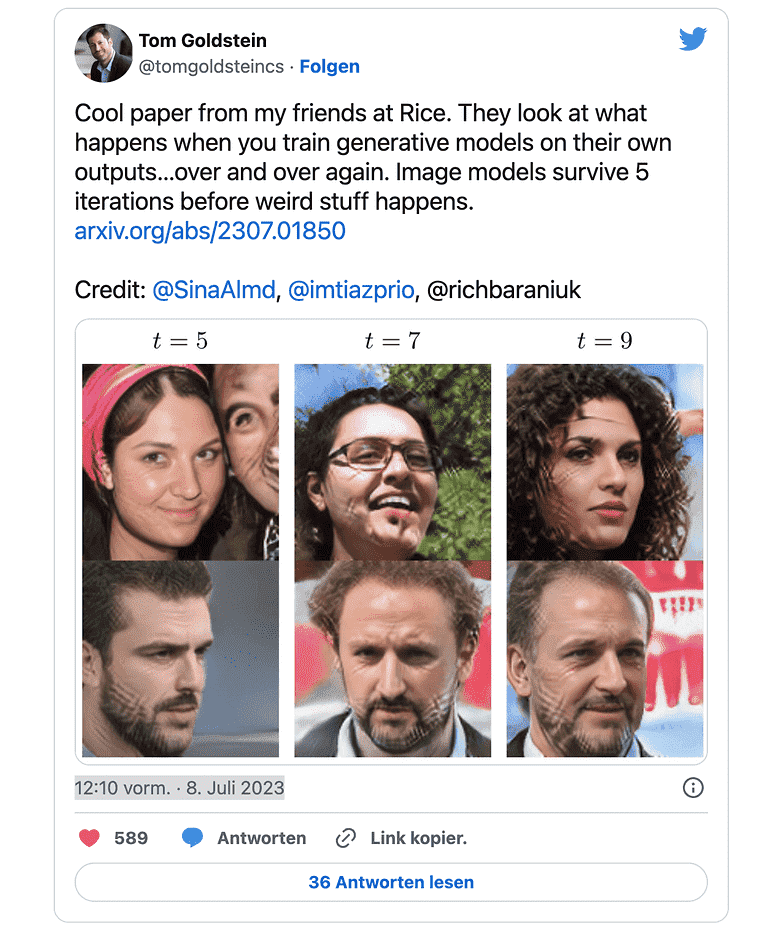

AI modelleri, AI içeriği konusunda eğitildiklerinde garip şeyler yapar. Ancak bu neredeyse kaçınılmazdır. / © Tom Goldstein, Ekran Görüntüsü: nextpit

Bu “hastalığın” yeni nesil modellere zaten fark edilmeden bulaşmış olma ihtimali yüksektir. Çoğu durumda, eğitim verileri İnternet’e kaydedilir. Bu nedenle, gelecekteki üretken yapay zekalar, kaçınılmaz olarak önceki sistemler tarafından üretilen daha fazla veri ile eğitilecektir.

Özet

- AI’lar, gelecekte kıt hale gelebilecek yüksek kaliteli eğitim materyali gerektirir.

- Araştırmacılar bir çıkış yolu tartıştılar: AI tarafından üretilen verileri kullanmak.

- Çalışma şunu gösteriyor: AI tarafından oluşturulan veriler daha kötü sonuçlara yol açıyor.

- Araştırmacılar bu süreci “model otofaji bozukluğu” olarak adlandırıyorlar.

- Yaklaşan üretken yapay zekalar, giderek daha fazla yapay zeka tarafından üretilen verilerle eğitilecek.

- Gerçek veriler olmadan, gelecekteki üretken modeller bozulmaya “mahkumdur”.