Pazartesi günü Google, OpenAI’nin ChatGPT’sine rakip olan ve “önümüzdeki haftalarda halka daha geniş çapta erişilebilir” hale gelecek olan yapay zeka sohbet robotu Bard’ı duyurdu. Ancak uzmanlar, Bard’ın ilk demosunda olgusal bir hata yaptığını belirttiğinden, bot harika bir başlangıç yapmadı.

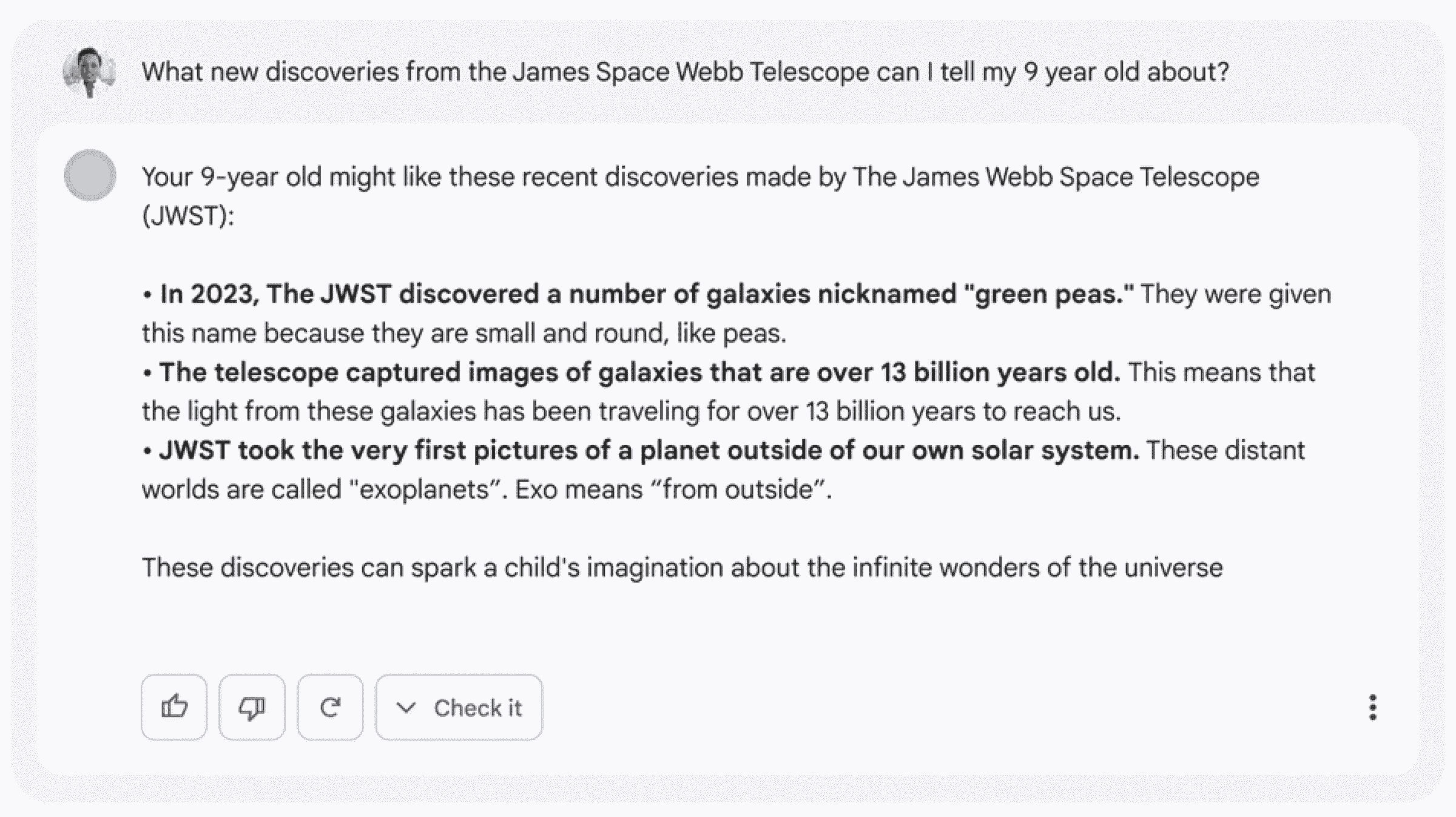

Google tarafından paylaşılan bir GIF, Bard’ın şu soruyu yanıtladığını gösteriyor: “9 yaşındaki çocuğuma James Webb Uzay Teleskobu’ndan hangi yeni keşifleri anlatabilirim?” Bard, karşılığında, teleskopun “kendi güneş sistemimizin dışındaki bir gezegenin ilk fotoğraflarını çektiğini” belirten biri de dahil olmak üzere üç madde işareti sunuyor.

Bununla birlikte, Twitter’daki bazı astronomlar bunun yanlış olduğuna ve bir ötegezegenin ilk görüntüsünün 2004’te çekildiğine dikkat çekti. NASA’nın web sitesinde burada belirtildiği gibi.

Astrofizikçi Grant Tremblay, “Gerçekten salaklık yapmak istemem ve eminim Bard etkileyici olacaktır, ancak kayıtlara geçsin: JWST, ‘güneş sistemimizin dışındaki bir gezegenin ilk görüntüsünü’ çekmedi” diye tweet attı astrofizikçi Grant Tremblay .

UC Santa Cruz’daki California Üniversitesi Gözlemevleri’nin yöneticisi Bruce Macintosh da hataya dikkat çekti. “JWST fırlatılmadan 14 yıl önce bir dış gezegeni görüntüleyen biri olarak konuşursak, daha iyi bir örnek bulmanız gerektiğini düşünüyor musunuz?” O tweet attı.

(Hata ve uzmanların itirazları ilk olarak Reuters Ve Yeni Bilim İnsanı.)

Bir takip tweet’inde Tremblay şunları ekledi: “Gezegendeki en güçlü şirketlerden birinin LLM’lerinin reklamını yapmak için bir JWST araması kullanmasını seviyorum ve takdir ediyorum. Mükemmel! Ancak ChatGPT vb., ürkütücü derecede etkileyici olsa da genellikle *kendinden emin bir şekilde* yanlıştır. LLM’lerin kendi hatalarını kontrol ettiği bir geleceği görmek ilginç olacak.”

Tremblay’in belirttiği gibi, ChatGPT ve Bard gibi yapay zeka sohbet robotları için önemli bir sorun, yanlış bilgileri gerçekmiş gibi güvenle ifade etme eğilimleridir. Sistemler sıklıkla “halüsinasyon görür” – yani bilgi oluşturur – çünkü bunlar esasen otomatik tamamlama sistemleridir.

Soruları cevaplamak için kanıtlanmış gerçeklerden oluşan bir veri tabanını sorgulamak yerine, herhangi bir cümlede hangi kelimenin bir sonraki kelimeyi takip ettiğini belirlemek için büyük metin külliyatı ve analiz kalıpları üzerinde eğitilirler. Başka bir deyişle, deterministik değil olasılıkçıdırlar – önde gelen bir AI profesörünün onları “saçmalık üreteçleri” olarak etiketlemesine yol açan bir özellik.

Elbette internet zaten yanlış ve yanıltıcı bilgilerle dolu ancak Microsoft ve Google’ın bu araçları arama motoru olarak kullanma isteğiyle sorun daha da büyüyor. Orada, sohbet robotlarının yanıtları, sözde her şeyi bilen bir makinenin yetkisini alır.

Dün yapay zeka destekli yeni Bing arama motorunun tanıtımını yapan Microsoft, sorumluluğu kullanıcıya yükleyerek bu sorunların önüne geçmeye çalıştı. Şirketin feragatnamesi, “Bing, yapay zeka tarafından desteklenmektedir, bu nedenle sürprizler ve hatalar mümkündür” diyor. “Öğrenip gelişebilmemiz için gerçekleri kontrol ettiğinizden ve geri bildirim paylaştığınızdan emin olun!”