Ticari açıdan oldukça başarılı bir yazarın bir zamanlar yazdığı gibi, “Gece karanlık ve dehşetle dolu, gün parlak, güzel ve umut dolu.” Tüm teknolojiler gibi artıları ve eksileri olan AI için uygun görüntüler.

Örneğin, Stable Diffusion gibi sanat üreten modeller, inanılmaz yaratıcılık taşkınlıklarına, uygulamaları güçlendirmeye ve hatta tamamen yeni iş modellerine yol açtı. Öte yandan, açık kaynak doğası, kötü aktörlerin geniş ölçekte deepfake’ler oluşturmak için onu kullanmasına izin verirken, sanatçılar işlerinden kâr elde ettiğini protesto ederken.

2023’te AI için güvertede neler var? Düzenleme, AI’nın getirdiklerinin en kötüsünü dizginleyecek mi, yoksa taşkın kapakları açık mı? ChatGPT gibi güçlü, dönüştürücü yeni AI biçimleri ortaya çıkacak mı, bir zamanlar otomasyondan güvenli olduğu düşünülen endüstrileri bozacak mı?

Sanat üreten daha fazla (sorunlu) yapay zeka uygulaması bekleyin

Prisma Labs’in yapay zeka destekli özçekim uygulaması Lensa’nın viral hale gelen başarısıyla, bu doğrultuda pek çok ben de uygulama bekleyebilirsiniz. Ayrıca, NSFW görüntüleri oluşturmaları için kandırılmalarını ve orantısız bir şekilde cinselleştirmek ve değiştirmek kadınların görünüşü.

Mozilla Vakfı’nda kıdemli bir politika araştırmacısı olan Maximilian Gahntz, üretici yapay zekanın tüketici teknolojisine entegrasyonunun bu tür sistemlerin hem iyi hem de kötü etkilerini artırmasını beklediğini söyledi.

Örneğin Stable Difüzyon, belirli kelimeleri ve kavramları belirli görüntülerle ilişkilendirmeyi “öğrenene” kadar internetten milyarlarca görüntü ile beslendi. Metin üreten modeller, saldırgan görüşleri benimsemek veya yanıltıcı içerik üretmek için rutin olarak kolayca kandırıldı.

Bıçaklar ve Boya Fırçaları açık araştırma grubunun bir üyesi olan Mike Cook, üretken yapay zekanın değişim için büyük ve sorunlu bir güç olduğunu kanıtlamaya devam edeceği konusunda Gahntz ile aynı fikirde. Ancak 2023’ün üretken yapay zekanın “nihayet parasını ağzının olduğu yere koyduğu” yıl olması gerektiğini düşünüyor.

Ücretsiz Dream Studio aracında oluşturulan Stability AI modeli TechCrunch tarafından komut istemi.

“Bir uzmanlar topluluğunu motive etmek yeterli değil [to create new tech] Cook, teknolojinin hayatımızın uzun vadeli bir parçası haline gelmesi için ya birine çok para kazandırması ya da genel halkın günlük yaşamları üzerinde anlamlı bir etkiye sahip olması gerektiğini söyledi. “Bu nedenle, üretken yapay zekanın bu iki şeyden birini gerçekten başarması için ciddi bir baskı göreceğimizi tahmin ediyorum, karışık bir başarıyla.”

Sanatçılar, veri kümelerini devre dışı bırakma çabalarına öncülük ediyor

DeviantArt, Stable Diffusion üzerine kurulu ve DeviantArt topluluğunun sanat eserlerinde ince ayar yapılmış bir yapay zeka sanat üreteci yayınladı. Sanat üreteci, platformun yüklenen sanat eserlerini sistemi eğitmek için kullanma konusundaki şeffaflık eksikliğini eleştiren DeviantArt’ın uzun süredir sakinlerinden yüksek sesle kınandı.

En popüler sistemlerin (OpenAI ve Stability AI) yaratıcıları, sistemlerinin ürettiği zararlı içerik miktarını sınırlamak için adımlar attıklarını söylüyor. Ancak sosyal medyadaki birçok jenerasyona bakılırsa, yapılacak çok iş olduğu açık.

Gahntz, süreci sosyal medyadaki içerik denetimi konusunda devam eden tartışmalarla karşılaştırarak, “Veri kümeleri, bu sorunları ele almak için aktif iyileştirme gerektiriyor ve çubuğun kısa ucunu alma eğiliminde olan topluluklar da dahil olmak üzere, önemli incelemeye tabi tutulmalıdır” dedi.

Stable Diffusion’ın gelişimini büyük ölçüde finanse eden Stability AI, yakın zamanda kamuoyu baskısına boyun eğdi ve sanatçıların yeni nesil Stable Diffusion modelini eğitmek için kullanılan veri setini devre dışı bırakmalarına izin vereceğinin sinyalini verdi. HaveIBeenTrained.com web sitesi aracılığıyla, hak sahipleri birkaç hafta sonra eğitim başlamadan önce iptal talebinde bulunabilecekler.

OpenAI böyle bir devre dışı bırakma mekanizması sunmaz, bunun yerine resim galerilerinin bazı kısımlarını lisanslamak için Shutterstock gibi kuruluşlarla ortak olmayı tercih eder. Ancak, Stability AI ile birlikte karşılaştığı yasal ve katıksız tanıtım rüzgarları göz önüne alındığında, davayı takip etmesi muhtemelen sadece bir zaman meselesi.

Mahkemeler nihayetinde elini zorlayabilir. ABD’de Microsoft, GitHub ve OpenAI dava edildi GitHub’ın kod satırlarını akıllıca öneren hizmeti olan Copilot’un lisanslı kodun bölümlerini kredi sağlamadan yeniden canlandırmasına izin vererek onları telif hakkı yasasını ihlal etmekle suçlayan bir toplu davada.

Belki de yasal zorluğu öngören GitHub, kısa süre önce genel kodun Copilot’un önerilerinde görünmesini önlemek için ayarlar ekledi ve kod önerilerinin kaynağına referans verecek bir özellik sunmayı planlıyor. Ama kusurlu önlemler. En az bir örnekte, filtre ayarı, Copilot’un tüm nitelik ve lisans metni dahil olmak üzere büyük miktarda telif hakkıyla korunan kod yaymasına neden oldu.

Özellikle Birleşik Krallık, kamuya açık veriler aracılığıyla eğitilen sistemlerin kesinlikle ticari olmayan amaçlarla kullanılması gerekliliğini ortadan kaldıracak kurallar üzerinde kafa yorarken, önümüzdeki yıl eleştirilerin artmasını bekleyin.

Açık kaynak ve merkezi olmayan çabalar büyümeye devam edecek

2022, başta OpenAI ve Stability AI olmak üzere bir avuç AI şirketinin sahneye hakim olduğunu gördü. Ancak, Gahntz’ın ifadesiyle, yeni sistemler oluşturma yeteneği “kaynak açısından zengin ve güçlü yapay zeka laboratuvarlarının” ötesine geçtiğinden, sarkaç 2023’te açık kaynağa doğru geri dönebilir.

Bir topluluk yaklaşımı, inşa edilirken ve konuşlandırılırken sistemlerin daha fazla incelenmesine yol açabilir, dedi: “Modeller açıksa ve veri kümeleri açıksa, bu, üretken yapay zekayla bağlantılı birçok kusura ve zarara işaret eden ve genellikle yürütülmesi çok zor olan kritik araştırmaların çok daha fazlasını mümkün kılacaktır.”

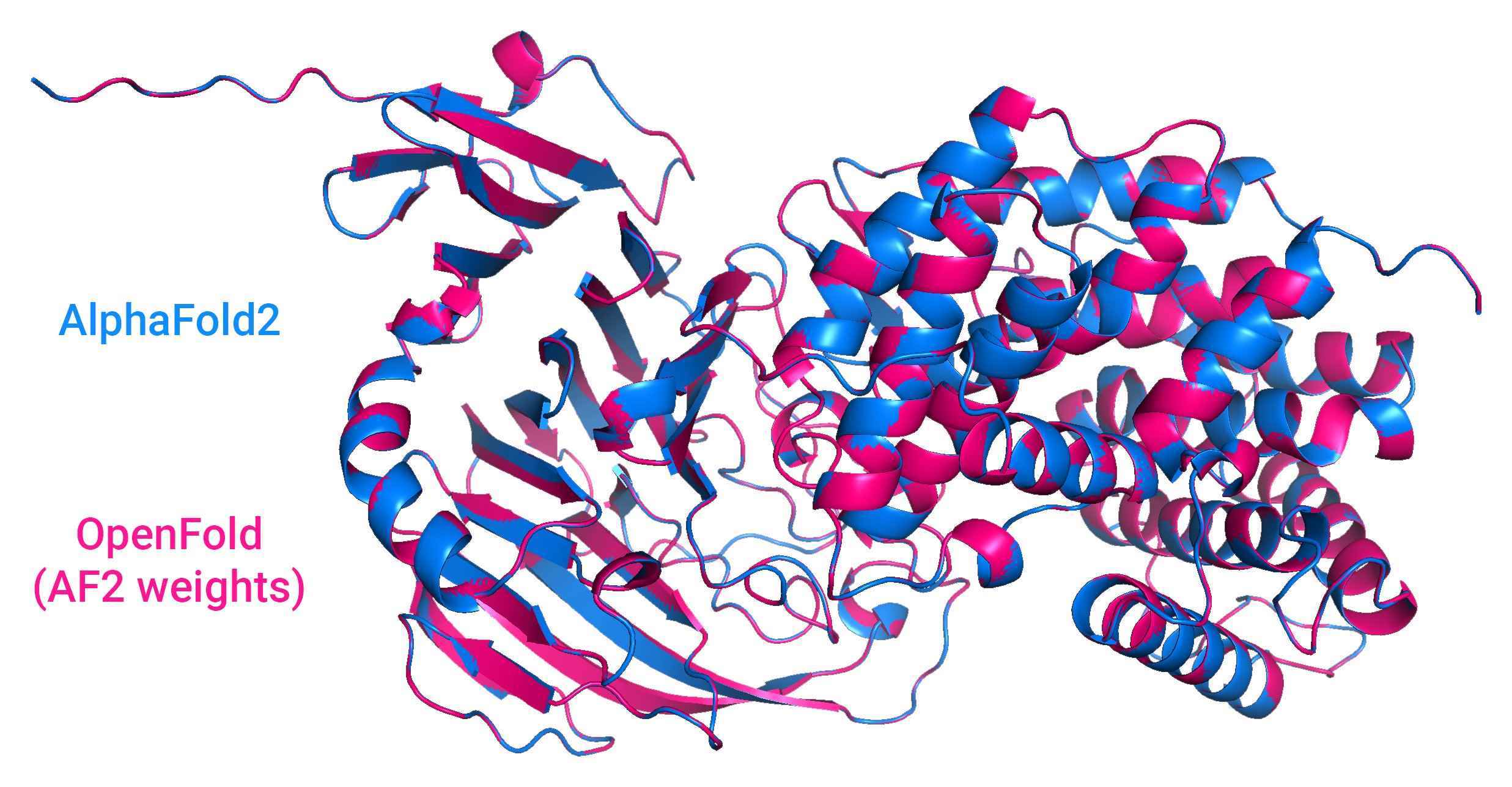

Görsel Kaynakları: DeepMind’in AlphaFold2’sine kıyasla proteinlerin şekillerini tahmin eden açık kaynaklı bir yapay zeka sistemi olan OpenFold’un sonuçları.

Bu tür topluluk odaklı çabalara örnek olarak, EleutherAI’den büyük dil modelleri ve yapay zeka başlangıcı Hugging Face tarafından desteklenen bir çaba olan BigScience dahildir. Stability AI, müzik nesli odaklı Harmonai ve gevşek bir biyoteknoloji deneyleri koleksiyonu olan OpenBioML gibi bir dizi topluluğu kendisi finanse ediyor.

Sofistike AI modellerini eğitmek ve çalıştırmak için hala para ve uzmanlık gerekiyor, ancak merkezi olmayan bilgi işlem, açık kaynak çabaları olgunlaştıkça geleneksel veri merkezlerine meydan okuyabilir.

BigScience, açık kaynaklı Petals projesinin yakın zamanda piyasaya sürülmesiyle merkezi olmayan geliştirmeyi mümkün kılma yönünde bir adım attı. Petals, insanların normalde üst düzey bir GPU veya sunucu gerektiren büyük yapay zeka dil modellerini çalıştırmak için Folding@home’a benzer şekilde bilgi işlem güçlerine katkıda bulunmalarına olanak tanır.

“Modern üretken modellerin eğitilmesi ve çalıştırılması hesaplama açısından pahalıdır. Allen Institute for AI’da kıdemli bir araştırma bilimcisi olan Chandra Bhagavatula, e-posta yoluyla, bazı tuhaf tahminlerin günlük ChatGPT harcamasını yaklaşık 3 milyon dolar olarak gösterdiğini söyledi. “Bunu ticari olarak uygulanabilir ve daha geniş çapta erişilebilir hale getirmek için, bunu ele almak önemli olacak.”

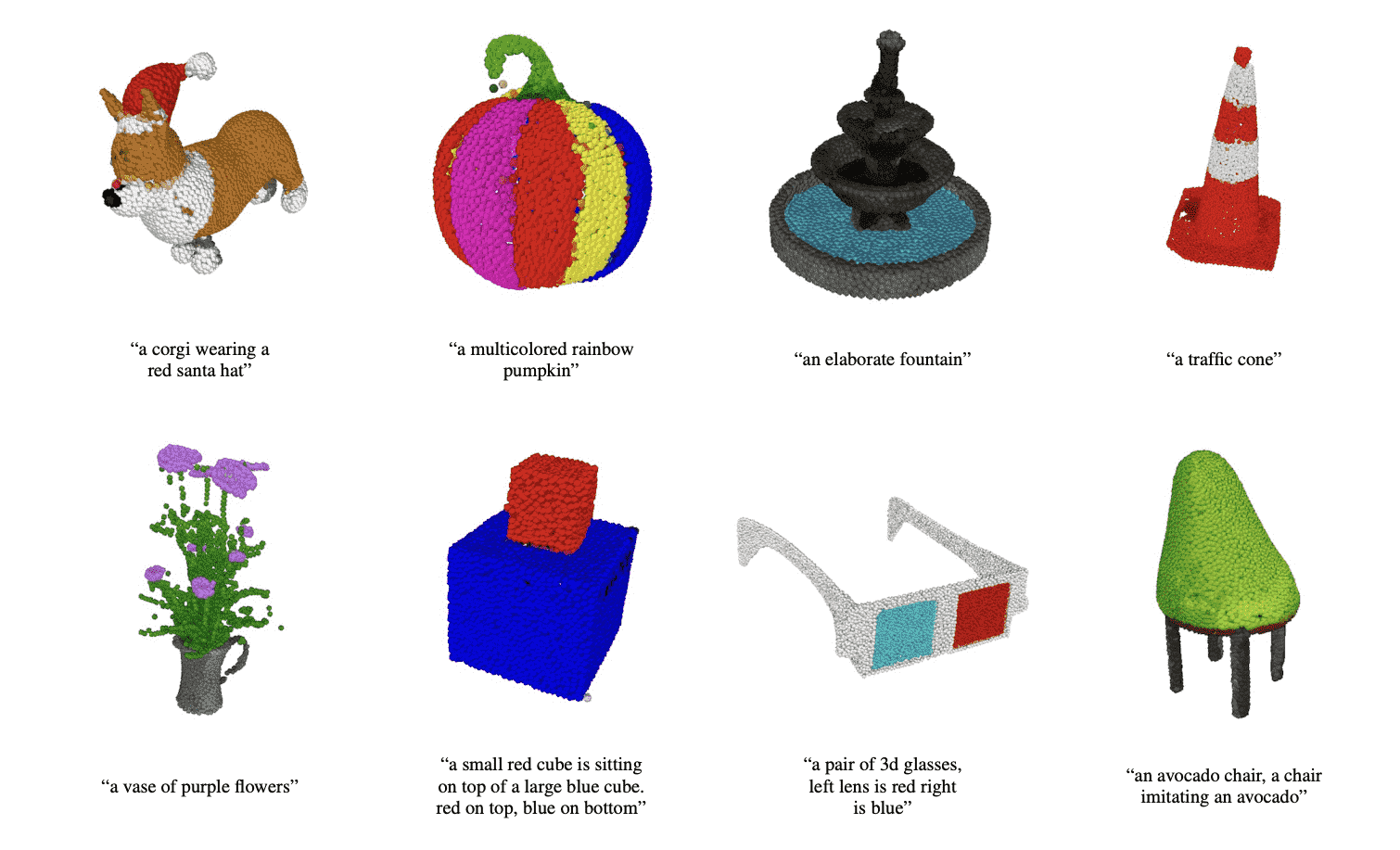

Ancak Chandra, yöntemler ve veriler tescilli kaldığı sürece büyük laboratuvarların rekabet avantajlarına sahip olmaya devam edeceğine dikkat çekiyor. Yakın tarihli bir örnekte OpenAI, bir metin istemi verildiğinde 3B nesneler oluşturabilen bir model olan Point-E’yi piyasaya sürdü. Ancak OpenAI, modeli açık kaynaklı yaparken, Point-E’nin eğitim verilerinin kaynaklarını açıklamadı veya bu verileri yayınlamadı.

Point-E, nokta bulutları oluşturur.

Chandra, “Açık kaynak çabalarının ve ademi merkeziyetçilik çabalarının kesinlikle değerli olduğunu ve daha fazla sayıda araştırmacının, uygulayıcının ve kullanıcının yararına olduğunu düşünüyorum” dedi. “Bununla birlikte, açık kaynaklı olmalarına rağmen, en iyi modellere kaynak kısıtlamaları nedeniyle çok sayıda araştırmacı ve uygulayıcı hala erişemiyor.”

AI şirketleri gelen düzenlemeler için boyun eğiyor

AB’nin Yapay Zeka Yasası gibi düzenlemeler, şirketlerin gelecekte yapay zeka sistemlerini geliştirme ve kullanma şeklini değiştirebilir. İşe alma, işe alma veya terfi için AI ve algoritma tabanlı teknolojinin kullanılmadan önce önyargı için denetlenmesini gerektiren New York City’nin AI işe alma yasası gibi daha yerel çabalar da olabilir.

Chandra, bu düzenlemeleri, özellikle üretici yapay zekanın olgusal olarak yanlış bilgi yayma eğilimi gibi giderek daha belirgin hale gelen teknik kusurları ışığında gerekli görüyor.

“Bu, üretken yapay zekanın, hataların çok yüksek maliyetlere neden olabileceği birçok alanda (örneğin sağlık hizmetleri) uygulanmasını zorlaştırıyor. Ek olarak, yanlış bilgi üretmenin kolaylığı, yanlış bilgilendirme ve dezenformasyonla ilgili zorluklar yaratıyor” dedi. “[And yet] AI sistemleri zaten ahlaki ve etik çıkarımlarla dolu kararlar alıyor.”

Yine de gelecek yıl yalnızca düzenleme tehdidi getirecek – herhangi biri para cezasına çarptırılmadan veya suçlanmadan önce kurallar ve mahkeme davaları hakkında çok daha fazla tartışma bekleyin. Ancak şirketler, AI Yasası’nın risk kategorileri gibi, gelecek yasaların en avantajlı kategorilerinde pozisyon almaya devam edebilir.

Şu anda yazılan kural, yapay zeka sistemlerini, her biri farklı gereksinimlere ve inceleme seviyelerine sahip dört risk kategorisinden birine ayırıyor. En yüksek risk kategorisindeki sistemler, “yüksek riskli” yapay zeka (ör. kredi puanlama algoritmaları, robotik cerrahi uygulamaları), Avrupa pazarına girmelerine izin verilmeden önce belirli yasal, etik ve teknik standartları karşılamalıdır. En düşük risk kategorisi olan “minimum veya sıfır risk” AI (ör. istenmeyen e-posta filtreleri, AI özellikli video oyunları), yalnızca kullanıcıların bir AI sistemiyle etkileşime girdiklerini fark etmelerini sağlamak gibi şeffaflık yükümlülükleri getirir.

Os Keyes, Ph.D. Washington Üniversitesi’nden aday, şirketlerin kendi sorumluluklarını ve düzenleyicilere karşı görünürlüklerini en aza indirmek için en düşük risk seviyesini hedefleyeceklerinden endişe duyduğunu ifade etti.

“Bu endişe bir yana, [the AI Act] gerçekten masada gördüğüm en olumlu şey” dediler. “Pek görmedim herhangi bir şey Kongre dışında.”

Ancak yatırımlar kesin bir şey değil

Gahntz, bir yapay zeka sistemi çoğu insan için yeterince iyi çalışsa da bazıları için son derece zararlı olsa bile, bir şirketin onu geniş çapta kullanılabilir hale getirmesi için “hala yapılacak çok ödev kaldığını” savunuyor. “Bütün bunlar için bir de iş gerekçesi var. Modeliniz çok fazla dağınık şey üretiyorsa, tüketiciler bundan hoşlanmayacak,” diye ekledi. “Ama belli ki bu aynı zamanda adaletle ilgili.”

Özellikle yatırımcılar paralarını gelecek vaat eden üretken yapay zekanın ötesine yatırmaya istekli göründükleri için, şirketlerin gelecek yıl bu argümana ikna olup olmayacağı belli değil.

Stability AI, Stable Diffusion tartışmalarının ortasında, Coatue ve Lightspeed Venture Partners dahil olmak üzere önde gelen destekçilerden 1 milyar doları aşan bir değerlemeyle 101 milyon dolar topladı. OpenAI söz konusu girerken 20 milyar dolar değerinde olacak gelişmiş görüşmeler Microsoft’tan daha fazla fon toplamak için. (Microsoft daha önce yatırım 2019’da OpenAI’de 1 milyar dolar.)

Elbette, bunlar kuralın istisnaları olabilir.

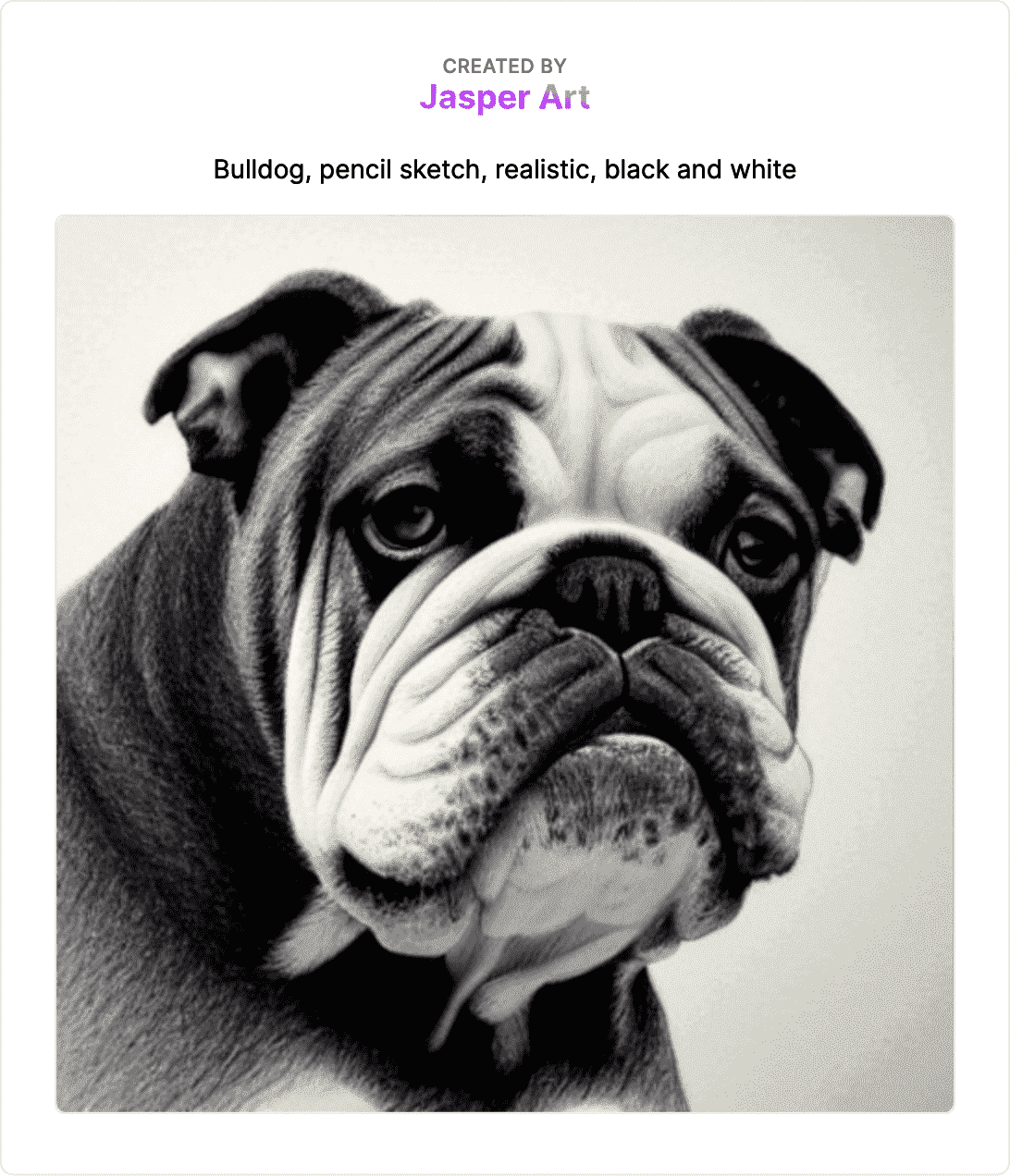

Görsel Kaynakları: Jasper

Crunchbase’e göre sürücüsüz şirketler Cruise, Wayve ve WeRide ve robotik firması MegaRobo dışında, bu yıl toplanan para açısından en iyi performans gösteren AI firmaları yazılım tabanlıydı. Web içeriği için yapay zeka odaklı öneriler sunan bir hizmet satan Contentsquare, Temmuz ayında 600 milyon dolarlık bir turu kapattı. “Diyalog analitiği” (düşünce çağrı merkezi ölçümleri) için yazılım ve konuşma asistanları satan Uniphore, indi Şubatta 400 milyon dolar Bu arada, yapay zeka destekli platformu satış temsilcilerine ve pazarlamacılara gerçek zamanlı ve veriye dayalı öneriler sunan Highspot, yakalandı Ocak ayında 248 milyon dolar.

Yatırımcılar, üretici yapay zeka kadar “seksi” olmasalar bile, müşteri şikayetlerinin analizini otomatikleştirmek veya satış fırsatları oluşturmak gibi daha güvenli bahislerin peşine düşebilir. Bu, dikkat çekici büyük yatırımların olmayacağı anlamına gelmez, ancak bunlar nüfuz sahibi oyunculara ayrılacaktır.